アルゴリズム

アルゴリズム 探索と予測の最適化:バンディットアルゴリズム

インターネットを通して提供される様々なサービス、例えば、ウェブサイトやネット上の広告などは、膨大な量の利用者の行動などのデータに基づいて、より良いものへと常に改良されています。集まったデータは、利用者の好みや行動パターンを知る手がかりとなり、それによってサービスの内容や表示方法を調整することで、より多くの人に利用してもらえるように工夫されているのです。しかし、新しいサービスが始まったばかりの頃や、既存のサービスに新しい機能を追加した直後などは、十分なデータが集まっていないことがよくあります。このようなデータ不足の状態では、これまでのデータに基づいた従来のやり方では、効果的な改善を行うのが難しくなります。このような、情報が限られている状況でこそ力を発揮するのが、バンディットアルゴリズムと呼ばれる手法です。

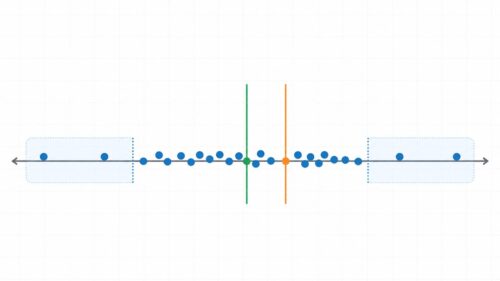

バンディットアルゴリズムは、限られたデータだけを頼りに、試行錯誤しながらも、最も良い選択を見つけ出すための計算方法です。まるで、カジノで限られた資金を元手に利益を最大化しようとする熟練のギャンブラーのように、データの収集と、そのデータに基づいた予測のバランスを巧みに取りながら、最適な行動方針を探し出すのです。具体的には、まだよくわからない選択肢も試してみることで新しい情報を集めつつ、同時に、これまでの情報から良さそうだと思われる選択肢を優先的に選んでいくことで、全体としての成果を最大化するように調整を行います。このように、探索と活用のバランスをうまく調整することで、少ない情報の中でも効率的に学習し、最適な行動を見つけることができるのです。バンディットアルゴリズムは、様々な場面で応用されており、ウェブサイト上での広告表示の最適化をはじめ、オンラインショッピングにおける商品の推薦、さらには、医療分野での治療方針の決定など、幅広い分野で活用されています。限られた情報から最大の成果を引き出すための、まさに現代社会における必須の技術と言えるでしょう。