アルゴリズム

アルゴリズム ReLU関数とは?意味・仕組み・活用例をわかりやすく解説

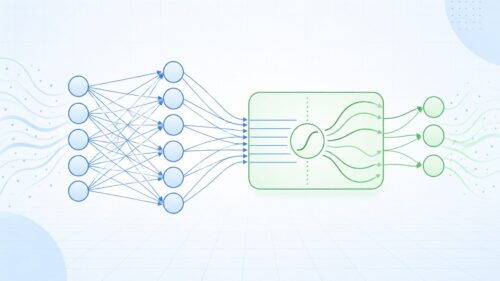

人の脳を模倣した仕組みである人工知能は、無数の繋がりを持つ人工神経細胞のネットワークによって情報を処理します。この人工神経細胞の出力部分を活性化関数と呼びます。活性化関数は、人工神経細胞の出力を調整し、ネットワーク全体の学習能力を高める重要な役割を担っています。

もし活性化関数がなければ、人工神経細胞は単純な入力の合計を出力するだけになってしまいます。これは、幾重にも神経細胞が重なった複雑なネットワークを作っても、結局は単純な計算をしているのと同じです。例えるなら、どんな複雑な計算式を作っても、足し算と掛け算だけで表現できてしまうようなものです。これでは複雑な問題を解くことはできません。

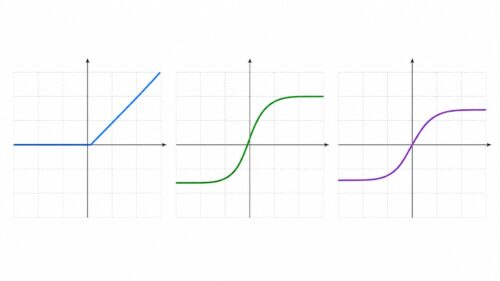

活性化関数は、この単純な計算に非線形性、つまり曲線的な変化を加えます。これにより、ネットワークは複雑なパターンを学習し、より高度な問題を解決できるようになります。ちょうど、単純な直線だけでなく、曲線や折れ線を使うことで、より複雑な図形を描けるようになるのと同じです。活性化関数の種類も様々で、それぞれ異なる特徴を持っています。よく使われるものとして、出力値を0から1の間に収めるもの、負の値を0に変換するもの、滑らかな曲線を描くものなどがあります。

どの活性化関数を選ぶかは、扱う問題の種類やネットワークの構造によって大きく影響します。例えば、画像認識では、特定の特徴を強調する活性化関数がよく用いられます。また、自然言語処理では、言葉の意味関係を捉えるのに適した活性化関数が使われます。適切な活性化関数を選ぶことで、学習の速度を上げたり、予測の精度を向上させることができます。活性化関数は、人工知能の性能を左右する重要な要素と言えるでしょう。