データリーケージとは?機械学習で精度を誤る原因と対策

AIの初心者

「データリーケージ」って、機械学習でどんな問題なんですか?

AI専門家

簡単に言うと、学習や評価の中に、本来その時点では使えない情報が混ざってしまうことだよ。試験で答えを先に見て高得点を取るようなもので、実力を正しく測れなくなるんだ。

AIの初心者

精度が高く見えるなら、なぜ問題になるんですか?

AI専門家

実際の運用では、その漏れた情報を使えないからだよ。未来のデータやテストデータが混ざると、検証ではよく見えても、新しいデータでは急に当たらなくなる。だから、データの時点や分け方を丁寧に確認する必要があるんだ。

データリーケージとは

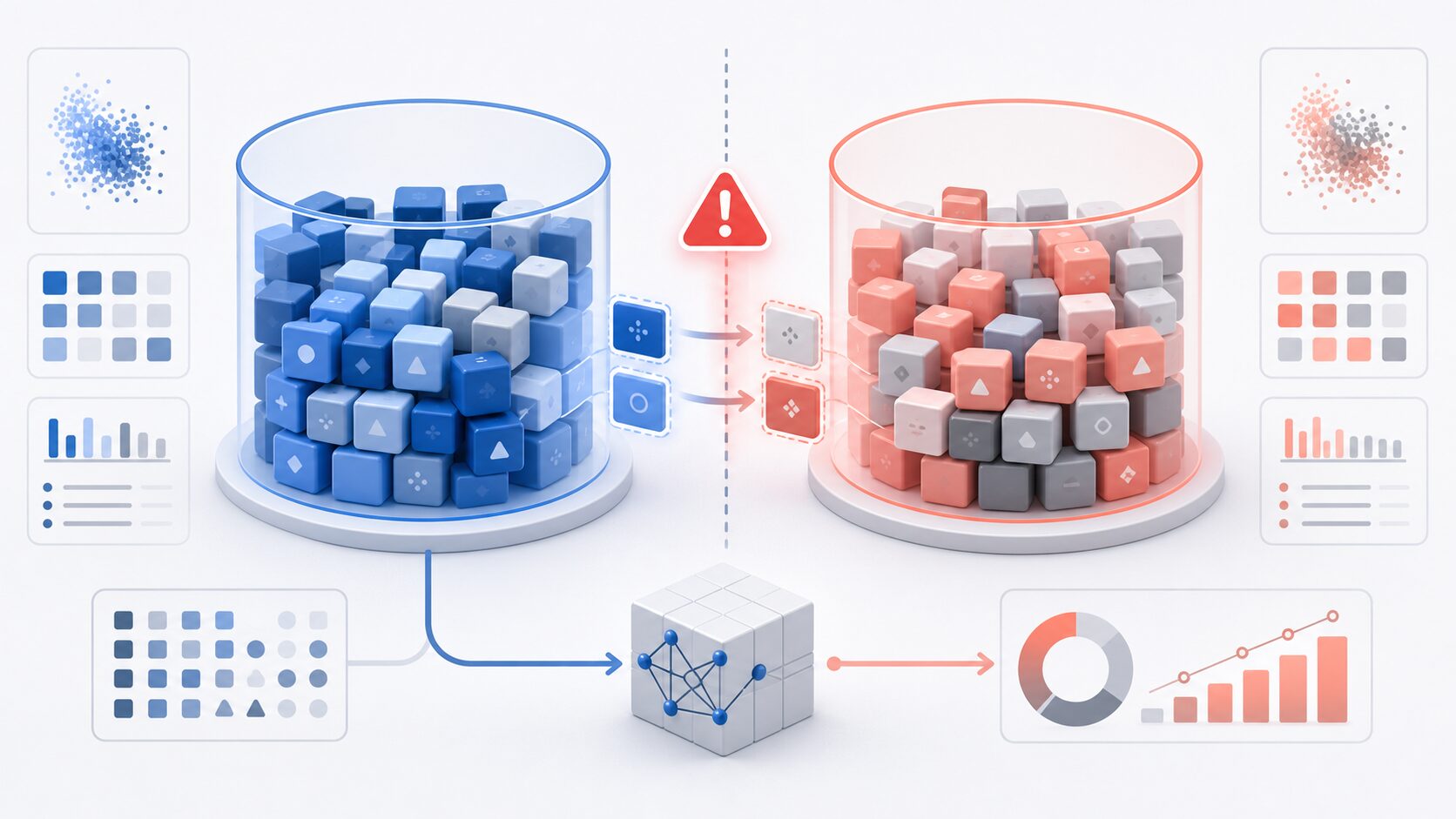

データリーケージとは、機械学習モデルを作る過程で、本来は学習や評価に使ってはいけない情報が入り込み、モデルの性能を実際より高く見せてしまう問題です。特に、予測時点では利用できない未来の情報、目的変数に近すぎる特徴量、訓練データとテストデータの混在が原因になりやすい点に注意が必要です。

データリーケージとは

データリーケージとは、機械学習のモデル開発で、予測時点では使えない情報が学習データや評価手順に混ざることです。英語では data leakage と呼ばれ、日本語では情報漏えい、リーケージ、データの漏れなどと説明されます。

ここでいう「漏えい」は、個人情報が外部に流出するという意味だけではありません。機械学習では、モデルが本来知らないはずの答えや未来の情報を、学習中または検証中に見てしまう状態を指します。その結果、検証データでは高い精度が出ても、現実の新しいデータに対しては同じ性能を発揮できません。

例えば、来月の売上を予測するモデルを作るとします。予測時点で分かっている過去の売上、過去の広告費、季節、曜日などを使うのは自然です。しかし、来月の実績売上や、来月終了後に確定した広告費を特徴量に含めてしまうと、モデルは未来を先に見て学習していることになります。これがデータリーケージです。

初心者がまず押さえるべき判断基準は単純です。あるデータ項目を見たときに、実際に予測する瞬間にもその情報を使えるかを確認します。使えないなら、どれほど予測に効きそうでも特徴量に入れてはいけません。

データリーケージが起きる主な種類

データリーケージは、原因ごとにいくつかの種類に分けて考えると理解しやすくなります。代表的なのは、特徴量に起因するリーケージ、訓練データとテストデータの混入、前処理によるリーケージです。

特徴量に起因するリーケージは、目的変数、つまり予測したい答えに近すぎる情報が説明変数に含まれるケースです。病気の有無を予測するモデルで、診断後にしか得られない確定診断コードや、治療開始後の処方情報を入れてしまうと、予測時点では使えない情報を使っている可能性があります。

訓練データとテストデータの混入は、モデル評価をゆがめる典型的な原因です。テストデータは、モデルがまだ見ていないデータに対する性能を測るために残しておくものです。ところが、分割前に重複データを放置したり、同じ利用者のほぼ同一レコードが訓練側とテスト側に分かれたりすると、モデルはテストの答えに近い情報を先に見た状態になります。

前処理によるリーケージも見落とされやすいポイントです。標準化、欠損値補完、特徴量選択などをデータ全体に対して先に実行し、その後で訓練データとテストデータに分けると、テストデータの分布情報が前処理を通じて訓練側に入り込む場合があります。一般には、データ分割を先に行い、前処理は訓練データで学習して検証・テストデータへ適用する流れが安全です。

| 種類 | 例 | 注意点 |

|---|---|---|

| 特徴量リーケージ | 診断後に確定した情報を診断前の予測に使う | 予測時点で利用可能かを確認する |

| 訓練・テスト間の混入 | 同一レコードや近いレコードが両方に入る | 分割単位と重複を確認する |

| 前処理によるリーケージ | 分割前に全データで標準化や特徴量選択を行う | 前処理を訓練データ内で学習する |

リーケージがモデル評価に与える影響

データリーケージが起きると、モデルの精度、適合率、再現率、AUC などの評価指標が実力以上に高く見えます。これは、モデルがデータの本質的な関係を学んだのではなく、答えに近い情報やテストデータ由来の手がかりに頼っているためです。

問題は、検証時に高いスコアが出ること自体ではありません。高いスコアを信じて本番運用に進めると、実際のデータでは急に性能が下がり、判断ミスや業務上の損失につながることです。医療、金融、需要予測、広告配信など、予測結果が意思決定に使われる場面では特に大きなリスクになります。

データリーケージは過学習と混同されることがあります。過学習は、訓練データの細かい特徴やノイズにモデルが合わせすぎて、未知データに弱くなる現象です。一方、データリーケージは、本来見てはいけない情報がデータ作成や評価の中に入り込んでいることが原因です。どちらも汎化性能を下げますが、発生源が異なります。

見分ける手がかりとしては、スコアが不自然に高すぎる、少数の特徴量だけで極端に当たる、運用開始後に急に性能が落ちる、時系列で未来の情報を使っている可能性がある、といった点があります。特に、業務知識から見て「この情報が予測時点で本当に分かるのか」と疑問が出る場合は、特徴量の作成時点を確認するべきです。

時系列データで特に注意すべきこと

時系列データでは、データの順序を無視するとリーケージが起きやすくなります。売上予測、株価予測、在庫予測、アクセス数予測、故障予測などでは、モデルが利用できる情報は予測時点より前に観測されたものに限られます。

例えば、4月の売上を予測するモデルを作る場合、1月から3月までの実績を学習に使い、4月のデータで検証する流れは自然です。しかし、4月以降に確定した情報を特徴量作成に使ったり、1月から4月までの全体平均を先に計算してから訓練データへ入れたりすると、未来の情報が過去へ流れ込むことになります。

時間的なリーケージを避けるには、特徴量の観測時点が目的変数の観測時点より前にあるかを確認します。売上を予測するなら、予測時点で既に分かっている価格、在庫、過去の販売数、カレンダー情報は使いやすい候補です。一方、実際に売れた後で確定する返品数、確定売上、購入後の行動履歴などは、目的によっては使えません。

また、時系列データではランダム分割が常に適切とは限りません。過去と未来が混ざったランダム分割を行うと、未来の傾向を含むデータで学習し、過去や近い時点を検証する形になる場合があります。実運用で未来を予測するなら、時間順に訓練期間、検証期間、テスト期間を分ける方法を検討します。

適切な検証でリーケージを見抜く

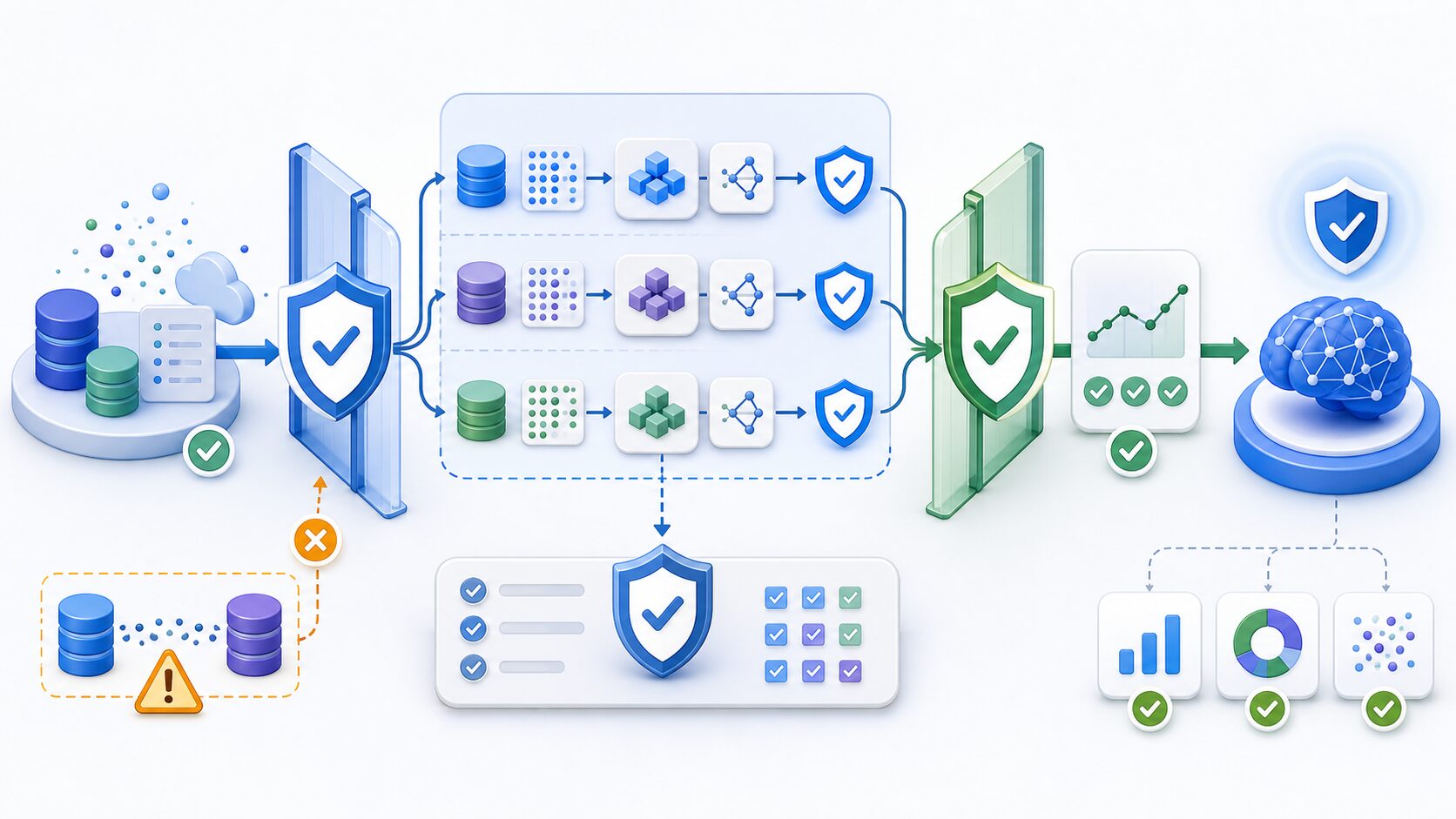

リーケージを完全に自動で検出するのは難しいため、検証設計とレビューの両方が重要です。まず、訓練データ、検証データ、テストデータの役割を分けます。訓練データはモデルを学習するため、検証データはモデルや特徴量の調整に使うため、テストデータは最後に性能を確認するために使います。

交差検証を使う場合も注意が必要です。通常の k 分割交差検証は便利ですが、時系列データや同一ユーザーの複数レコードを含むデータでは、分割方法を誤ると情報が漏れます。時系列なら Time Series Split のように時間順を守る方法、ユーザー単位の依存が強いならグループ単位で分割する方法が候補になります。

前処理の位置も検証の信頼性を左右します。標準化や欠損値補完を行う場合、平均値や中央値などの統計量は訓練データから求め、検証データやテストデータにはその結果を適用します。特徴量選択も同じで、全データを見て重要そうな特徴量を選んでから分割すると、評価用データの情報が選択過程に入る可能性があります。

実務では、スコアの高さだけでなく、特徴量重要度やモデルの判断根拠も確認します。目的変数とほぼ同じ意味を持つ特徴量、予測後にしか記録されない特徴量、特定のデータ収集手順に依存した特徴量が上位に出ている場合は、リーケージを疑うべきです。

データリーケージを防ぐ実務上の対策

データリーケージを防ぐには、モデルを作った後に慌てて確認するのではなく、データ設計の段階から予防することが大切です。最初に、予測対象、予測時点、利用できる情報の範囲を明確にします。この3点が曖昧なままだと、便利そうな特徴量を入れてしまい、後からリーケージに気づくことになります。

特徴量を作るときは、各項目について「いつ記録された情報か」「誰がどの業務で入力した情報か」「予測時点で利用できるか」を確認します。特に、結果確定後に入力されるステータス、手続き完了後のフラグ、将来期間を含む集計値は危険です。業務データでは、列名だけでは時点が分からないため、データ定義や生成処理まで見る必要があります。

データ分割では、レコード単位だけでなく、ユーザー、店舗、商品、案件、期間など、情報が共有されやすい単位を意識します。同じ顧客の履歴が訓練側とテスト側にまたがると、本当に新しい顧客への性能を測れていない可能性があります。何を未知データとみなしたいのかに合わせて分割単位を決めます。

また、機械学習のパイプラインを使って、分割、前処理、学習、評価の手順を再現できる形にしておくことも有効です。手作業で前処理済みデータを何度も作り直すと、どの段階でどのデータを参照したかが分かりにくくなります。再現可能な処理にしておけば、レビューや修正もしやすくなります。

| 確認項目 | 見るポイント |

|---|---|

| 予測時点 | その情報は予測する瞬間に本当に利用できるか |

| 特徴量 | 目的変数そのもの、または結果確定後の情報が混ざっていないか |

| データ分割 | テストデータの情報が訓練側へ入る分割になっていないか |

| 前処理 | 統計量や特徴量選択を全データで先に行っていないか |

| 検証方法 | 時系列やグループ構造に合った分割方法を使っているか |

まとめ

データリーケージは、機械学習モデルの評価を大きく誤らせる落とし穴です。検証スコアが高くても、予測時点では使えない情報やテストデータ由来の情報に頼っているなら、そのモデルは実運用で信頼できません。

対策の中心は、予測時点で使える情報だけを使うこと、訓練データと評価用データを正しく分けること、前処理を分割後の手順として管理することです。特に時系列データでは、未来の情報が過去の予測に入り込まないよう、期間の分け方と特徴量の作成時点を確認します。

初心者のうちは、モデルの複雑さや指標の高さに目が向きがちです。しかし、良いモデル評価は、正しいデータの扱いから始まります。データリーケージを疑う視点を持つことで、見かけだけの高精度ではなく、実際に使える機械学習モデルに近づけます。

更新履歴

| 日付 | 内容 |

|---|---|

| 2025年3月29日 | 初回公開 |

| 2026年5月12日 | リーケージの種類、検証手順、時系列での判断軸を補強 |