学習

学習 学習用データとは?AIの成長を支えるTraining Dataの基本

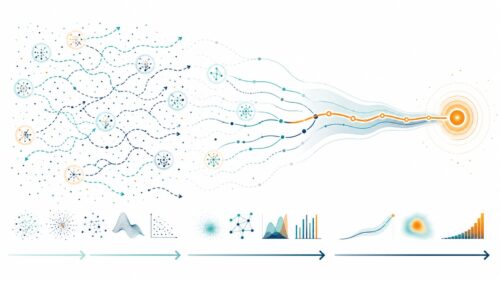

人工知能は、自ら学び、考えを巡らせ、答えを導き出すことができる計算機処理方法です。まるで人が学ぶように、人工知能も学ぶ必要があります。その学習には欠かせないものがあります。それが「学習用資料」です。

学習用資料とは、人工知能に知識を教え込むための情報の集まりです。例えるなら、人が学ぶための教科書や練習問題集のようなものです。人工知能はこの資料を読み解き、そこに潜む法則や繋がりを見つけ出すことで、決められた作業をこなせるようになります。

たとえば、絵の内容を理解する人工知能を考えてみましょう。この人工知能には、たくさんの絵と、それぞれの絵に何が描かれているかを示す説明書きが必要です。これらが学習用資料となります。人工知能はこれらの資料から、例えば、とがった耳やひげがある絵には「ねこ」という説明書きがされていることを学びます。たくさんの絵と説明書きを学ぶことで、人工知能は初めて見る絵でも、それが何の絵なのかを判断できるようになるのです。

また、文章を書く人工知能の場合には、様々な文章を学習用資料として用います。人工知能はこれらの文章を読み込み、言葉の繋がり方や文の構成などを学びます。そして、新しい文章を作る際に、学習した知識を活かして、自然で意味の通る文章を作り出すことができるようになります。

このように、学習用資料は人工知能が様々な作業をこなせるようになるための土台となる重要なものです。学習用資料の質や量は、人工知能の性能に大きな影響を与えます。より質の高い、より多くの学習用資料を用いることで、人工知能はより賢く、より正確に作業をこなせるようになります。