ハーネスエンジニアリングとは?意味と使い方をわかりやすく解説

AIの初心者

「ハーネスエンジニアリング」という言葉を見ました。プロンプトエンジニアリングとは違うものですか?

AI専門家

違います。ハーネスエンジニアリングは、AIをうまく動かす言葉づくりだけでなく、入力、実行、評価、記録、安全確認まで含めて、AIを試せる仕組みを設計する考え方です。

AIの初心者

AIモデルそのものを作る技術ではないのですね。どんな場面で必要になりますか?

AI専門家

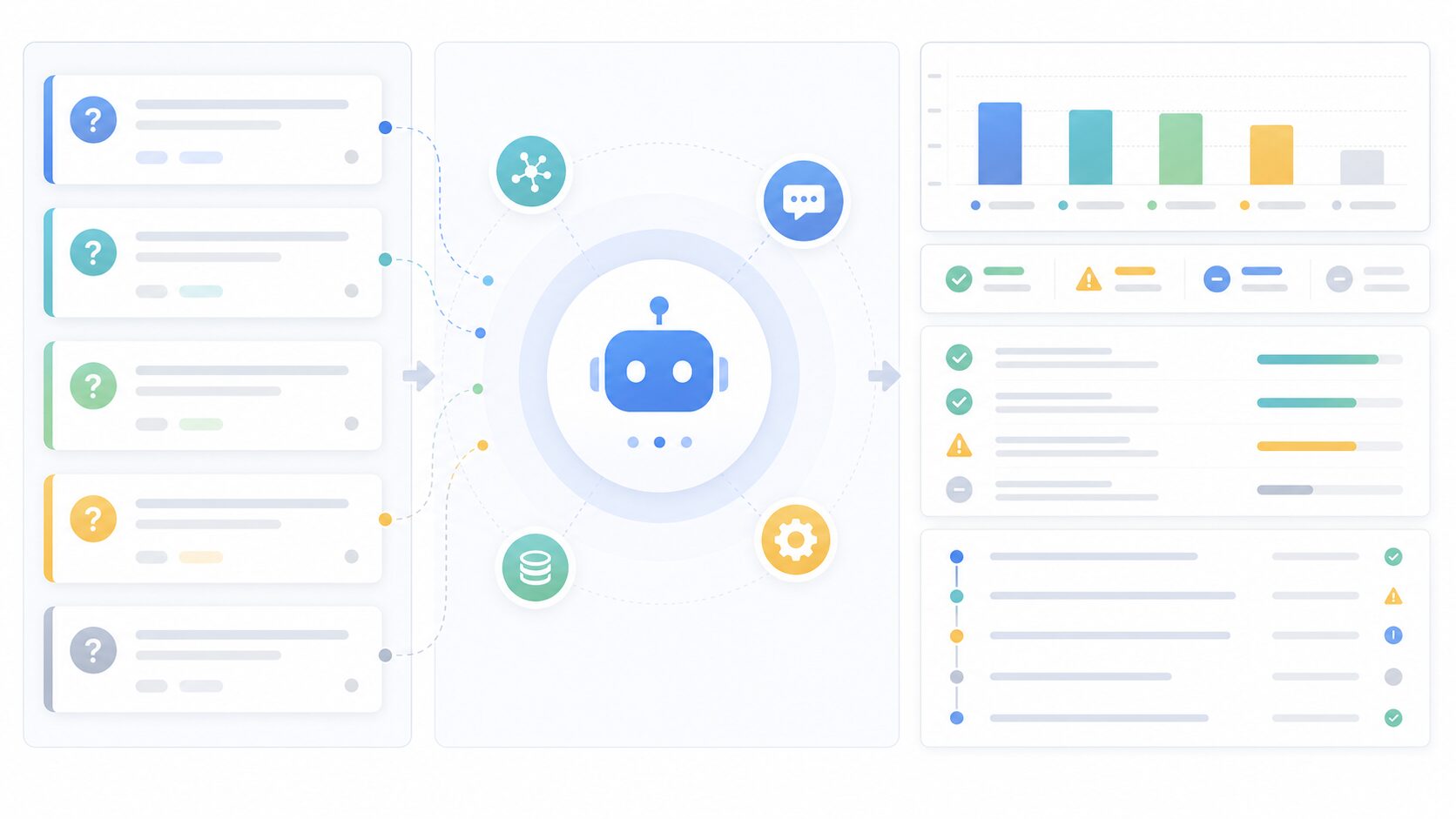

たとえば、チャットボットの回答品質を比べる、RAGの検索結果を検証する、モデル変更後の劣化を見つける、といった場面です。この記事では初心者向けに、意味、仕組み、具体例、関連用語との違いを整理します。

ハーネスエンジニアリングとは。

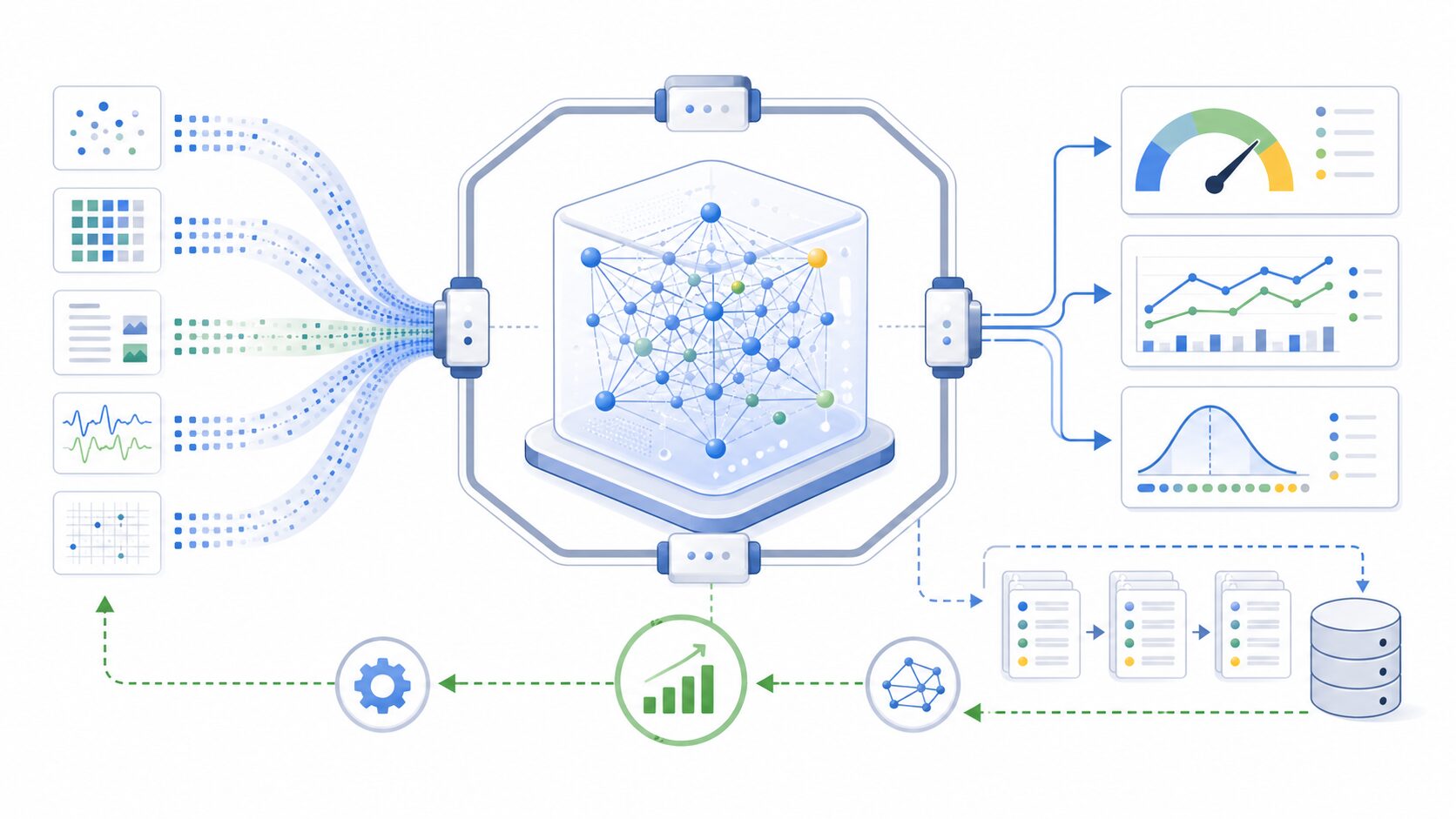

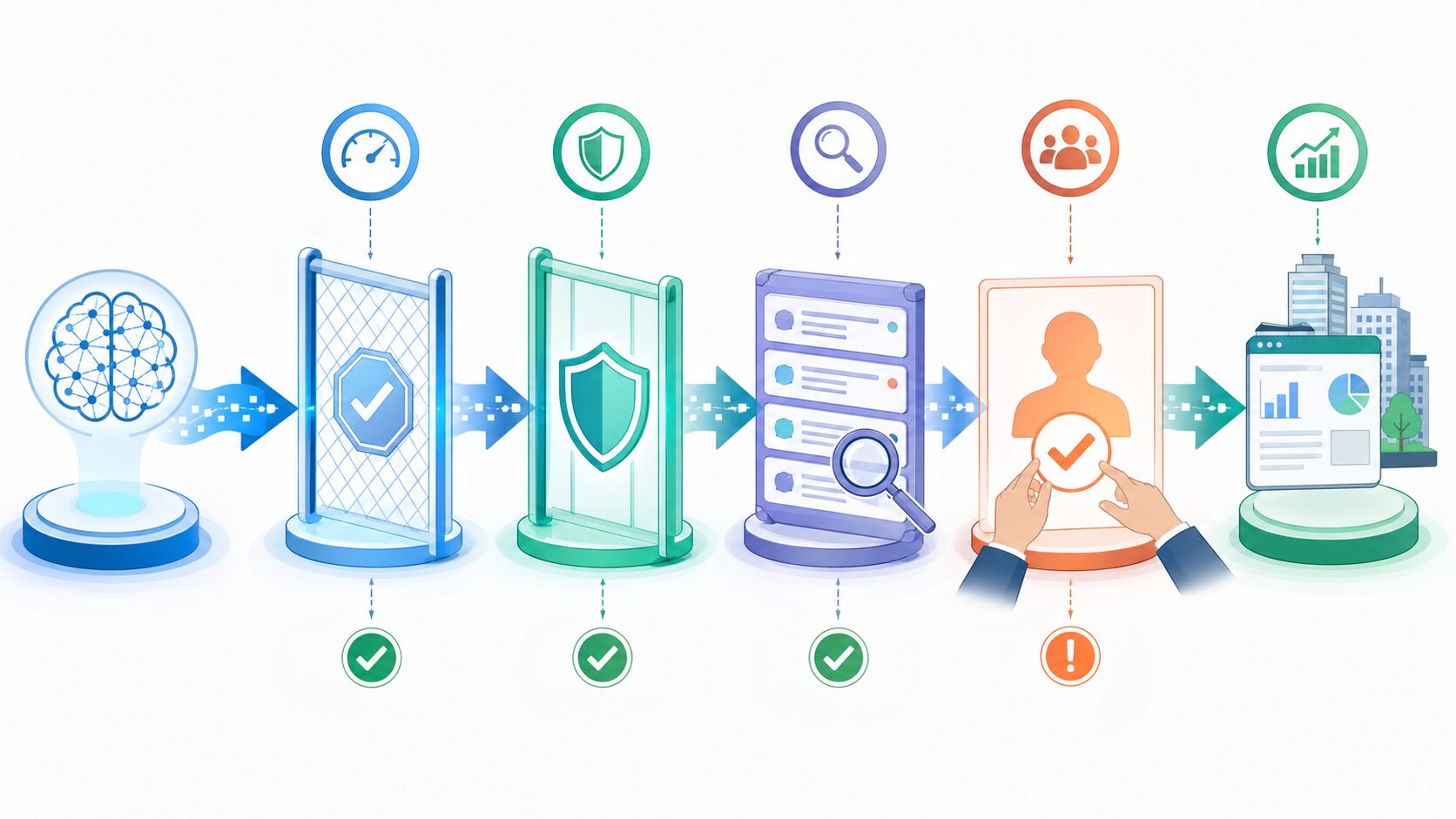

ハーネスエンジニアリングとは、AIモデルやAIシステムを安全かつ再現可能に試すために、入力データ、実行環境、評価基準、ログ記録、比較手順、確認フローなどの周辺仕組みを設計する考え方です。

ハーネスエンジニアリングは、まだ一般向けには聞き慣れない言葉かもしれません。ここでいう「ハーネス」は、機械やソフトウェアを安全につなぎ、試験し、制御するための補助的な仕組みを指します。AIの文脈では、モデルそのものを直接意味するのではなく、モデルを囲むテスト環境や評価の仕組みを意味します。

生成AIや機械学習の利用では、「良いモデルを選ぶ」「良いプロンプトを書く」だけでは十分ではありません。実際の業務では、同じ質問に対して回答が少し変わることがあります。データが更新されると検索結果も変わります。モデルを入れ替えると、以前は正しく答えられていた質問で失敗することもあります。その変化を感覚だけで判断していると、品質管理が難しくなります。

そこで必要になるのが、AIを試すための仕組みを設計するという視点です。どの入力で試すのか、何を正解または合格とするのか、結果をどこに記録するのか、前回との差分をどう見るのか、危険な出力をどう止めるのか。こうした要素をまとめて扱うのが、ハーネスエンジニアリングの中心的な役割です。

ハーネスエンジニアリングの基本的な意味

ハーネスエンジニアリングを一言でいうと、AIを「作る」技術というより、AIを「試し、比べ、改善する」ための設計です。AIモデル、プロンプト、検索システム、外部ツール、評価データ、人間の確認作業をばらばらに扱うのではなく、ひとつの流れとして組み立てます。

たとえば、社内FAQに答えるAIチャットボットを考えてみましょう。質問を入力するとAIが回答します。しかし、実務では「回答が自然か」だけでなく、「社内ルールに合っているか」「根拠文書を参照しているか」「古い情報を混ぜていないか」「個人情報を出していないか」「分からないときに無理に答えていないか」まで確認する必要があります。

このとき、質問リストを用意し、AIに自動で回答させ、回答と参照文書を保存し、評価基準に沿って判定し、問題のあるケースを人間が確認できるようにする仕組みがあると便利です。この一連の仕組みが、ハーネスのイメージに近いものです。AIを直接制御するというより、AIのふるまいを観察しやすくし、変更の影響を見えるようにします。

初心者がまず押さえたいのは、ハーネスエンジニアリングはモデル性能そのものではなく、モデルを評価・運用するための周辺設計だという点です。高性能なモデルを使っていても、評価の仕組みがなければ、どの場面で良くなったのか、どの場面で悪くなったのかを説明しにくくなります。逆に、完璧ではないモデルでも、テストや確認の仕組みが整っていれば、使える範囲を明確にしながら安全に活用できます。

なぜAI開発でハーネスエンジニアリングが重要なのか

AI開発でハーネスエンジニアリングが重要になる理由は、AIの出力が常に単純な正誤で判断できるとは限らないからです。通常のプログラムであれば、同じ入力に対して同じ出力が返ることを期待しやすい場面が多くあります。もちろんソフトウェアにも例外はありますが、少なくとも「この関数にこの値を渡したら、この値が返る」というテストを書きやすい領域が広くあります。

一方、生成AIでは、回答の言い回しが変わったり、複数の正しい表現が存在したりします。要約タスクなら、同じ文章を短くまとめる方法はひとつではありません。問い合わせ対応なら、丁寧な回答、簡潔な回答、根拠を詳しく示す回答など、目的によって望ましい形が変わります。つまり、AIの評価では「完全一致したか」だけではなく、目的に合っているかを見なければなりません。

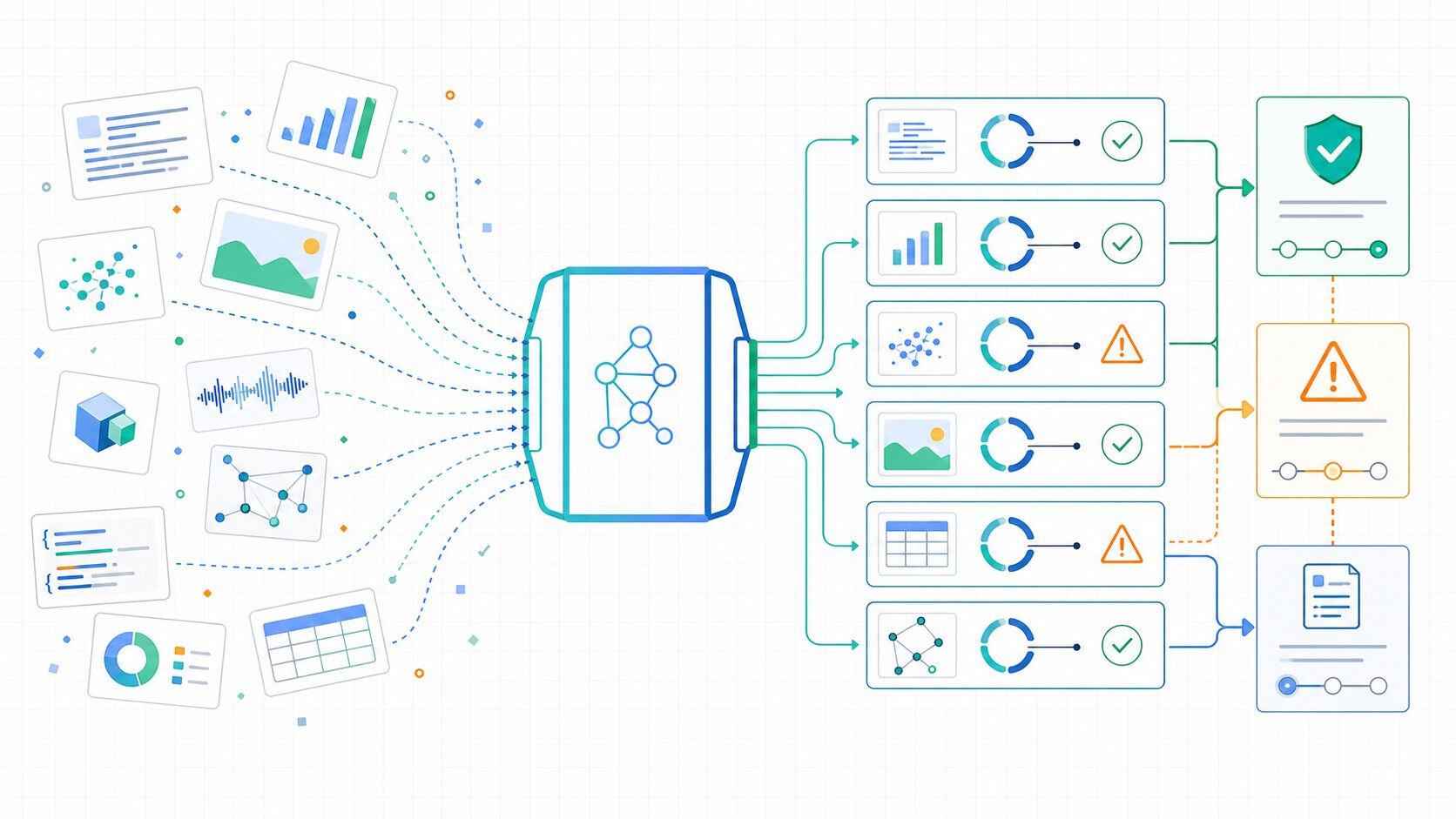

さらに、AIシステムはモデル単体では完結しないことが増えています。RAGでは検索エンジンやベクトルデータベースと連携します。業務AIでは社内文書、顧客データ、外部API、権限管理、監査ログとつながります。出力の良し悪しは、モデルだけでなく、検索対象の文書、プロンプト、前処理、後処理、権限設定、画面表示の設計にも左右されます。

このような複雑な構成で、問題が起きたときに「モデルが悪い」とだけ考えると原因を見誤ります。実際には、検索で必要な文書が取れていない、評価データが古い、プロンプトが曖昧、後処理で根拠が消えている、ユーザー権限に合わない情報が混ざっている、といった原因もあり得ます。ハーネスエンジニアリングは、こうした要素を切り分けて確認するための土台になります。

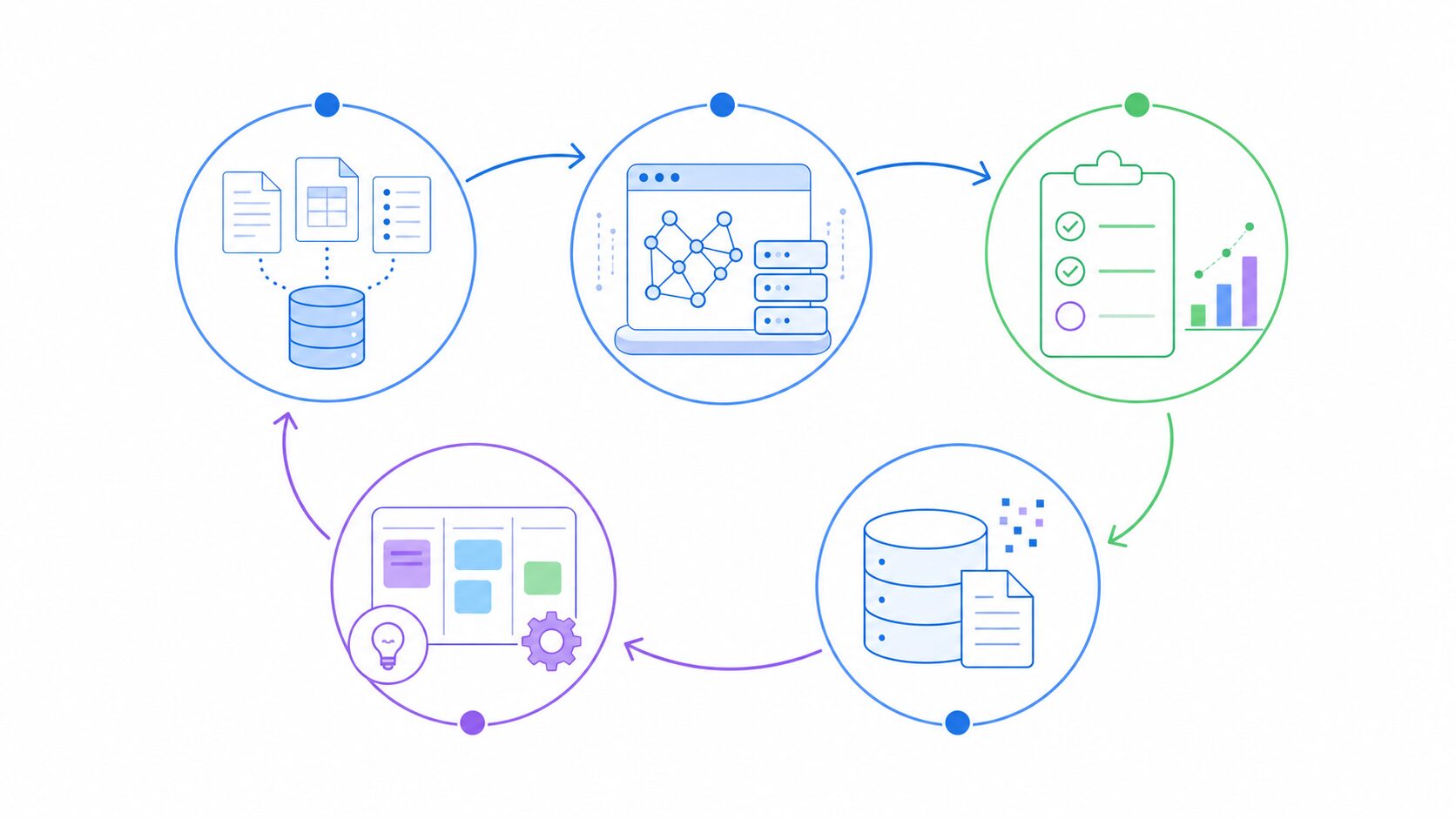

また、AI導入では一度作って終わりではなく、継続的な改善が必要です。モデルのバージョンが変わる、社内規程が変わる、FAQが更新される、ユーザーの質問傾向が変わる。こうした変化のたびに、以前と比べて品質がどう変わったかを確認できる仕組みが必要です。ハーネスがあれば、変更前後の回答を比較し、改善した点と劣化した点を見つけやすくなります。

ハーネスエンジニアリングを構成する主な要素

ハーネスエンジニアリングは、ひとつのツール名ではありません。複数の要素を組み合わせた設計の考え方です。代表的な要素は、入力データ、実行環境、評価基準、ログ、比較方法、改善サイクル、安全策です。それぞれが揃うことで、AIのふるまいを再現し、検証し、説明しやすくなります。

まず重要なのは入力データです。AIに何を試させるかが曖昧だと、評価も曖昧になります。FAQチャットボットなら、よくある質問、難しい質問、曖昧な質問、回答してはいけない質問、情報不足の質問などを含めます。文書要約なら、短い文書、長い文書、専門用語が多い文書、表を含む文書などを用意します。

次に実行環境です。どのモデルを使ったか、どのプロンプトを使ったか、検索対象のデータはどの時点のものか、温度などの生成設定は何かを記録します。これがないと、良い結果が出ても再現できません。再現できない結果は、実務上の判断材料として弱くなります。

評価基準も欠かせません。回答の正確性、根拠の有無、禁止事項への対応、表現の分かりやすさ、業務ルールへの適合、応答時間、コストなど、目的に応じて見る観点を決めます。すべてを一度に完璧に測ろうとする必要はありませんが、少なくとも「何を良いとするのか」を言語化しておくことが大切です。

ログと比較レポートは、ハーネスを実務で役立てるための重要な部品です。入力、出力、参照文書、評価結果、エラー、実行日時、モデルのバージョンを残しておけば、後から問題を調べられます。モデル変更前後の結果を並べると、改善と劣化を具体的に見られます。単に平均点だけを見るのではなく、どの質問で失敗したかを確認できることが重要です。

最後に、安全策と人間の確認です。AIの自動評価だけで、すべての品質やリスクを完全に判断するのは難しい場合があります。特に、医療、金融、法務、人事、個人情報、顧客対応などの高リスク領域では、人間のレビューや承認フローを組み込む必要があります。ハーネスエンジニアリングでは、AIに任せる部分と人間が確認する部分の境界も設計対象になります。

| 要素 | 役割 | 初心者向けの見方 |

|---|---|---|

| 入力データ | AIに試させる質問や文書を用意する | テスト問題集のようなもの |

| 実行環境 | モデル、プロンプト、設定、データ状態をそろえる | 同じ条件で試すための準備 |

| 評価基準 | 出力が目的に合っているか判定する | 採点基準やチェックリスト |

| ログ | 入力、出力、参照情報、判定を記録する | あとで見返せる実験ノート |

| 比較 | モデルやプロンプト変更の前後を比べる | 改善したか劣化したかを見る表 |

| 安全策 | 危険な出力や不適切な利用を抑える | ガードレールや人間の確認 |

具体例で見るハーネスエンジニアリングの使い方

具体例として、社内FAQチャットボットを作る場面を考えます。目的は、従業員からの問い合わせに対して、社内規程やマニュアルに基づいて回答することです。この場合、単に「AIに社内文書を読ませる」だけでは十分ではありません。回答の正確性、根拠の提示、回答できない質問への対応、古い情報への対処、権限ごとの情報制限などを確認する必要があります。

ハーネスを作る第一歩は、評価用の質問セットを作ることです。よくある質問だけでなく、あえて曖昧な質問、古い制度に関する質問、部署によって答えが変わる質問、個人情報を含む質問、社外秘に触れる質問などを入れます。これにより、AIが得意な場面だけでなく、失敗しやすい場面も見つけられます。

次に、AIにそれらの質問をまとめて投げ、回答、参照した文書、検索結果、応答時間を保存します。評価基準としては、正しい制度名を使っているか、根拠文書が合っているか、回答できない場合に無理に断定していないか、個人情報を出していないか、表現が分かりやすいか、などを設定できます。

この仕組みがあると、プロンプトを変えたとき、検索対象の文書を追加したとき、モデルを新しいものに変えたときの影響を比較できます。たとえば、新しいモデルに変えた結果、平均的な回答は自然になったが、根拠文書の引用が減ったと分かるかもしれません。あるいは、プロンプトを短くしたことで応答速度は上がったが、回答できない質問に対して断定する失敗が増えたと分かるかもしれません。

このように、ハーネスエンジニアリングは、AIの改善を「なんとなく良くなった」から「この条件では良くなり、この条件では悪くなった」と説明できる状態に近づけます。特にチームでAIを開発・運用する場合、評価結果が共有できる形で残っていることは大きな意味を持ちます。担当者の感覚だけに頼らず、議論の材料をそろえられるからです。

別の例として、文書要約AIでも同じ考え方が使えます。入力文書を複数用意し、要約の長さ、重要情報の欠落、誤った追加情報、専門用語の扱い、読みやすさを評価します。画像分類AIなら、明るさや角度が異なる画像、紛らわしい画像、未知の画像を用意し、分類結果と信頼度を記録します。つまり、対象がチャットであっても画像であっても、AIを試す条件と評価の流れを設計するという考え方は共通しています。

プロンプトエンジニアリングとの違い

ハーネスエンジニアリングと混同されやすい言葉に、プロンプトエンジニアリングがあります。プロンプトエンジニアリングは、主にAIへの指示文を工夫して、望ましい出力を得るための技術です。たとえば、役割を指定する、出力形式を決める、例を与える、制約条件を書く、といった工夫が含まれます。

一方、ハーネスエンジニアリングは、プロンプトだけを対象にしません。プロンプトも重要な部品ですが、それに加えて、テストデータ、実行条件、評価方法、ログ、比較、レビュー、監視まで扱います。プロンプトエンジニアリングが「AIにどう頼むか」に近いなら、ハーネスエンジニアリングは「頼んだ結果をどう試し、どう判断し、どう改善するか」に近いと言えます。

たとえば、あるプロンプトで回答が良くなったように見えたとします。しかし、数件の質問で試しただけでは、本当に改善したのか判断しにくいです。別の質問では悪くなっているかもしれません。特定の言い回しには強くなったが、曖昧な質問には弱くなった可能性もあります。ハーネスがあれば、同じ質問セットで変更前後を比べ、改善の範囲を確認できます。

| 観点 | プロンプトエンジニアリング | ハーネスエンジニアリング |

|---|---|---|

| 主な対象 | AIへの指示文 | AIを試す仕組み全体 |

| 目的 | 望ましい出力を引き出す | 出力を再現・評価・比較・改善する |

| 扱う範囲 | 役割指定、例示、制約、出力形式など | 入力データ、実行環境、評価基準、ログ、安全策など |

| 成果物 | プロンプトやテンプレート | 評価環境、テストセット、レポート、運用フロー |

| 初心者の理解 | AIへの質問の書き方 | AIを安心して使うための試験装置 |

両者は対立するものではありません。むしろ、実務では一緒に使います。良いプロンプトを作り、その効果をハーネスで確認する。ハーネスで失敗例を見つけ、その失敗を減らすためにプロンプトや検索方法を直す。この往復が、AIシステムの品質を高める基本的な流れになります。

MLOpsやテスト自動化との違い

ハーネスエンジニアリングは、MLOpsやテスト自動化とも関係があります。MLOpsは、機械学習モデルの開発、学習、デプロイ、監視、再学習などを継続的に回すための運用体系です。データパイプライン、モデル管理、実験管理、デプロイ、監視など、広い範囲を扱います。

ハーネスエンジニアリングは、その中でも特に「AIをどう試すか」「出力をどう評価するか」「変更の影響をどう見るか」に焦点を当てた考え方として理解すると分かりやすいです。MLOpsが工場全体の運用管理だとすれば、ハーネスエンジニアリングは検査装置や試験手順の設計に近い位置づけです。

テスト自動化との違いも重要です。一般的なソフトウェアテストでは、入力と期待出力を決めて、結果が一致するかを自動で確認することが多くあります。AIでもこの考え方は使えますが、生成AIでは期待出力がひとつに決まらないことがあります。そのため、完全一致だけでなく、評価基準、採点、類似度、人間のレビュー、危険表現の検出などを組み合わせる必要があります。

評価ベンチマークとの違いも押さえておきましょう。ベンチマークは、モデルやシステムの能力を一定の課題で測るための基準です。公開ベンチマークもあれば、社内独自のベンチマークもあります。ハーネスは、そのベンチマークを実行し、結果を保存し、比較し、運用に組み込むための枠組みを含みます。つまり、ベンチマークはハーネスの中で使われる部品になり得ます。

ガードレールとの関係もあります。ガードレールは、AIが危険な出力や不適切な操作をしないように制限する仕組みです。たとえば、個人情報を出さない、違法行為を助長しない、権限のない情報にアクセスしない、といった制御です。ハーネスエンジニアリングでは、ガードレールが期待通りに働くかをテストし、その結果を記録することも重要な対象になります。

初心者が注意したいポイント

ハーネスエンジニアリングを学ぶとき、最初に注意したいのは、難しい大規模な仕組みをいきなり作ろうとしないことです。小さなAI活用であれば、最初はスプレッドシートに質問、期待する観点、AIの回答、評価メモをまとめるだけでもハーネスの第一歩になります。重要なのは、評価をその場の印象だけで終わらせず、再利用できる形にすることです。

次に、評価基準を曖昧にしすぎないことです。「良い回答」という言葉だけでは、人によって判断が変わります。正確か、根拠があるか、短すぎないか、長すぎないか、禁止情報を含まないか、ユーザーの意図に答えているか。こうした観点に分けると、失敗の原因を見つけやすくなります。

また、AIによる自動採点を過信しないことも大切です。AIにAIの回答を評価させる方法は便利ですが、評価するAIも間違えることがあります。特に、業務上の細かいルール、最新の社内事情、法的な判断、倫理的な配慮が関わる場合は、人間の確認を組み合わせる必要があります。自動評価は、すべてを決める審判ではなく、問題の候補を絞る補助として考えると実務に合います。

さらに、テストデータの偏りにも注意が必要です。簡単な質問ばかりで評価すると、実際の運用で複雑な質問に弱いことを見逃します。逆に難しい質問ばかりにすると、普通の質問への使いやすさを見落とすことがあります。実際の利用場面を想定し、よくあるケース、境界ケース、禁止ケース、想定外ケースをバランスよく含めることが重要です。

最後に、ハーネスは一度作って終わりではありません。業務、データ、モデル、ユーザーの使い方が変われば、評価項目も更新する必要があります。古い評価セットだけに合わせて改善を続けると、現実の利用からずれていく可能性があります。定期的に失敗ログを見直し、新しい質問や問題例を追加することが、ハーネスを実用的に保つコツです。

学習や実務での始め方

初心者がハーネスエンジニアリングを学ぶなら、まず小さな題材を選ぶのがおすすめです。たとえば「社内ルールに関する質問に答えるAI」「長い議事録を要約するAI」「商品レビューを分類するAI」のように、目的がはっきりした題材を選びます。目的が曖昧なままでは、評価基準も曖昧になります。

次に、10件から30件程度のテスト入力を作ります。数は少なくても構いませんが、同じ種類の入力だけに偏らないようにします。代表的な質問、難しい質問、誤解しやすい質問、回答してはいけない質問を混ぜると、AIの特徴が見えやすくなります。最初から大量のデータを集めるより、少数でも意味のあるケースを丁寧に作るほうが学習効果は高いです。

そのうえで、評価観点を決めます。正確性、根拠、簡潔さ、分かりやすさ、安全性、形式の一致などから、目的に合うものを選びます。点数で評価してもよいですし、合格、不合格、要確認の3段階でも構いません。大切なのは、あとで見返したときに、なぜその評価になったか分かるメモを残すことです。

実務で使う場合は、ログの扱いにも気を配ります。入力に個人情報や機密情報が含まれるなら、保存場所、閲覧権限、保持期間を決める必要があります。AIの評価をするために集めたログが、別のリスクを生まないようにしなければなりません。ハーネスエンジニアリングは品質改善だけでなく、運用上の安全管理ともつながっています。

慣れてきたら、モデル、プロンプト、検索データ、評価基準を別々に変更し、どの変更がどの結果につながったかを比較します。一度に多くの要素を変えると、改善の理由が分かりにくくなります。たとえば、最初はプロンプトだけを変える、次に検索対象の文書だけを増やす、最後にモデルを変える、というように段階的に進めると学びやすくなります。

ハーネスエンジニアリングが役立つ場面

ハーネスエンジニアリングは、AIを業務で使うほぼすべての場面で役立ちますが、特に効果が大きいのは、品質の説明責任が必要な場面です。顧客向けチャットボット、社内ナレッジ検索、契約書レビュー支援、問い合わせ分類、FAQ生成、文書要約、コード生成支援などでは、出力の良し悪しを継続的に確認する必要があります。

顧客向けチャットボットでは、間違った回答が顧客体験や信頼に直結します。ハーネスを使えば、よくある問い合わせ、クレームに近い問い合わせ、規約に関わる問い合わせ、回答を避けるべき問い合わせを定期的に試せます。新しいキャンペーンや規約変更があったときも、変更後の回答を確認しやすくなります。

社内ナレッジ検索では、正しい文書を参照しているかが重要です。回答だけが自然でも、根拠文書が違っていれば実務では危険です。ハーネスにより、検索された文書、回答内容、根拠の一致をまとめて確認できます。特にRAGでは、検索部分と生成部分のどちらに問題があるのかを切り分けるために役立ちます。

コード生成支援でも、ハーネスの考え方は使えます。AIが生成したコードがビルドできるか、テストを通るか、既存の設計に合っているか、セキュリティ上の問題がないかを確認する流れを作れます。単にコードを出させるだけでなく、実行、検査、レビューまで含めて仕組みにすると、AI支援の品質を安定させやすくなります。

ハーネスエンジニアリングを理解するための身近な比喩

ハーネスエンジニアリングは、車の試験コースに似ています。車そのものがAIモデルだとすると、試験コース、計測器、安全柵、運転条件、評価表がハーネスにあたります。車の性能を知るには、ただ走らせるだけでは不十分です。速度、ブレーキ、カーブ、雨の日、荷物を積んだ状態など、条件をそろえて試す必要があります。

AIも同じです。ひとつの質問で良い回答が返ってきたからといって、すべての場面で安心できるわけではありません。さまざまな入力で試し、結果を記録し、危険なケースを見つけ、改善後にもう一度同じ条件で試す必要があります。ハーネスは、そのための試験コースや計測器の役割を果たします。

もうひとつの比喩は、料理のレシピと試食表です。プロンプトはレシピに近いものです。材料や手順を書き、望ましい料理を作ろうとします。しかし、料理の品質を安定させるには、毎回の味、温度、見た目、提供時間、アレルギー表示などを確認する必要があります。ハーネスエンジニアリングは、その確認と改善の仕組みに近いと言えます。

この比喩から分かるように、ハーネスは創造性を邪魔するものではありません。むしろ、安心して試行錯誤するための土台です。評価の仕組みがあるからこそ、プロンプトを変えたり、モデルを変えたり、データを追加したりしたときに、結果を冷静に比べられます。

まとめ

ハーネスエンジニアリングとは、AIモデルやAIシステムを安全かつ再現可能に試すための周辺仕組みを設計する考え方です。入力データ、実行環境、評価基準、ログ、比較、ガードレール、人間の確認を組み合わせ、AIのふるまいを見える形にします。

プロンプトエンジニアリングがAIへの指示文を工夫する技術であるのに対し、ハーネスエンジニアリングは、その指示やモデル変更の効果をどう評価するかまで含みます。MLOpsやテスト自動化とも関係しますが、特にAIの出力を試し、比べ、改善するための枠組みに焦点があります。

初心者は、まず小さな質問セットと評価表から始めると理解しやすくなります。最初から大規模な自動化を目指す必要はありません。重要なのは、AIの回答を印象だけで判断せず、同じ条件で試し、結果を残し、改善につなげることです。

AI活用が広がるほど、「どのモデルを使うか」だけでなく、「どう評価し、どう安全に運用するか」が重要になります。ハーネスエンジニアリングは、そのための実務的な考え方です。AIを試す仕組みを整えることで、チームは改善の理由を説明しやすくなり、利用者にとっても安心して使いやすいAIシステムに近づけます。

更新履歴

| 日付 | 内容 |

|---|---|

| 2026年4月30日 | 初回公開 |