アルゴリズム

アルゴリズム デンドログラム:データの樹形図

資料を調べるとき、似たものを集めて仲間分けすることは、隠された結びつきや仕組みを見つけるためにとても大切です。この仲間分けをクラスタリングと言い、その結果を分かりやすく絵で示す方法の一つがデンドログラムです。デンドログラムは、木の枝のようにデータの集まりを図で表すので、データの似ているところやグループの構造が一目で分かります。この記事では、デンドログラムとは何か、どう読み解くのか、そしてどんなふうに使えるのかを詳しく説明します。

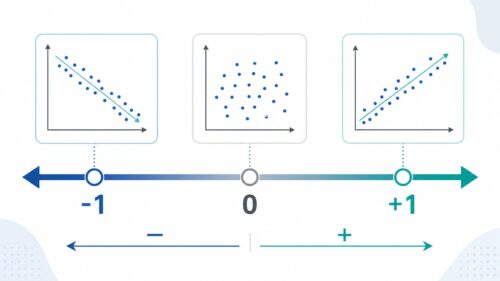

デンドログラムは、階層的なクラスタリングの結果を視覚的に表現したものです。階層的クラスタリングとは、最初は個々のデータを別々のグループとして扱い、徐々に似たグループ同士を結合していくことで、最終的に一つの大きなグループになるまで繰り返す方法です。この過程を樹形図で表したのがデンドログラムで、縦軸はグループ同士の似ていない度合いを表しています。縦軸の値が大きいほど、二つのグループは似ていないということを示しています。横軸には、個々のデータやグループが並んでいます。

デンドログラムを読み解くには、まず縦軸の目盛りと枝分かれの位置に注目します。枝分かれの位置が上の方にあるほど、二つのグループは似ていないことを意味します。逆に、枝分かれの位置が下の方にあるほど、二つのグループは似ていると言えます。例えば、あるデンドログラムで二つのグループが低い位置で枝分かれしていたとします。これは、この二つのグループに属するデータは互いに似ているということを示唆しています。そして、適切な高さでデンドログラムを水平に切ると、その高さに対応する数のグループにデータを分割できます。

デンドログラムは、様々な分野で活用されています。例えば、生物学では生物の進化系統を分析するために、マーケティングでは顧客をグループ分けするために利用されています。また、画像認識や自然言語処理といった分野でも、データの分類や構造の理解に役立っています。デンドログラムを用いることで、データの背後にある複雑な関係性を分かりやすく把握し、新たな発見につなげることが期待できます。