アルゴリズム

アルゴリズム ベイズ統計学:不確実性へのアプローチ

統計学は、世の中にあふれる情報の中から法則や傾向を見つけ出すための学問です。数値情報、いわゆるデータを分析することで、物事をより深く理解したり、未来を予測したりする強力な道具となります。統計学には様々な考え方がありますが、中でもベイズ統計学は、不確実な状況をうまく扱うことができるという点で注目されています。

従来の統計学は、大量のデータが手に入ることを前提としています。たくさんのデータがあれば、そこから確かな法則を見つけることができると考えるからです。しかし、現実の世界では、必ずしも十分なデータが得られるとは限りません。例えば、新製品の売れ行きを予測する場合、過去の販売データは存在しません。また、珍しい病気の診断では、症例数が少なく、データが限られています。このようなデータが不十分な状況では、従来の統計学ではうまく対応できないことがあります。

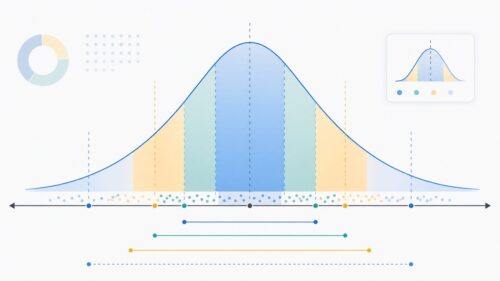

ベイズ統計学は、このような不確実性の高い状況でも、限られた情報から推論することを可能にします。ベイズ統計学では、あらかじめ持っている知識や経験を「事前確率」という形で表現します。そして、新しく得られたデータを使って、この事前確率を修正し、「事後確率」と呼ばれる、より確かな確率を求めます。例えるなら、天気予報のようなものです。明日の天気は、今日の天気や過去の気象データから予測します。これが事前確率です。そして、最新の気象観測データが得られたら、その情報を加味して予測を修正します。これが事後確率です。このように、ベイズ統計学は、常に情報を更新していくことで、より正確な予測に近づこうとする考え方です。

データが不足している状況でも、ベイズ統計学は、事前確率を柔軟に設定することで、何とかして確率を導き出すことが可能です。この柔軟性こそが、ベイズ統計学の大きな強みであり、様々な分野で注目されている理由です。