アルゴリズム

アルゴリズム Q学習:試行錯誤で学ぶAI

機械に学習をさせる方法は、この情報化社会において様々な分野で研究開発が進められています。その学習方法の中でも、強化学習は特に注目を集めているものの一つです。強化学習とは、人間が様々な経験を通して学習していくように、機械も周りの状況と関わり合いながら、一番良い行動を学習していく方法です。

この強化学習の代表的な方法の一つに、今回ご紹介するQ学習があります。Q学習は、様々な分野で活用されており、その応用範囲は実に多様です。例えば、ゲームの攻略方法を学習させたり、機械仕掛けの人形を思い通りに動かす制御に使われたり、あるいは商品の広告をより効果的に配信するために活用されたりしています。

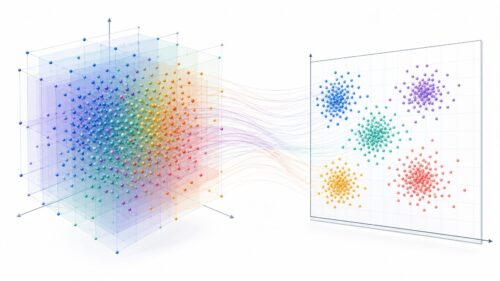

Q学習では、行動の価値を数値で表す「Q値」というものを用います。機械は、様々な行動を試してみて、その結果得られる報酬と、その行動を取った後の状態でのQ値を元に、現在の状態でのQ値を更新していきます。この更新を繰り返すことで、機械はどの行動が最も高い報酬に繋がるかを学習し、最適な行動を選択できるようになるのです。

Q学習は、試行錯誤を通して学習を進めるため、事前に正解を用意する必要がありません。そのため、複雑な状況や未知の環境に対しても、柔軟に適応することができます。また、比較的単純な仕組みで実装できるため、様々な分野への応用が容易である点も大きな特徴です。

このように、Q学習は、機械学習の中でも特に注目される技術であり、今後の発展が期待される分野です。人間のように学習する機械の実現に向けて、Q学習は重要な役割を担っていると言えるでしょう。