アルゴリズム

アルゴリズム R-CNN:物体検出の革新

近頃は技術の進歩がめざましく、特に絵を理解する技術は大きく進歩しました。この絵を理解する技術は、自動で車を運転したり、病気を見つけるために使われたりと、様々な場面で使われており、私たちの暮らしをより良くするための大切な技術です。中でも、絵の中に写っているものを探し出し、それが何であるかを当てる「もの探し」は重要な役割を担っています。

例えば、お店に設置された監視カメラで怪しい人物を見つける、工場で不良品を見つけるなど、私たちの安全を守る上でも、この「もの探し」の技術は欠かせません。これまで、絵の中のものを探し出すのは、人の目で行うのが一般的でした。しかし、人の目で確認する作業は、どうしても時間がかかってしまう上に、見落としも発生してしまう可能性があります。また、扱う絵の量が多い場合は、作業者の負担も大きくなってしまいます。そこで、機械に「もの探し」をさせる技術が求められるようになりました。

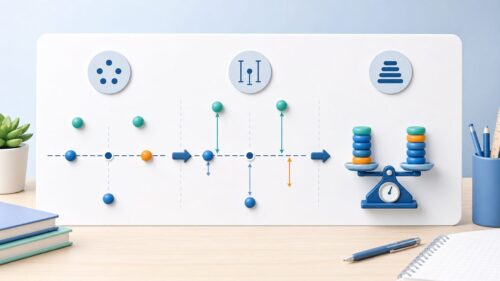

この技術革新の中心にあるのが「R-CNN」と呼ばれる技術です。R-CNNは、このような「もの探し」の技術に革新をもたらした画期的な方法であり、その後の技術発展に大きく貢献しました。従来の方法では、絵全体を細かく調べていましたが、R-CNNはまず「ここに何かありそう」という場所をいくつか絞り込み、その絞り込んだ場所だけを詳しく調べるという方法をとっています。これにより、処理速度が大幅に向上し、より正確にものを見つけることができるようになりました。

この資料では、R-CNNの仕組みや特徴について、具体例を交えながら分かりやすく解説します。R-CNNがどのように「もの探し」を行い、どのような利点があるのかを理解することで、この技術の重要性と将来性を感じていただければ幸いです。