アルゴリズム

アルゴリズム 中央値とは?求め方・平均値との違い・使いどころを初心者向けに解説

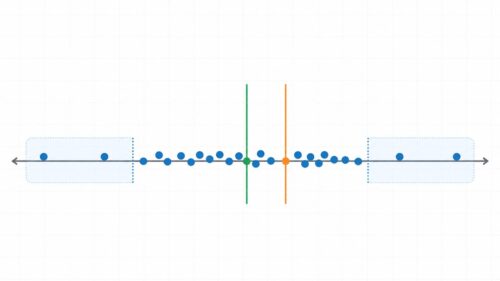

真ん中の値を表す言葉、それが中央値です。データを小さい順に並べ替えたとき、ちょうど中心に位置する値のことを指します。例えば、一か月のお小遣いの記録を思い浮かべてみましょう。金額が少ない順に記録を整理していくと、全体の真ん中にくる金額が中央値です。

データの数が奇数の場合、中央値を見つけるのは簡単です。例えば、1、3、5、7、9という五つの数字があったとします。小さい順に並べると、真ん中の数字である5が中央値となります。

一方、データの数が偶数の場合、少し計算が必要です。例えば、1、3、5、7という四つの数字を考えます。この場合、真ん中は3と5の二つの数字になります。そこで、この二つの数字を足して2で割ります。(3+5)÷2=4。つまり、中央値は4になります。これは、真ん中の二つの数字の平均値を計算していることと同じです。

中央値は、データの中心的な傾向を示す指標として、平均値と共に使われます。平均値は、すべてのデータを足し合わせてデータの数で割ることで計算されますが、極端に大きな値や小さな値に影響を受けやすい性質があります。例えば、クラスのテストの点数を考えてみると、一人だけ飛び抜けて高い点数を取った人がいると、平均点は高くなります。しかし、中央値は極端な値に影響されにくいため、データ全体の中心的な傾向をより正確に捉えるのに役立ちます。そのため、データの中に極端な値が含まれる場合は、平均値ではなく中央値を見ることで、より実態に即した分析をすることができます。