AI活用

AI活用 分類問題:機械学習の基本

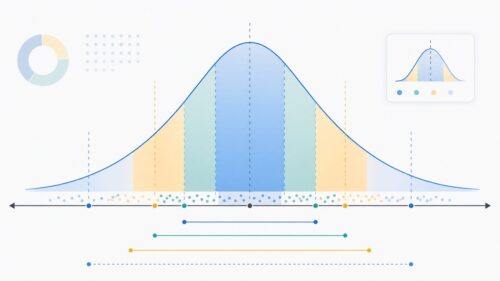

分類問題は、ものごとを決められた種類に仕分けする問題です。ものごとの特徴をつかんで、どの種類に当てはまるかを判断します。身近な例では、果物を種類ごとに分ける作業が挙げられます。りんご、みかん、バナナをそれぞれのかごに入れるのは、まさに分類問題を解いていることになります。

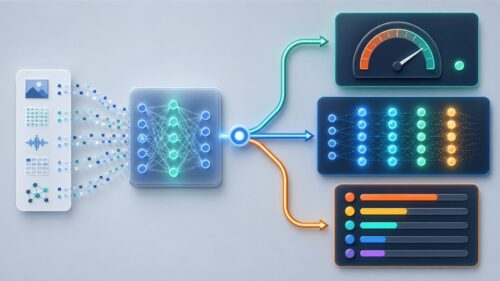

機械学習の世界では、この分類問題をコンピュータに解かせるための方法が盛んに研究されています。コンピュータに大量のデータを見せて、それぞれのデータの特徴を学習させます。たとえば、たくさんのりんご、みかん、バナナの画像を見せることで、それぞれの果物の形や色、模様などの特徴をコンピュータに覚えさせます。この学習が終わると、コンピュータは新しい果物の画像を見せられても、それがどの果物なのかを高い確度で当てられるようになります。

学習には様々な方法があり、それぞれに得意不得意があります。決定木と呼ばれる方法は、まるで樹形図のように条件分岐を繰り返して分類を行います。一方、サポートベクトルマシンと呼ばれる方法は、データの境界線をうまく引くことで分類を行います。また、最近注目を集めている深層学習は、人間の脳の仕組みを模倣した複雑な計算で、より高度な分類を可能にします。

分類問題は、様々な分野で活用されています。迷惑メールの自動振り分けや、手書き文字の認識、医療画像診断など、私たちの生活を支える多くの技術に分類問題が関わっています。例えば、迷惑メールの振り分けでは、メールの本文や送信元情報などの特徴から、迷惑メールかどうかをコンピュータが自動的に判断します。手書き文字の認識では、文字の画像から、それがどの文字なのかをコンピュータが判別します。医療画像診断では、レントゲン写真やCT画像などの画像データから、病気の有無や種類をコンピュータが補助的に判断します。このように、分類問題は現代社会の様々な場面で役立っています。