プラトー現象とは?機械学習で学習が停滞する原因と対策

AIの初心者

「プラトー」って勾配降下法で出てくる言葉ですよね?どんな状態を指すんですか?

AI専門家

プラトーは、勾配が小さい平坦な領域に入り、学習がなかなか進まなくなる状態のことだよ。緩やかな高原に置いたボールが、ほとんど転がらない様子を思い浮かべると近いね。

AIの初心者

平らな場所だから動きにくいんですね。AIの学習では、どんな問題につながるんですか?

AI専門家

損失が下がりにくくなり、精度などの性能も伸びにくくなる。学習率、最適化手法、データの見直しで抜け出せることがあるから、原因を切り分けることが大切だよ。

プラトー現象とは。

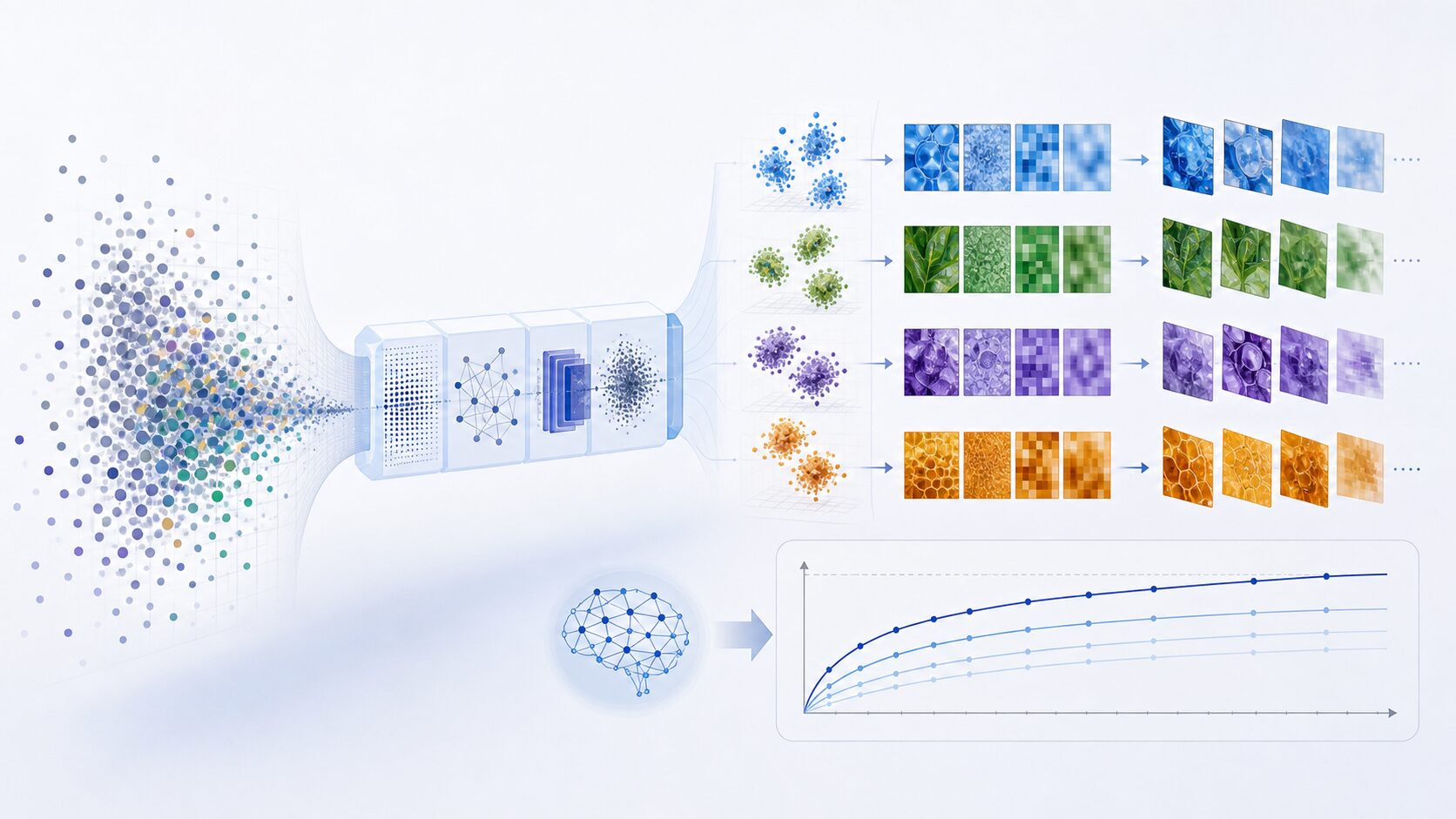

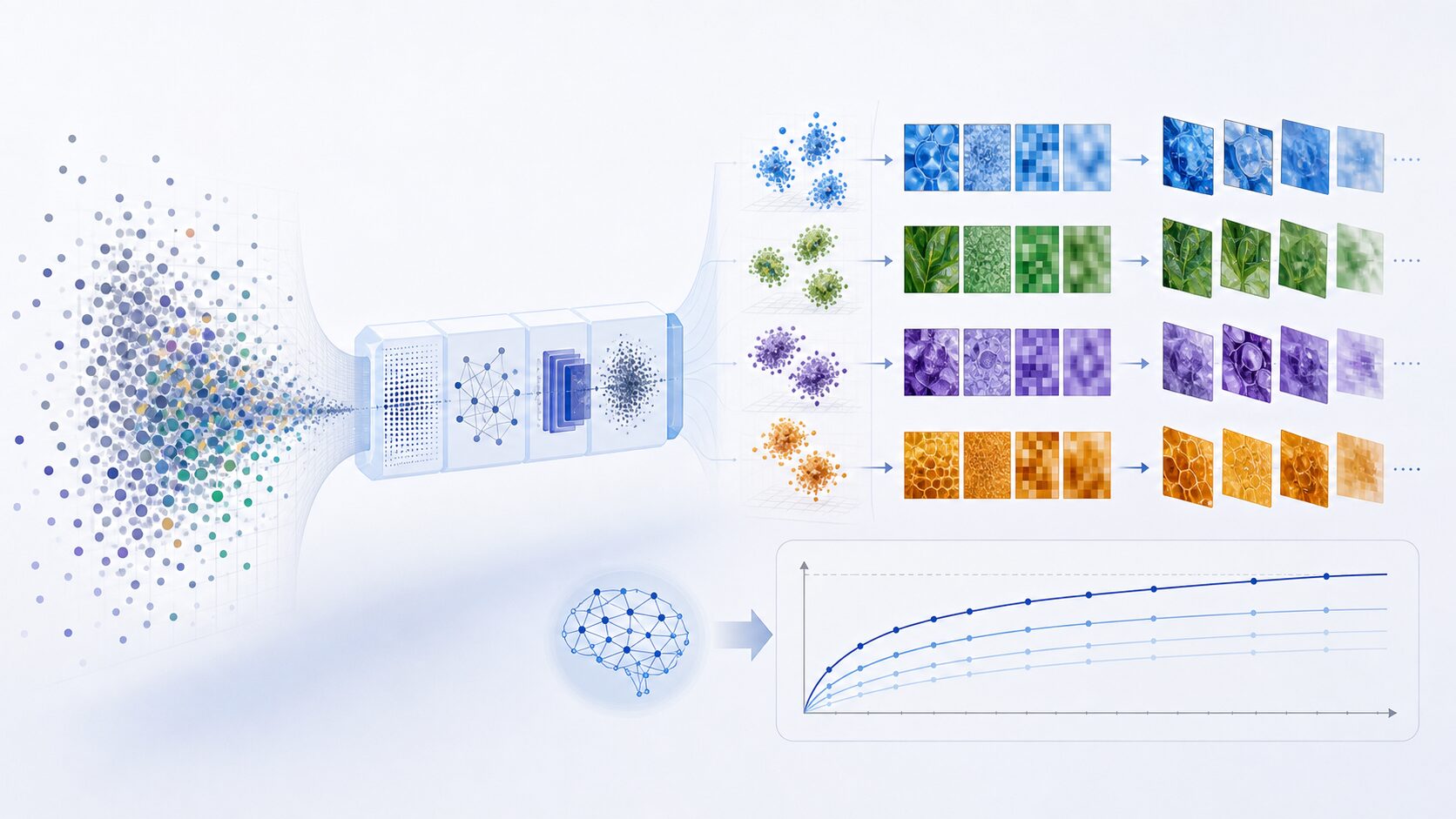

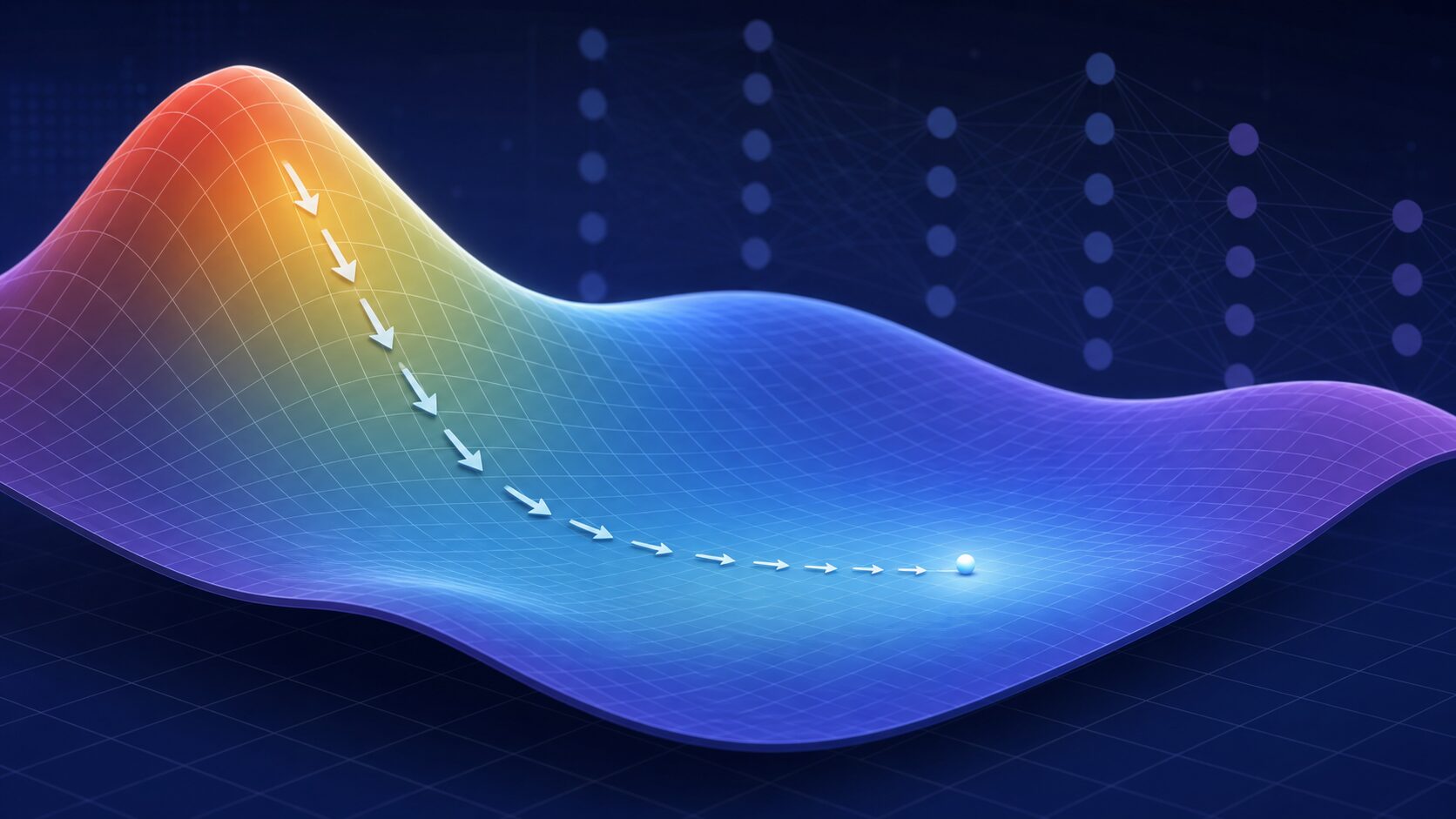

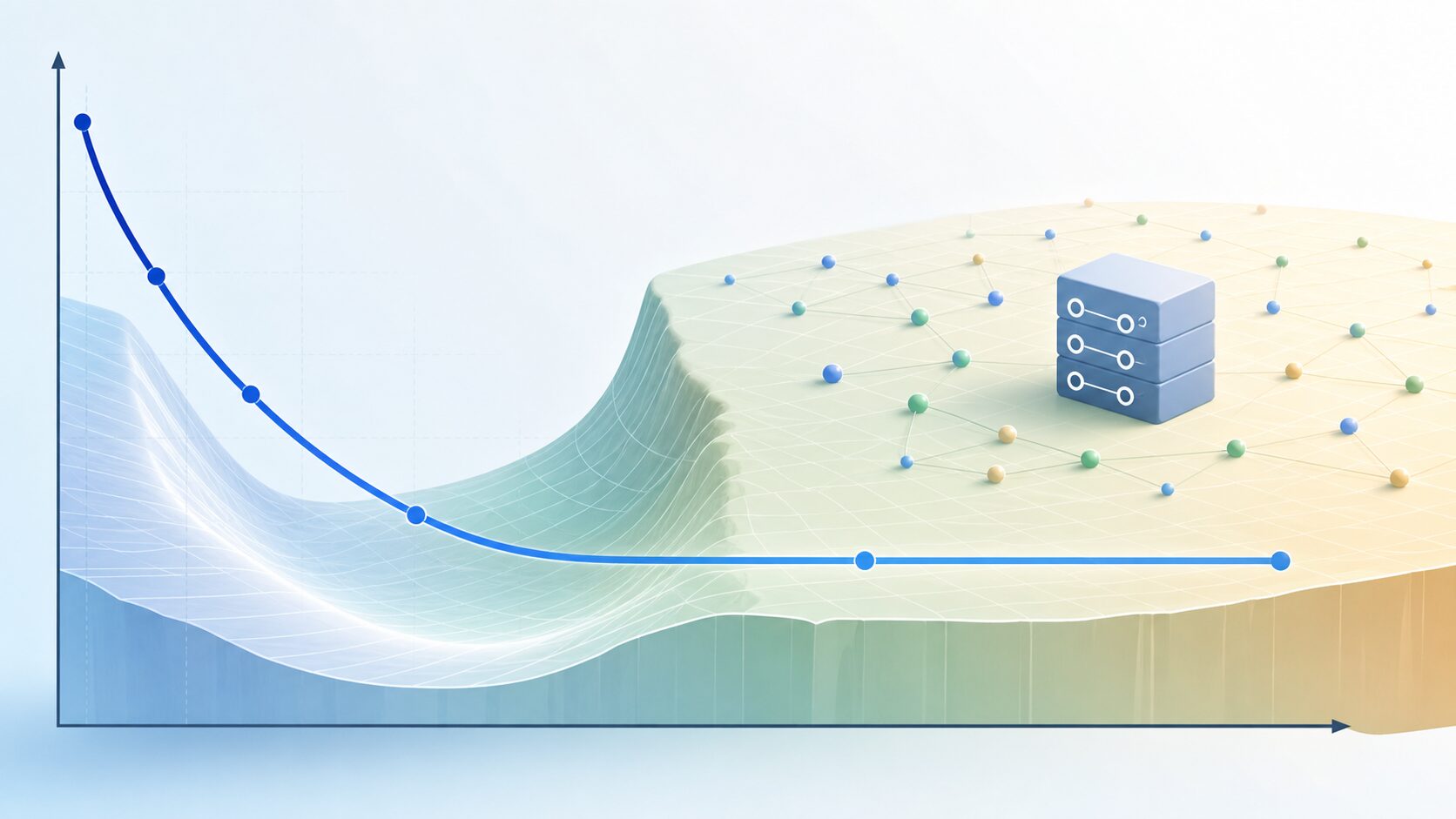

機械学習では、勾配降下法などでモデルのパラメータを少しずつ更新し、損失が小さくなる方向を探します。ところが、損失関数の地形が平坦に近い領域に入ると、更新の手がかりである勾配が小さくなり、学習が停滞します。この状態がプラトー現象です。鞍点や局所的な平坦領域と関係することもあり、深層学習では特に注意が必要です。

プラトー現象とは

プラトー現象とは、学習を続けているのに損失や評価指標の改善が小さくなり、モデルの性能が伸び悩んでいるように見える状態です。日本語では「高原状態」「学習の停滞」と説明されることもあります。

機械学習の学習は、損失関数という地形の上で、より低い場所を探す作業にたとえられます。傾きがはっきりしていれば、どちらへ進めばよいか判断しやすい一方、地形がほとんど平らな場所では進む方向が分かりにくくなります。この平坦な領域に入ると、更新量が小さくなり、学習曲線が横ばいに近づきます。

重要なのは、プラトーが必ずしも「これ以上よくならない最終地点」を意味しないことです。学習率、最適化手法、データの扱いを変えると、同じモデルでも再び改善が進む場合があります。そのため、プラトーを見つけたら、学習完了と決めつけず、原因を分けて確認する必要があります。

勾配降下法でプラトーが起きる仕組み

勾配降下法は、損失が小さくなる方向へパラメータを更新する基本的な最適化手法です。更新は、現在のパラメータ、学習率、勾配を使って考えます。

\(\theta_{t+1} = \theta_t – \eta g_t\)ここで、\(\theta_t\) は現在のパラメータ、\(\eta\) は学習率、\(g_t\) は損失に対する勾配です。勾配 \(g_t\) が大きければ更新量も大きくなりますが、プラトーでは \(g_t\) が非常に小さくなり、\(\theta\) がほとんど動かなくなります。

深層学習では、損失関数の地形が高次元で複雑です。そのため、単純な谷底だけでなく、ある方向には上り坂、別の方向には下り坂になっている鞍点や、広く平坦な領域を通ることがあります。見た目には改善が止まったようでも、少し離れた方向にはまだ下がれる経路が残っている場合があります。

また、プラトーは勾配消失と混同されやすい概念です。勾配消失は、誤差逆伝播の途中で勾配が極端に小さくなり、浅い層まで学習信号が届きにくくなる問題です。一方、プラトーは損失地形上の平坦さにより、最適化の進みが遅くなる状態を広く指します。両者は関連しますが、完全に同じ意味ではありません。

プラトーに陥る主な原因

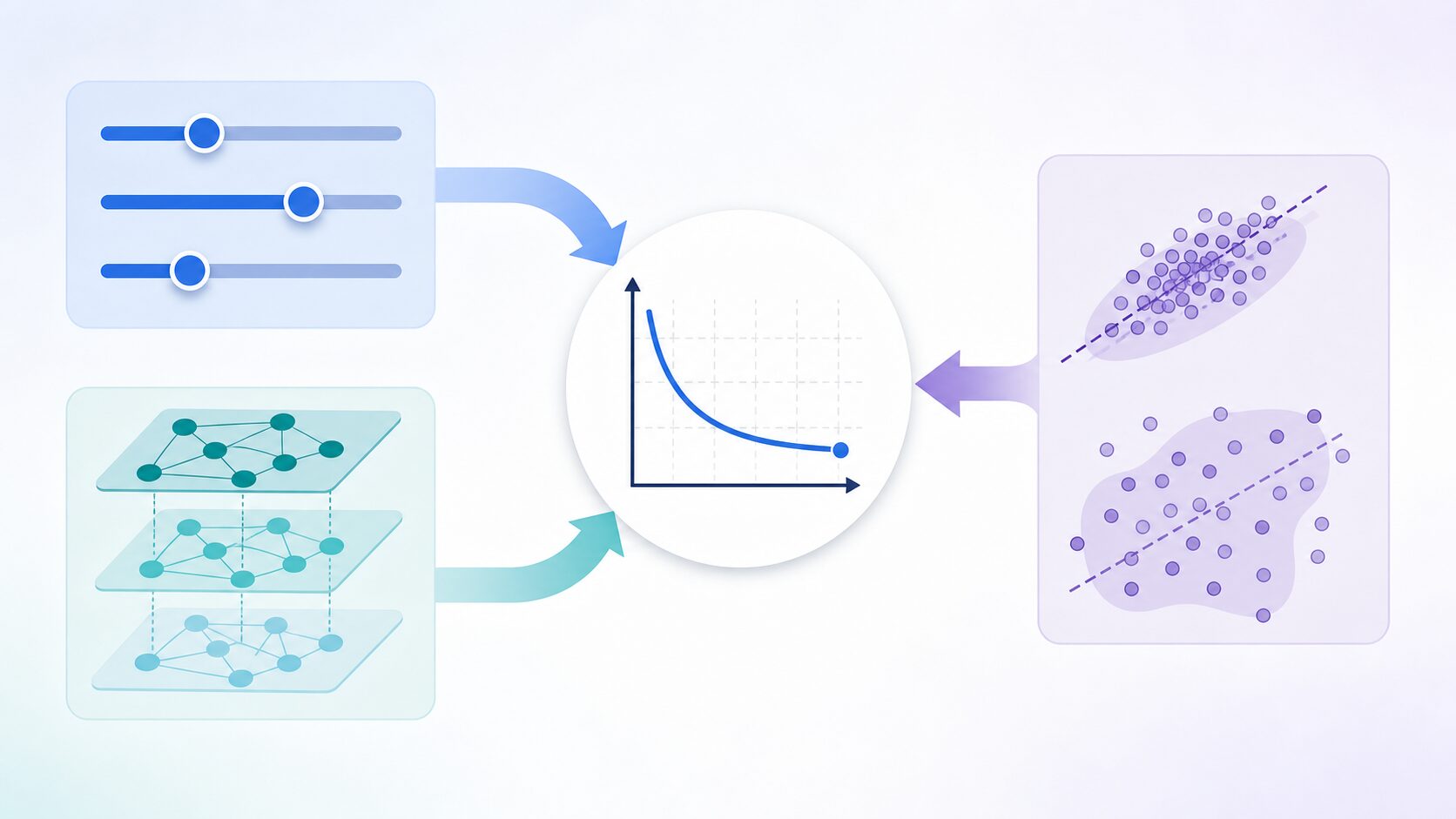

プラトーは一つの原因だけで起きるとは限りません。実務では、学習率、モデルの構造、データの質と量、損失関数、バッチサイズなどが組み合わさって発生します。

最初に確認したいのは学習率です。学習率が低すぎると、たとえ正しい方向へ進んでいても一回ごとの更新が小さく、学習曲線がほとんど動かないように見えます。反対に、学習率が高すぎると最適な領域を飛び越え、損失が振動したり不安定になったりします。

モデル構造も影響します。層が深い、パラメータが多い、活性化関数や初期値が合っていないと、最適化すべき空間が複雑になり、平坦な領域や鞍点に入りやすくなります。特に深いニューラルネットワークでは、初期化や正規化の方法が学習の進みやすさを大きく左右します。

さらに、データにノイズや偏りが多い場合、モデルは一貫した規則を見つけにくくなります。ラベルの誤り、外れ値、クラスの偏り、学習データの不足があると、損失が下がりにくくなり、プラトーのような停滞が起こります。学習の問題に見えても、実際にはデータ側の問題であることは少なくありません。

| 原因 | 起きやすい症状 | 確認すること |

|---|---|---|

| 学習率が低すぎる | 損失が少しずつしか下がらない | 学習率を段階的に上げて比較する |

| 学習率が高すぎる | 損失が振動する、発散する | 学習率を下げる、スケジューラを使う |

| モデルが複雑すぎる | 学習が不安定、収束が遅い | 初期化、正規化、構造を見直す |

| データの質が低い | 訓練損失も検証指標も伸びにくい | 前処理、ラベル、外れ値を確認する |

プラトーから抜け出すための対策

プラトーへの対策は、闇雲にモデルを大きくすることではありません。まず学習曲線を確認し、訓練損失、検証損失、評価指標がどのように動いているかを見ます。そのうえで、変更する要素を一つずつ絞ると原因を特定しやすくなります。

代表的な対策は、学習率の調整、最適化手法の変更、正則化、データ改善です。学習率が小さすぎるなら一時的に上げる、学習の後半で細かく調整したいなら徐々に下げる、といった方法があります。一定期間改善しないときに学習率を下げるスケジューラもよく使われます。

最適化手法を変えることも有効です。単純なSGDで停滞する場合、Momentumを入れると過去の勾配の勢いを使って平坦な領域を抜けやすくなります。Adamは変数ごとに更新量を調整するため、初期実験で安定した結果を得やすい手法として使われます。

ただし、対策を同時に入れすぎると、何が効いたのか分からなくなります。初心者は、まず学習率と最適化手法を比較し、次にデータ前処理や正則化を見直す順序にすると、原因を追いやすくなります。

学習率をどう調整するか

学習率 \(\eta\) は、パラメータ更新の歩幅です。高すぎると最適な地点を飛び越え、低すぎるとプラトーでほとんど進まなくなります。学習率の調整では、固定値だけでなく、学習の進み具合に応じて変える方法を考えます。

よく使われるのは、最初は比較的大きめの学習率で探索し、学習が進むにつれて小さくする方法です。たとえば、一定エポックごとに学習率を半分にする、検証損失が改善しなくなったら下げる、周期的に学習率を上下させる、といった選択肢があります。

プラトーが疑われるときは、損失が「ゆっくり下がっている」のか「完全に止まっている」のかを分けて見ます。ゆっくり下がっているなら学習率やエポック数の調整で足りる場合があります。完全に止まり、検証指標も動かない場合は、最適化手法、モデル構造、データ品質まで確認した方がよいでしょう。

| 調整方法 | 使いどころ | 注意点 |

|---|---|---|

| 段階的に下げる | 学習後半で細かく収束させたいとき | 下げる時期が早すぎると停滞する |

| 改善停止時に下げる | 検証損失を見ながら調整したいとき | 短期的な揺れで判断しない |

| 一時的に上げる | 平坦な領域から抜けたいとき | 発散しない範囲で試す |

最適化手法の選び方

最適化手法は、損失関数の地形をどのように進むかを決める方法です。基本のSGDは仕組みが分かりやすく、汎化性能がよい結果につながることもありますが、勾配が小さい領域では進みが遅くなりがちです。

Momentumは、過去の勾配を考慮して更新に勢いを持たせます。ボールが坂を転がるように、同じ方向への更新を積み重ねられるため、平坦な領域や浅い谷を抜けやすくなります。プラトー対策として説明される代表的な方法です。

Adamは、Momentumの考え方に加えて、パラメータごとに学習率を調整する性質を持ちます。初期設定でも扱いやすく、深層学習の実験でよく使われます。ただし、どの問題でも常に最良とは限らないため、最終的な性能を重視する場合はSGD系との比較も必要です。

| 手法 | 特徴 | プラトーへの効き方 |

|---|---|---|

| SGD | 勾配に従って単純に更新する | 平坦な領域では進みが遅いことがある |

| Momentum | 過去の更新方向を利用する | 勢いで停滞を抜けやすくする |

| Adam | パラメータごとの更新量を自動調整する | 初期実験で安定しやすい |

データの質と量を見直す

プラトー対策では、モデルや学習率だけでなくデータも確認します。データの質が低いと、モデルは安定したパターンを見つけにくく、損失が下がりにくくなります。ノイズ、外れ値、ラベルミス、クラスの偏りは、学習停滞の原因になります。

前処理では、欠損値の扱い、外れ値の確認、正規化や標準化、重複データの削除などを行います。画像であれば明るさやサイズの統一、テキストであれば表記ゆれや不要文字の処理も重要です。これらは地味ですが、最適化手法を変えるより大きく効くことがあります。

データ量が少ない場合は、データ拡張も選択肢になります。画像の回転、反転、切り抜き、明るさ変更などを使うと、既存データから多様な訓練例を作れます。ただし、タスクの意味を壊す加工は逆効果です。たとえば、左右反転で意味が変わる画像分類では、安易な反転を避ける必要があります。

プラトーと関連概念の違い

プラトーは、過学習や局所最適解、鞍点、勾配消失と一緒に語られます。これらは学習がうまく進まない原因として関連しますが、見ている現象は少しずつ異なります。

| 用語 | 意味 | 見分けるポイント |

|---|---|---|

| プラトー | 損失地形が平坦で学習が停滞する状態 | 訓練損失の改善が小さい |

| 鞍点 | 方向によって上りにも下りにもなる点 | 一見止まったようでも下がれる方向がある |

| 局所最適解 | 近くでは最適だが全体では最適でない点 | 別の初期値で結果が変わることがある |

| 勾配消失 | 逆伝播で勾配が非常に小さくなる問題 | 深い層や活性化関数の影響を受けやすい |

| 過学習 | 訓練データに合わせすぎて汎化しない状態 | 訓練損失は下がるが検証性能が悪化する |

学習曲線を見るときは、訓練データだけでなく検証データの指標も並べて確認します。訓練損失も検証損失も止まるならプラトーや最適化の問題が疑われます。訓練損失だけ下がり、検証性能が悪化するなら、過学習への対策を優先します。

まとめ

プラトー現象は、機械学習の学習中に勾配が小さい平坦な領域へ入り、損失や性能の改善が鈍くなる状態です。特に深層学習では損失関数の地形が複雑なため、鞍点や平坦領域による停滞が起こりやすくなります。

対策では、まず学習曲線を確認し、学習率、最適化手法、モデル構造、データ品質を順番に見直します。MomentumやAdam、学習率スケジューラ、正則化、データ拡張は有効な選択肢ですが、原因を切り分けながら試すことが大切です。

プラトーを「学習が終わった合図」と決めつけず、改善余地を探すためのサインとして扱うと、モデルの性能向上につなげやすくなります。

更新履歴

| 日付 | 内容 |

|---|---|

| 2025年2月1日 | 初回公開 |

| 2026年5月24日 | 停滞の原因別に対策を整理し、関連概念との違いを追記 |