学習

学習 ファインチューニングで精度向上

近ごろ、機械を賢くする技術の活用範囲が広がっています。特に、人間の脳の仕組みをまねた「深層学習」という方法は、写真を見て何が写っているかを当てたり、人の言葉を理解したりする作業で素晴らしい成果を上げており、私たちの暮らしにも大きな変化をもたらしています。この深層学習の仕組みを作るには、たくさんの情報を使って、仕組みの中の細かい部分を調整する学習の過程が欠かせません。しかし、最初から学習を始めると、多くの時間と計算するための資源が必要になることがよくあります。そこで、既に学習を終えた仕組みを再利用する方法が注目を集めています。この方法の中でも、「ファインチューニング」という技術は、効率よく高い精度を持つ仕組みを作るための重要な技術となっています。

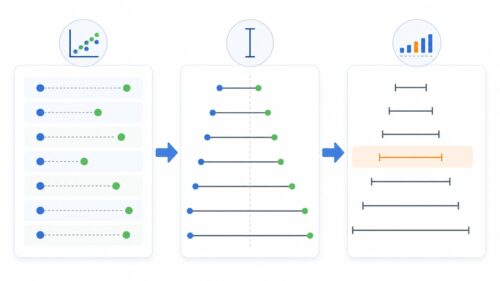

ファインチューニングとは、既に学習済みのモデルを土台として、特定の課題に特化させるための追加学習を行う手法です。例えば、大量の画像データで学習済みの画像認識モデルを、特定の種類の鳥を識別するモデルに改良したい場合、鳥の画像データを使って追加学習を行います。この際、既に学習済みのモデルのパラメータを初期値として使用することで、一から学習する場合に比べて、少ないデータ量と学習時間で高精度なモデルを構築できます。

ファインチューニングは、様々な分野で応用されています。医療分野では、レントゲン写真から病気を診断するモデルの構築に、製造業では、製品の不良品を検出するモデルの構築に活用されています。また、近年注目されている自然言語処理の分野でも、文章の分類や翻訳といったタスクでファインチューニングが用いられています。ファインチューニングは、誰でも手軽に高度な機械学習モデルを利用できるようにするための重要な技術であり、今後ますます発展していくことが期待されます。

このように、既に学習済みのモデルをうまく活用することで、時間と資源の節約だけでなく、特定の課題により適した高精度なモデルを容易に作ることができます。この技術は、今後さらに様々な分野での活用が期待され、私たちの生活をより豊かにしていくでしょう。