AI活用

AI活用 予測の精度低下:ラベルドリフトとは

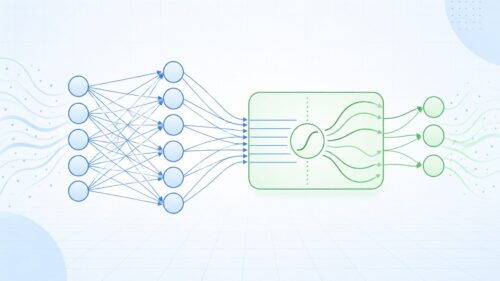

機械学習は、まるで人間の学習のように、与えられた情報から規則性を見つけて、将来を予測する技術です。大量の情報から自動的に規則性を学ぶことができるため、様々な分野で活用されています。例えば、商品の売れ行き予測や、病気の診断支援など、私たちの生活を豊かにする可能性を秘めています。

しかし、機械学習にも弱点があります。現実の世界は常に変化しており、一度学習した規則が、時間の経過とともに役に立たなくなることがあります。これは、まるで一度覚えた知識が、時代の変化とともに通用しなくなるのと同じです。

特に「ラベルドリフト」と呼ばれる現象は、機械学習における大きな課題です。ラベルドリフトとは、予測したいものと、それに影響を与えるものとの関係性が変化することを指します。例えば、ある商品の売れ行きを予測するモデルを考えてみましょう。過去には、気温が高い日に売上が伸びていたとします。しかし、消費者の嗜好が変化し、気温が高い日には別の商品が売れるようになり、元の商品の売上は下がったとします。このように、予測したいもの(商品の売上)と、それに影響を与えるもの(気温)との関係が変わってしまうと、過去の情報に基づいて学習したモデルは正確な予測ができなくなってしまいます。

ラベルドリフトへの対策は、機械学習モデルを正しく運用するために不可欠です。対策を怠ると、予測の精度が下がり、ビジネスに悪影響を与える可能性があります。例えば、商品の売れ行き予測が外れると、過剰な在庫を抱えてしまったり、逆に品不足に陥ったりする可能性があります。そのため、常に変化する状況に合わせて、モデルを更新していく必要があります。まるで、常に新しい知識を学び続ける必要があるのと同じです。