アルゴリズム

アルゴリズム 状態価値関数:強化学習における道標

強化学習とは、機械が与えられた環境の中で、試行錯誤を通して学習していく人工知能の手法の一つです。まるで生まれたばかりの子供が、周りの世界を触ったり、見たり、経験したりしながら成長していくように、機械も様々な行動を試み、その結果から何が良くて何が悪いのかを学んでいきます。

この学習の目的は、環境との相互作用を通して得られる報酬の合計値を最大にすることです。例えば、ロボットが迷路を解くことを考えてみましょう。ロボットは様々な道を進みますが、行き止まりにぶつかったり、遠回りしたりすることもあります。しかし、ロボットはこれらの経験から学習し、最終的にはゴールにたどり着くための最短経路を見つけ出します。この時、ゴールにたどり着くことが報酬となり、より早くゴールにたどり着くほど、より大きな報酬が得られると設定することで、ロボットは効率的な経路を学習していきます。

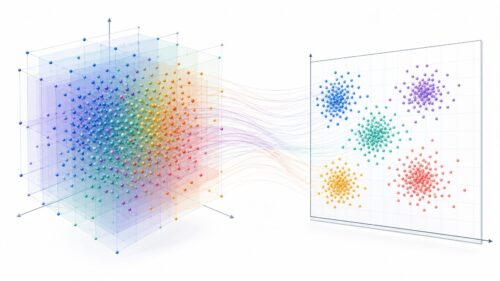

この学習過程において、状態価値関数という概念が重要な役割を担います。状態価値関数は、迷路で例えるならば、現在ロボットがどの位置にいるのか、という「状態」に基づいて、そこからゴールまでたどり着くまでに最終的にどれだけの報酬を得られるかを予測するものです。つまり、各地点におけるゴールへの近さの指標のようなものと言えるでしょう。

例えば、ゴールに近い場所にいる場合は、状態価値関数の値は高くなります。逆に、ゴールから遠い場所や行き止まりに近い場所では、状態価値関数の値は低くなります。ロボットはこの状態価値関数を道標として、より高い価値を持つ状態へと移動することで、効率的にゴールを目指します。状態価値関数は、将来得られる報酬の予測値を提供することで、ロボットが最適な行動を選択するのを助ける、いわばナビゲーションシステムのような役割を果たしているのです。