アルゴリズム

アルゴリズム 単純パーセプトロン入門

単純パーセプトロンは、人工知能の基礎となる最も単純な学習模型の一つです。これは、人間の脳神経細胞の働きを模倣した数理模型で、複数の情報を受け取り、それぞれの情報に重要度をつけて処理し、最終的な結果を導き出します。まるで、会議で複数の人から意見を聞き、それぞれの人の発言の重みを考えて最終的な決定を下すようなものです。この仕組みは、様々な情報から一定の規則に基づいて判断を行うという点で、人間の思考過程の一部を再現していると言えるでしょう。

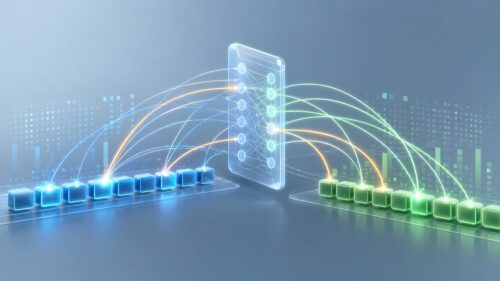

具体的には、単純パーセプトロンは、入力層と出力層という二つの層だけから成り立っています。入力層は、外部から情報を受け取る場所で、それぞれの入力には重みという数値が割り当てられます。この重みは、それぞれの情報がどれくらい重要なのかを表す指標です。例えば、重要な情報には大きな重みを、そうでない情報には小さな重みを割り当てます。次に、入力層で受け取った情報とそれぞれの重みを掛け合わせ、その合計値を計算します。この合計値がある値(しきい値)を超えた場合、出力層は「1」を出力し、超えない場合は「0」を出力します。これは、まるで天秤のように、入力された情報の重みがしきい値という基準点を超えるかどうかで判断を下していると言えるでしょう。

単純パーセプトロンは、家屋に例えると玄関と居間だけの小さな家のようなものです。複雑な構造を持つ大きな家と比べると、機能は限られていますが、基本的な生活を送るには十分です。同様に、単純パーセプトロンも複雑な問題を解くことはできませんが、直線で分離可能な単純な問題を学習するには十分な能力を持っています。そして、この単純な仕組みこそが、より複雑な人工知能の基盤となっているのです。。複雑な神経回路網も、突き詰めればこの単純パーセプトロンの組み合わせで成り立っていると言えるでしょう。