学習

学習 学習の進化:AdaDeltaの解説

機械学習の世界では、学習の進み具合を調整することがとても大切です。この進み具合を調整する値のことを学習率と呼びます。適切な学習率を見つけることは、まるで宝探しの地図を見つけるようなもので、モデルの性能を最大限に引き出すための重要な鍵となります。しかし、この学習率を手作業で調整するのは至難の業で、最適な値を見つけるまでに多大な時間と労力を要することがあります。

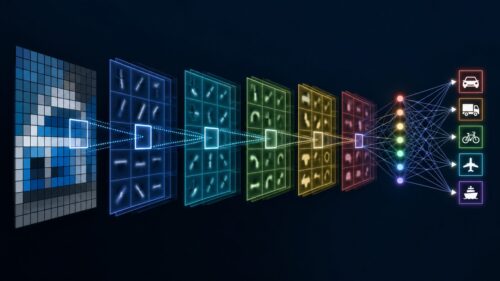

そこで、自動的に学習率を調整してくれる便利な手法として、AdaDeltaが登場します。AdaDeltaは、まるで自動操縦装置のように、最適化の過程を効率化し、より良い結果へと導いてくれます。従来の手法では、学習率を固定値として設定していましたが、AdaDeltaは過去の変化量を記憶し、それをもとに各々の学習ステップで最適な学習率を自動的に決定します。これは、山を登る際に、急な斜面では一歩一歩慎重に、緩やかな斜面では大きく足を踏み出すことに似ています。

AdaDeltaの利点は、手動での調整が不要になるだけではありません。過去の変化量を考慮することで、学習の振動を抑え、より安定した学習を実現します。さらに、学習率の初期値設定に過度に敏感になることもありません。つまり、AdaDeltaを使うことで、試行錯誤の時間を大幅に削減し、より良い結果を効率的に得ることが可能になるのです。この記事では、AdaDeltaの具体的な仕組みや利点、そして使い方について、さらに詳しく説明していきます。