活性化関数 Swish のすべて

AIの初心者

「Swish関数」って、ニューラルネットワークの中でどんな役割をするものですか?

AI専門家

Swish関数は、深層学習で使われる活性化関数の一つだよ。入力が正の値ならほぼそのまま通し、負の値なら0に近づけながら少しだけ情報を残す性質があるんだ。

AIの初心者

ReLUと似ているように聞こえますが、何が違うんですか?

AI専門家

大きな違いは曲線が滑らかなことだね。その滑らかさが、深いニューラルネットワークの学習を助ける場合があるんだ。

Swish関数とは。

Swish関数は、ニューラルネットワークで信号を次の層へ渡すときに使われる活性化関数の一種です。ReLUのように正の入力を通しつつ、負の入力を完全に捨てず、滑らかに0へ近づける点が特徴です。

Swish関数とは

Swish関数は、深層学習のモデルで使われる活性化関数です。入力された値に対して、シグモイド関数で計算した0から1の重みを掛け、出力を決めます。直感的には、入力が大きく正の値であればほぼそのまま通し、入力が負の値であれば小さく抑える関数です。

この性質により、Swish関数はReLUに近い使いやすさを持ちながら、負の領域でも完全に情報を切り捨てない動きをします。画像認識や自然言語処理など、深いニューラルネットワークを使う場面で性能向上が期待される活性化関数として知られています。

ただし、Swish関数は万能ではありません。どのモデルでも必ず精度が上がるわけではなく、ReLUやGELUなど他の活性化関数と比較しながら選ぶことが重要です。

活性化関数の役割

ニューラルネットワークは、多数のノード、つまりニューロンが層状につながった構造をしています。各ノードでは、前の層から受け取った値を計算し、その結果を次の層へ渡します。このとき、単に足し算や掛け算だけを繰り返すと、モデル全体は複雑な関係を表現しにくくなります。

そこで必要になるのが活性化関数です。活性化関数は、入力された信号を非線形に変換し、ニューラルネットワークが画像、文章、音声のような複雑なパターンを学習できるようにします。

| 要素 | 役割 |

|---|---|

| ニューラルネットワーク | 入力データから特徴を学習し、分類や予測を行う仕組み |

| ノード | 入力値を受け取り、重み付き計算を行う単位 |

| 活性化関数 | 計算結果を非線形に変換し、次の層へ渡す関数 |

| Swish関数 | 正の入力を通し、負の入力を滑らかに抑える活性化関数 |

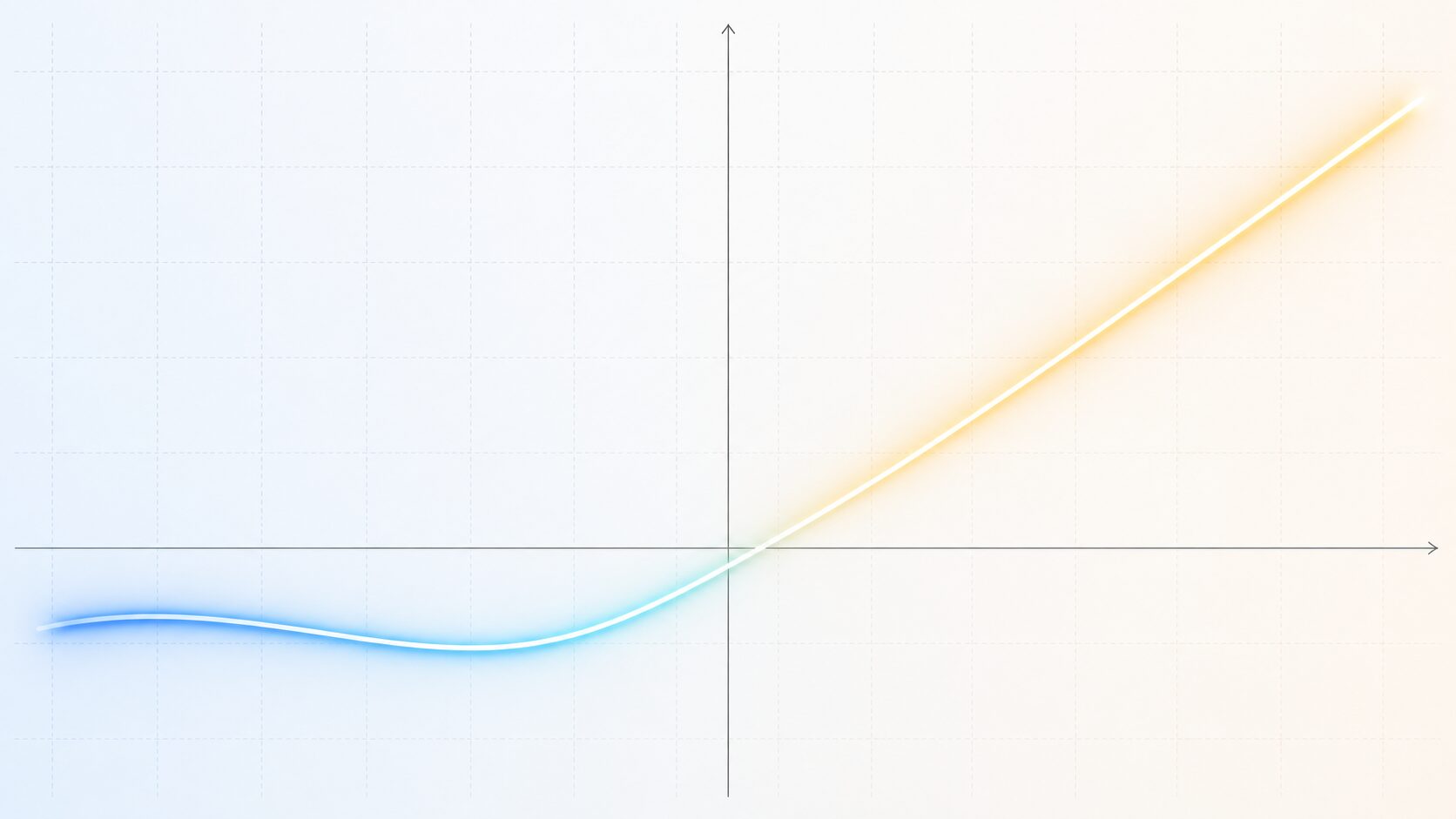

Swish関数の数式とグラフの見方

Swish関数は、入力値をそのまま使うのではなく、入力値にシグモイド関数の出力を掛けて計算します。代表的な形は次の通りです。

\(f(x)=x \cdot \sigma(x), \quad \sigma(x)=\frac{1}{1+e^{-x}}\)ここで、x は入力値、σ(x) はシグモイド関数です。シグモイド関数は出力を0から1の範囲に収めるため、Swish関数では入力値に対して「どれくらい通すか」を滑らかに調整するような働きをします。

グラフで見ると、正の入力では出力が入力値に近づきます。一方、負の入力では出力が0に近づきますが、ReLUのように急に0へ切り替わるわけではありません。この滑らかさが、深い層を持つモデルで勾配を扱いやすくする要因の一つです。

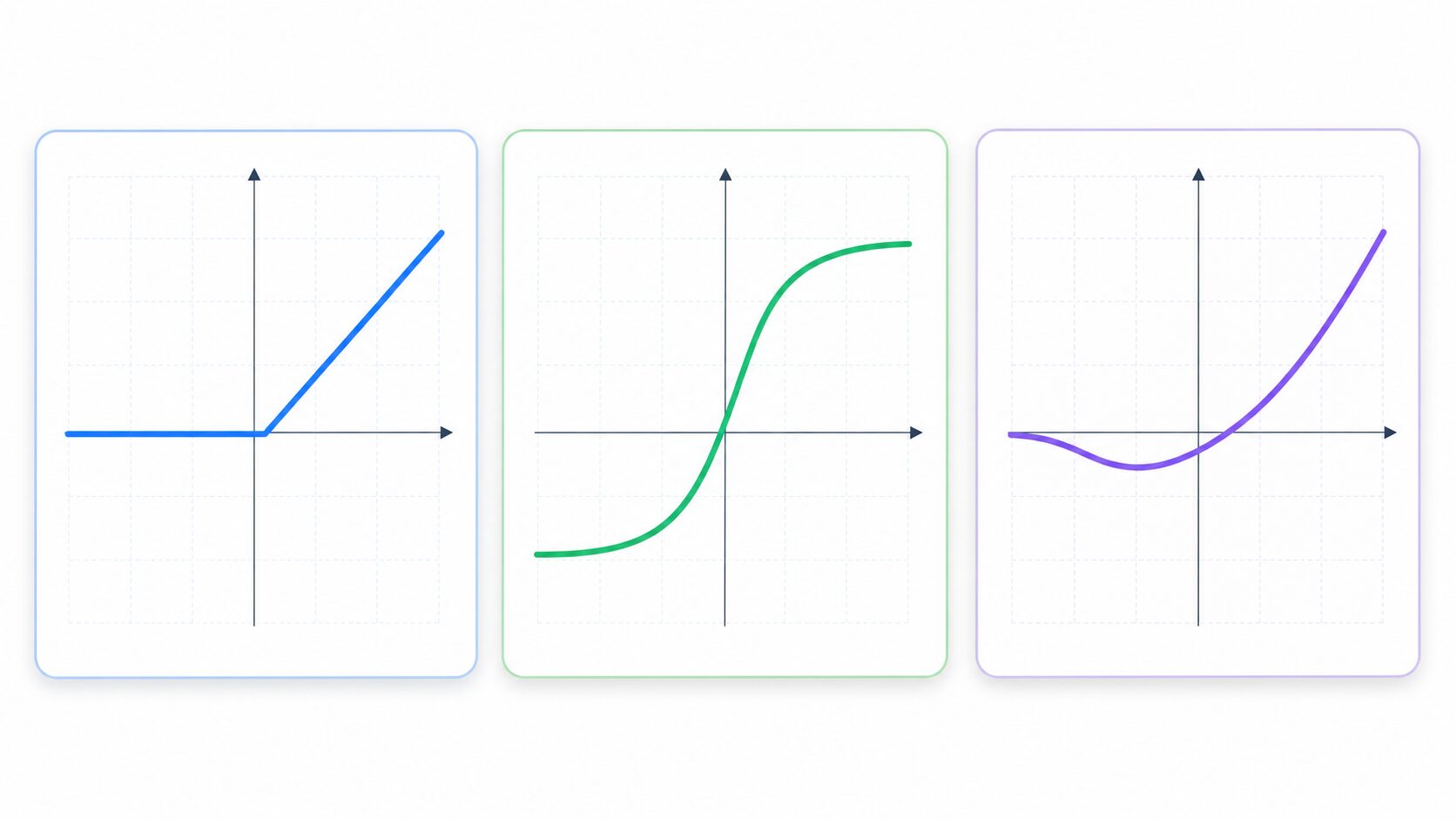

ReLU・シグモイド関数との違い

Swish関数を理解するには、よく使われるReLUやシグモイド関数と比べると分かりやすくなります。ReLUは、入力が正ならそのまま出力し、負なら0にする非常に単純な関数です。計算が軽く、多くのモデルで標準的に使われています。

一方、シグモイド関数は入力を0から1の範囲へ滑らかに変換します。確率のような値を表す場面では便利ですが、深いネットワークでは勾配が小さくなりやすいという弱点があります。Swish関数は、このシグモイド関数を内部で使いながら、入力値そのものも掛け合わせることで、ReLUに近い動きと滑らかさを両立させます。

| 関数 | 特徴 | 注意点 |

|---|---|---|

| ReLU | 正の値をそのまま通し、負の値を0にする | 計算は軽いが、負の情報を完全に失う |

| シグモイド関数 | 出力を0から1に収める | 深い層では勾配が小さくなりやすい |

| Swish関数 | 正の入力を通し、負の入力を滑らかに抑える | ReLUより計算コストが高い |

Swish関数の利点

Swish関数の主な利点は、滑らかな非線形性にあります。曲線が連続的に変化するため、ニューラルネットワークの学習中に勾配が急に途切れにくく、複雑な特徴を学習しやすくなる場合があります。

また、負の入力を完全に0にしない点も重要です。ReLUでは負の入力がすべて0になるため、その領域の情報が失われます。Swish関数では負の入力もわずかに残るため、モデルがより細かな情報を利用できる可能性があります。

このため、画像認識や自然言語処理のように複雑なパターンを扱う課題では、Swish関数がReLUより良い性能を示すことがあります。深いニューラルネットワークで学習が不安定な場合や、既存モデルの精度改善を試したい場合に、候補として検討しやすい活性化関数です。

Swish関数の欠点と注意点

Swish関数の欠点は、ReLUより計算が複雑なことです。ReLUは「0より大きければそのまま、そうでなければ0」という単純な処理で済みます。一方、Swish関数はシグモイド関数を含むため、計算量が増えます。

この違いは、大規模な学習環境では許容できる場合もありますが、スマートフォン、組み込み機器、リアルタイム推論のように計算資源が限られる環境では無視できません。精度が少し上がっても、推論速度や消費電力の面で不利になる可能性があります。

さらに、Swish関数はすべての課題でReLUより優れるわけではありません。モデルの構造、データの性質、バッチ正規化など周辺技術との組み合わせによって結果は変わります。実務では、Swishを採用する前に、ReLUやGELUなど複数の活性化関数で検証することが大切です。

Swish関数の適用事例

Swish関数は、深層学習を使うさまざまな分野で検討されます。画像認識では、物体分類、物体検出、特徴抽出などのタスクで、画像内の複雑なパターンを捉える助けになる場合があります。

自然言語処理では、文脈を扱うモデルの内部で、滑らかな活性化関数が表現力の向上に寄与することがあります。音声認識でも、雑音を含む信号から特徴を抽出する際に、非線形な変換が重要になります。

| 分野 | 活用の例 | 期待される効果 |

|---|---|---|

| 画像認識 | 画像分類、物体検出、特徴抽出 | 複雑な画像特徴を学習しやすくする |

| 自然言語処理 | 翻訳、文章生成、文脈理解 | 滑らかな変換で表現力を高める |

| 音声認識 | 音声入力、文字起こし、音響特徴抽出 | 連続的な信号の特徴を扱いやすくする |

今後の展望

Swish関数は、ReLUを置き換える候補として研究・利用されてきた活性化関数です。今後も、より効率的な計算方法、モデルごとの適用条件、他の活性化関数との比較が進むと考えられます。

特に、計算資源が限られる環境でSwishの利点を活かすには、精度だけでなく推論速度や消費電力も含めて評価する必要があります。また、Swishに近い性質を持つ別の活性化関数との比較も、実務上は重要です。

AIモデルの性能は、活性化関数だけで決まるものではありません。しかし、活性化関数は学習のしやすさや表現力に関わる重要な部品です。Swish関数を理解しておくことで、ニューラルネットワークの設計や改善を考える際の選択肢が広がります。

まとめ

Swish関数は、入力値にシグモイド関数の出力を掛ける活性化関数です。正の入力は通し、負の入力は滑らかに抑えるため、ReLUよりも情報を残しやすい特徴があります。

利点は、滑らかな曲線、非線形性、負の入力を完全に捨てない性質です。一方で、ReLUより計算コストが高く、すべてのモデルで最良とは限りません。Swish関数は、精度改善の候補として有効ですが、実際にはデータ、モデル、実行環境に合わせて比較検証することが大切です。

更新履歴

| 日付 | 内容 |

|---|---|

| 2025年2月2日 | 初回公開 |

| 2026年5月1日 | Swish関数の定義、数式、ReLU・シグモイド関数との違い、利点と注意点、応用例を初心者向けに再構成 |