アルゴリズム

アルゴリズム AdaBound:学習の効率と安定性を両立

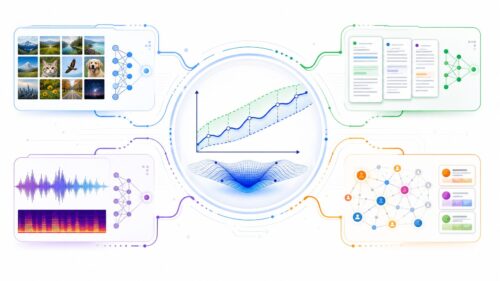

機械学習とは、人工知能の一分野で、まるで人が学習するようにコンピュータにデータからパターンや法則を見つけ出させる技術のことです。この学習過程で重要な役割を果たすのが最適化アルゴリズムです。人が学ぶ際に、より効率的な学習方法を模索するように、機械学習でも最適化アルゴリズムによって学習の効率と精度が大きく変わってきます。

様々な最適化アルゴリズムが提案されており、それぞれに特徴があります。例として、よく用いられる手法の一つに「勢い」を利用した学習方法があります。この方法は、過去の学習の勢いを考慮することで、学習の振れ幅を抑え、安定した学習を実現します。また、高い汎化性能、つまり未知のデータに対しても正確な予測ができる能力が期待できます。しかし、この学習方法はゆっくりと学習を進めるため、学習に時間がかかる場合があります。

一方で、「アダム」と呼ばれる学習方法は、学習の初期段階において非常に速い学習速度を実現します。まるで、人が新しいことを学ぶ際に、最初は集中的に学習する様子に似ています。しかしながら、学習が進むにつれて、汎化性能、つまり未知のデータへの対応力が劣る場合も見られます。これは、人が詰め込み学習で一時的に良い結果を出しても、真の理解が伴わず応用が利かない状況に似ています。

このように、それぞれのアルゴリズムには得意な点と不得意な点が存在します。そこで、これらのアルゴリズムの利点を組み合わせ、欠点を補う、新たな学習方法の開発が求められています。人が様々な学習方法を組み合わせて学習効果を高めるように、機械学習でもより効果的な学習方法の探求が続けられています。