AdaBound:学習の速さと汎化能力を両立

AIの初心者

先生、『AdaBound』って、どんなものなんですか? ADAMとモーメンタムを掛け合わせたような性能って、どういうことでしょうか?

AI専門家

いい質問だね。『AdaBound』は、学習の進め方を調整する技術の一つだよ。ADAMのように最初は速く学習を進め、徐々にモーメンタムのように安定した学習に切り替わることで、両方のいいところを取るんだ。

AIの初心者

なるほど。ADAMとモーメンタムの切り替えは自動的に行われるんですか?

AI専門家

そうだよ。学習率の上限と下限を決めておくことで、最初は速く、最後はゆっくりと学習が進むように調整される。この仕組みのおかげで、速さと安定性を両立できるんだ。

AdaBoundとは。

エイアイ(人工知能)に関わる「アダバウンド」という用語について説明します。アダバウンドは、アダムとモーメンタムという二つの学習方法の利点を組み合わせた最適化アルゴリズムです。学習の進み具合を調整する学習率に、上限と下限を設定する「クリッピング」という手法を用いるのが特徴です。これにより、学習の初期段階ではアダムのように素早く学習を進め、最終的にはモーメンタムのように様々な状況に対応できる能力を発揮することができます。

はじめに

機械学習の分野では、学習機がデータから規則性を学ぶ際に、最適化手法と呼ばれる手順を用いて、その学習効率を高めることが重要です。この最適化手法は、いわば学習機の先生のような役割を果たし、学習機の成長を導きます。数多くの最適化手法の中でも、近年注目を集めているのが「エイダバウンド」です。エイダバウンドは、学習の初期段階では勢いよく学習を進め、徐々に落ち着きを見せるという、人間の学習過程にも似た特性を持っています。

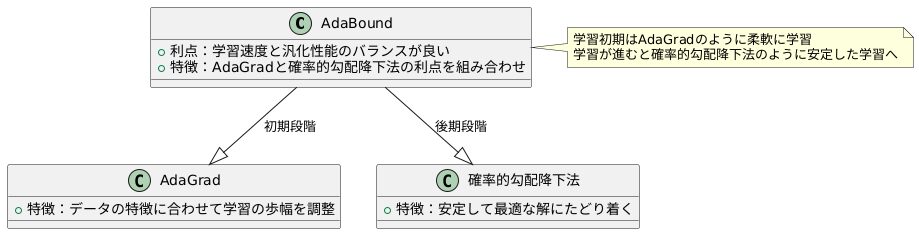

エイダバウンドの大きな特徴は、二つの既存の手法、「エイダグレード」と「確率的勾配降下法」の利点を組み合わせている点です。エイダグレードは、データの特徴に合わせて学習の歩幅を調整する能力に長けています。一方、確率的勾配降下法は、安定して最適な解にたどり着くことが得意です。エイダバウンドは、学習の初期段階ではエイダグレードのように柔軟に学習を進め、データの全体像を素早く把握します。そして、学習が進むにつれて確率的勾配降下法の特性を取り入れ、安定した学習へと移行することで、最終的に精度の高い結果を得ることができるのです。

エイダバウンドの利点は、学習速度と汎化性能のバランスが良い点です。学習速度が速ければ、短い時間で結果を得ることができますが、学習データのみに特化してしまい、新しいデータに対してはうまく対応できない場合があります。これを過学習と呼びます。反対に、汎化性能が高いと、新しいデータにも対応できますが、学習に時間がかかることがあります。エイダバウンドは、この二つの要素をバランス良く両立させることで、効率的な学習と高い精度の両立を実現しています。

このように、エイダバウンドは様々な機械学習の課題において、その柔軟性と安定性から有力な選択肢となります。今後、更なる研究と応用が進むことで、機械学習の可能性を更に広げる役割を担うことが期待されています。

仕組み

「仕組み」と題されたこの文章は、最適化アルゴリズム「エイダバウンド」の仕組みを解説しています。エイダバウンドは、学習を効率的に進めるための手法である「アダム」と「モーメンタム」という、二つの優れた手法の長所を組み合わせたものです。

アダムは、学習の初期段階においては非常に速い収束速度を見せます。言い換えれば、短時間で目的とする状態に近づくことができます。しかし、学習した結果が新しいデータに対しても有効であるか、という汎化性能の面では課題が残る場合があります。

一方、モーメンタムは、安定した学習過程と良好な汎化性能を示します。学習結果が新しいデータにも適用しやすいと言えるでしょう。ただし、学習の速度はアダムに比べると遅くなってしまう場合があります。

エイダバウンドは、これらの二つの手法の利点を「学習率の制限」という手法を用いて融合しています。学習率とは、学習の進み具合を調整する重要な要素です。エイダバウンドは、この学習率の上限と下限を状況に応じて動的に調整することで、学習の初期段階ではアダムのように速く学習を進め、学習が進むにつれてモーメンタムのように安定した学習へと変化していきます。

この動的な調整こそがエイダバウンドの核心であり、アダムの速さとモーメンタムの安定性を両立させる鍵となっています。学習の初期段階では、アダムのように速く学習を進めることで、効率的に学習を進めます。そして、学習が進むにつれてモーメンタムのように学習率を調整することで、安定した学習と良好な汎化性能を確保します。これにより、エイダバウンドは様々な場面で効果を発揮する、優れた最適化アルゴリズムと言えるでしょう。

| 手法 | 長所 | 短所 |

|---|---|---|

| アダム | 学習初期における収束速度が速い | 汎化性能に課題が残る場合がある |

| モーメンタム | 安定した学習過程と良好な汎化性能 | 学習速度がアダムに比べて遅い場合がある |

| エイダバウンド | アダムの速さとモーメンタムの安定性を両立 (学習率の動的調整による) |

– |

利点

この手法は、学習の速さと正確さの両方を兼ね備えている点が大きな特徴です。具体的には、学習の初期段階では、他の手法と同様に、大きな変更を加えることで、最適な値を素早く見つけ出そうとします。まるで、広大な土地の中で宝を探すときに、まずは大きく一歩ずつ踏み出して全体を探索するようなものです。

学習が進むにつれて、この変更は徐々に小さくなっていきます。これは、宝のありかがある程度絞り込まれてきた段階で、小さな一歩で慎重に探していくようなものです。この手法を用いることで、最適な値を素早く見つけ出すと同時に、行き過ぎた調整を防ぎ、より正確な結果を得ることができます。

さらに、この手法は、様々な状況に柔軟に対応できるという強みも持っています。他の手法では、データの種類や扱う問題によって、細かく設定を調整する必要がある場合が多く、まるで職人が道具を微調整するように、それぞれの状況に合わせた最適な設定を見つけるのに苦労します。しかし、この手法は、設定の調整にあまり敏感ではないため、様々な状況で安定した性能を発揮します。これは、まるでどんな状況でも使いやすい万能な道具のように、手軽に利用できるという点で大きな利点となります。

つまり、この手法は、速さと正確さ、そして使いやすさを兼ね備えた、非常に優れた学習方法と言えるでしょう。

| 学習段階 | 変更の大きさ | 探索方法の例え | 利点 |

|---|---|---|---|

| 初期段階 | 大きい | 広大な土地で大きく一歩ずつ探索 | 最適な値を素早く見つけ出す |

| 学習が進むにつれて | 徐々に小さくなる | 宝のありかが絞り込まれてきた段階で、小さな一歩で慎重に探索 | 行き過ぎた調整を防ぎ、より正確な結果を得る |

| 特徴 | 詳細 | 例え |

|---|---|---|

| 柔軟性 | 様々な状況に柔軟に対応できる、設定の調整にあまり敏感ではない | どんな状況でも使いやすい万能な道具 |

| 使いやすさ | 手軽に利用できる | – |

他の手法との比較

学習のさせ方をうまく調整する手法は、機械学習の肝となる部分です。様々な手法が提案されていますが、ここでは「アダバウンド」という手法を中心に、他の手法と比べながらその利点を見ていきましょう。

まず、よく知られた手法である「アダム」と「モーメンタム」と比較してみましょう。アダバウンドは、アダムやモーメンタムよりも多くの場合、良い結果を示します。特に、扱うものが複雑だったり、データ量が膨大な場合、アダバウンドはアダムで見られる行き過ぎた学習を抑え、モーメンタムよりも速く学習を進めることができます。

行き過ぎた学習とは、訓練データに過剰に適応しすぎて、新しいデータへの対応力が落ちてしまう現象です。アダムはこの行き過ぎた学習を起こしやすい反面、学習の初期段階は速いという特性があります。モーメンタムは学習を速める効果がありますが、最適な状態への収束が難しい場合があります。アダバウンドはこれらの手法の長所を取り入れ、短所を補うことで、より良い学習を実現しています。

さらに、古くから使われている「確率的勾配降下法」とも比較してみましょう。この手法は単純ですが、調整が難しく、安定した学習が難しいという欠点があります。アダバウンドは、確率的勾配降下法と比べても多くの課題で高い正答率と安定した学習を実現することが報告されています。これは、アダバウンドが学習の進み具合に合わせて調整値を自動で変えることで、様々な状況に柔軟に対応できるためと考えられます。

このように、アダバウンドは他の手法と比べて多くの利点を持っており、様々な場面で効果的に学習を進めることが期待できます。

| 手法 | 長所 | 短所 | アダバウンドとの比較 |

|---|---|---|---|

| アダム | 学習の初期段階が速い | 行き過ぎた学習を起こしやすい | アダバウンドは行き過ぎた学習を抑え、多くの場合、より良い結果を示す。 |

| モーメンタム | 学習を速める効果がある | 最適な状態への収束が難しい場合がある | アダバウンドはモーメンタムよりも速く学習を進めることができる。 |

| 確率的勾配降下法 | 単純 | 調整が難しく、安定した学習が難しい | アダバウンドは、確率的勾配降下法と比べ、高い正答率と安定した学習を実現する。 |

| アダバウンド | 様々な状況に柔軟に対応できる。行き過ぎた学習を抑え、速く学習を進める。 |

適用事例

様々な機械学習の課題に対して、アダバウンドは応用されています。画像の認識や、言葉の処理、音の認識など、幅広い分野で活用されているのです。具体的な例を挙げると、画像の分類を行う場合を考えてみましょう。写真に写っているものが何なのかをコンピューターに判断させる、この種の課題にアダバウンドは役立ちます。レズネットやエフィシェントネットといった、複雑な画像認識の仕組みとアダバウンドを組み合わせることで、高い正答率を達成できたという報告があります。これらの仕組みは、画像の特徴を捉える層を深く積み重ねた構造を持ち、アダバウンドはこのような深い構造を持つ学習モデルの最適化に特に効果を発揮するのです。

さらに、人の言葉を扱う自然言語処理の分野でも、アダバウンドは活躍しています。近年の自然言語処理では、トランスフォーマーと呼ばれる仕組みが中心的な役割を担っています。バートはその代表例であり、文章の意味を理解する上で非常に優れた能力を示します。アダバウンドは、このバートのような複雑なモデルにおいても、学習を効率的に進めるための最適化アルゴリズムとして有効であることが分かっています。具体的には、文章の分類や翻訳、質問応答といった様々なタスクで、アダバウンドを用いることで性能の向上が見られています。

このように、画像認識や自然言語処理といった異なる分野の様々な課題において、アダバウンドは高い性能を発揮しています。これは、アダバウンドが持つ優れた特性によるものです。アダバウンドは、学習の初期段階では勢いよくパラメーターを調整し、徐々に調整の幅を狭めていくことで、安定した学習を実現します。この柔軟な調整方法が、様々なモデルやデータセットに対する適応力の高さにつながっていると考えられます。これらの適用事例は、アダバウンドが多くの機械学習の課題に対して効果的な解決策となりうることを示唆しており、今後の更なる応用と発展が期待されます。

| 分野 | 課題 | モデル | アダバウンドの効果 |

|---|---|---|---|

| 画像認識 | 画像分類 | レズネット、エフィシェントネット | 高い正答率 |

| 自然言語処理 | 文章分類、翻訳、質問応答 | バート | 学習の効率化、性能向上 |

まとめ

学習の最適化は、機械学習の性能を大きく左右する重要な要素です。数多くの最適化手法が提案されていますが、その中で、学習の速さと安定性を両立した手法として注目されているのが、エイダバウンドです。エイダバウンドは、よく知られた二つの手法、アダムとモーメンタム、それぞれの長所を組み合わせた手法です。

アダムは、学習の初期段階において速い学習を実現する一方、最終的な学習結果の精度が少し劣る場合があります。モーメンタムは、学習を滑らかに進めることで、局所的な最適解に陥ることを防ぎ、より良い解を見つけ出す可能性を高めますが、学習の速度が比較的ゆっくりです。エイダバウンドは、これらの二つの手法の利点を巧みに融合しています。

エイダバウンドは、学習の初期段階ではアダムのように振る舞い、素早く学習を進めます。そして、学習が進むにつれて徐々にモーメンタムのように変化し、安定した学習を維持しながら、より良い解へと近づいていきます。この動的な調整こそがエイダバウンドの大きな特徴であり、学習の速さと最終的な精度の両立を可能にしています。

また、エイダバウンドは、ハイパーパラメータの調整にそれほど手間がかかりません。機械学習では、ハイパーパラメータの調整が学習結果に大きな影響を与えますが、最適な値を見つけるのは容易ではありません。エイダバウンドは、ハイパーパラメータの設定に比較的鈍感であるため、調整の手間を軽減し、安定した学習を実現できます。

これらの特徴から、エイダバウンドは、様々な機械学習の課題において高い性能を発揮することが示されています。画像認識、自然言語処理など、幅広い分野で応用が進んでおり、今後ますます重要な役割を果たしていくと期待されます。機械学習を始めたばかりの方にも、既に様々な手法を試してきた方にも、エイダバウンドは試してみる価値のある、強力な最適化手法と言えるでしょう。

| 手法 | 長所 | 短所 |

|---|---|---|

| アダム | 学習の初期段階において速い学習を実現 | 最終的な学習結果の精度が少し劣る場合がある |

| モーメンタム | 学習を滑らかに進めることで、局所的な最適解に陥ることを防ぎ、より良い解を見つけ出す可能性を高める | 学習の速度が比較的ゆっくり |

| エイダバウンド | 学習の速さと最終的な精度の両立 ハイパーパラメータの調整にそれほど手間がかからない |

– |