L2正則化とは?過学習を防ぐ仕組み・L1との違いを初心者向けに解説

AIの初心者

「L2正則化」って難しくてよくわからないです。簡単に説明してもらえますか?

AI専門家

もちろん。L2正則化は、機械学習モデルが訓練データに合わせ込みすぎるのを防ぐ方法の一つだよ。モデルが複雑になりすぎると、学習したデータには強くても、新しいデータでは予測が外れやすくなる。これを「過学習」と呼ぶんだ。

AIの初心者

過学習を防ぐんですね。具体的には何を調整するんですか?

AI専門家

L2正則化では、モデルのパラメータ、つまり重みが大きくなりすぎないように学習を調整するんだ。重みが大きすぎると細かなノイズに反応しやすいから、全体をほどよく小さくして、新しいデータにも安定して対応できるモデルを目指すんだよ。

L2正則化とは。

L2正則化とは、機械学習モデルの重みが大きくなりすぎることにペナルティを与え、過学習を抑えるための正則化手法です。訓練データだけに過度に適合するモデルではなく、未知のデータにも安定して予測できるモデルを作るために使われます。

似た手法にL1正則化があります。L1正則化は一部の重みをゼロに近づけて特徴選択をしやすいのに対し、L2正則化は重み全体をなめらかに小さくするのが特徴です。

L2正則化とは

L2正則化は、損失関数に「重みの二乗和」を加えることで、モデルが複雑になりすぎるのを防ぐ方法です。機械学習では、入力データから出力を予測できるように、モデル内の重みや係数を少しずつ調整します。この重みが極端に大きくなると、訓練データの細かな揺れやノイズまで拾いやすくなります。

たとえば、過去問だけを丸暗記した生徒は、同じ問題には強くても、少し表現が変わると解けなくなることがあります。機械学習の過学習もこれに似ています。訓練データにはよく合うのに、本番で出会う新しいデータには弱くなる状態です。

L2正則化は、この丸暗記のような状態を避けるために、モデルへ「重みを大きくしすぎない」という制約を加えます。その結果、予測の曲線や判断境界が極端に曲がりにくくなり、未知データに対する汎化性能を高めやすくなります。

正則化とは何をする工夫か

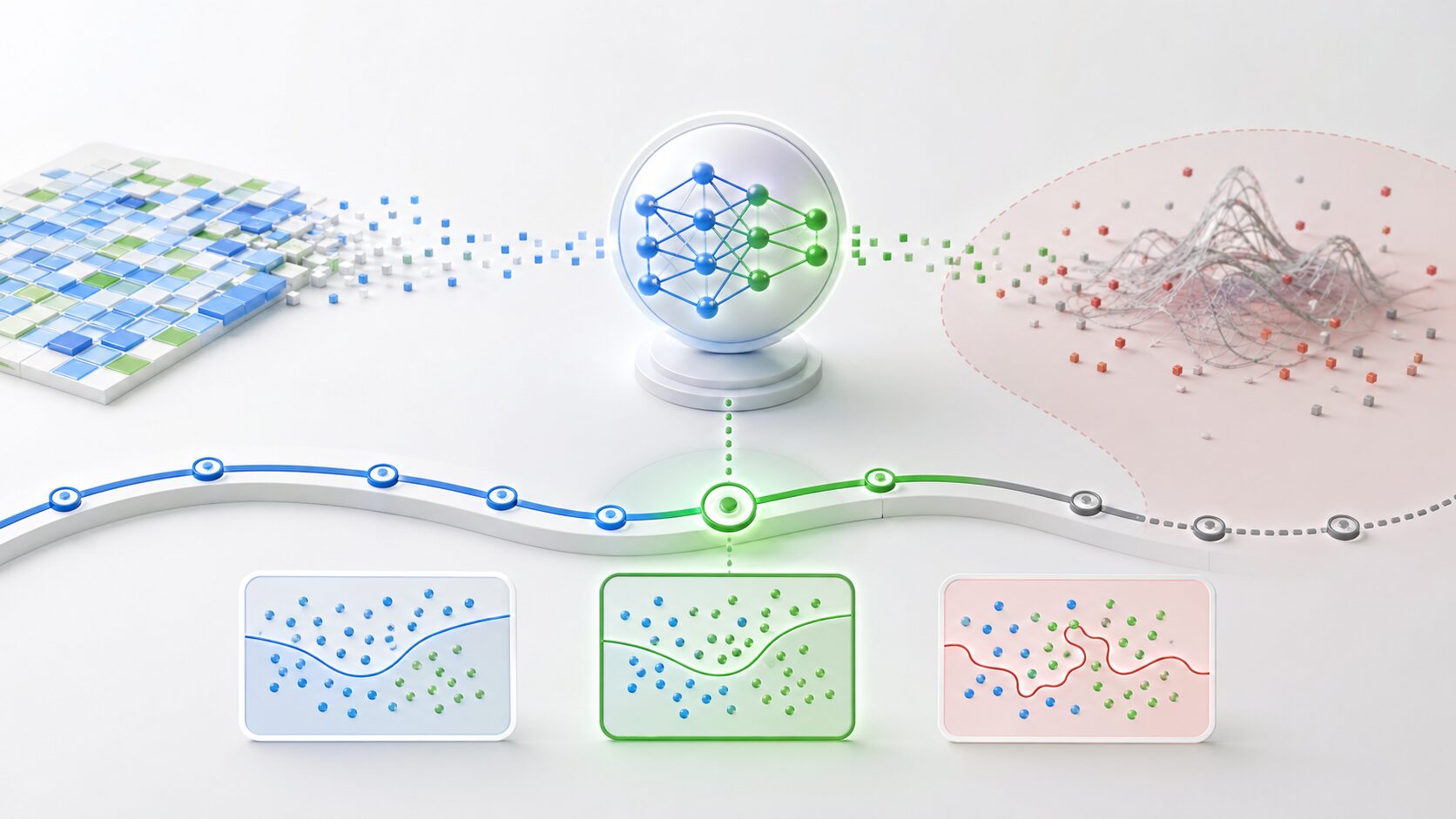

正則化とは、モデルの自由度を適度に抑え、訓練データに合わせ込みすぎないようにする工夫です。高性能なモデルほど多くのパラメータを持ち、複雑な関係を表現できます。しかし、複雑さが高すぎると、本来は偶然混ざっただけのノイズまで重要な規則として学習してしまいます。

そこで正則化では、予測のずれを小さくするだけでなく、モデルの複雑さにもコストをかけます。つまり、学習の目的を「訓練データに完全に合うこと」から「訓練データに合いつつ、無理のないシンプルな形を保つこと」へ変えるのです。

正則化にはL1正則化、L2正則化、Elastic Net、ニューラルネットワークで使われるドロップアウトなど、複数の方法があります。その中でもL2正則化は、線形回帰、ロジスティック回帰、サポートベクターマシン、ニューラルネットワークなどで広く使われる代表的な手法です。

L2正則化の仕組みと数式

L2正則化では、通常の損失関数に、重みを二乗して足し合わせた正則化項を加えます。損失関数は、モデルの予測と正解のずれを表す値です。L2正則化を使うと、予測誤差を小さくするだけでなく、重みが大きくなりすぎることも同時に避けるように学習します。

\(J(\mathbf{w}) = L(\mathbf{w}) + \lambda \sum_{j=1}^{n} w_j^2\)ここで、L(\mathbf{w}) は元の損失関数、w_j は各重み、\lambda は正則化の強さを決める係数です。\lambda が大きいほど、重みを小さく保つ力が強くなります。

重みを二乗するため、大きな重みほど強いペナルティを受けます。たとえば重みが2なら二乗は4ですが、重みが10なら二乗は100になります。この性質によって、L2正則化は一部の重みが極端に大きくなることを避け、モデル全体を安定した形へ近づけます。

直感的には、複雑に折れ曲がった曲線を、少し滑らかな曲線に戻すような働きです。滑らかなモデルは、訓練データの小さな揺れに振り回されにくく、未知のデータにも比較的安定した予測を返しやすくなります。

L1正則化との違い

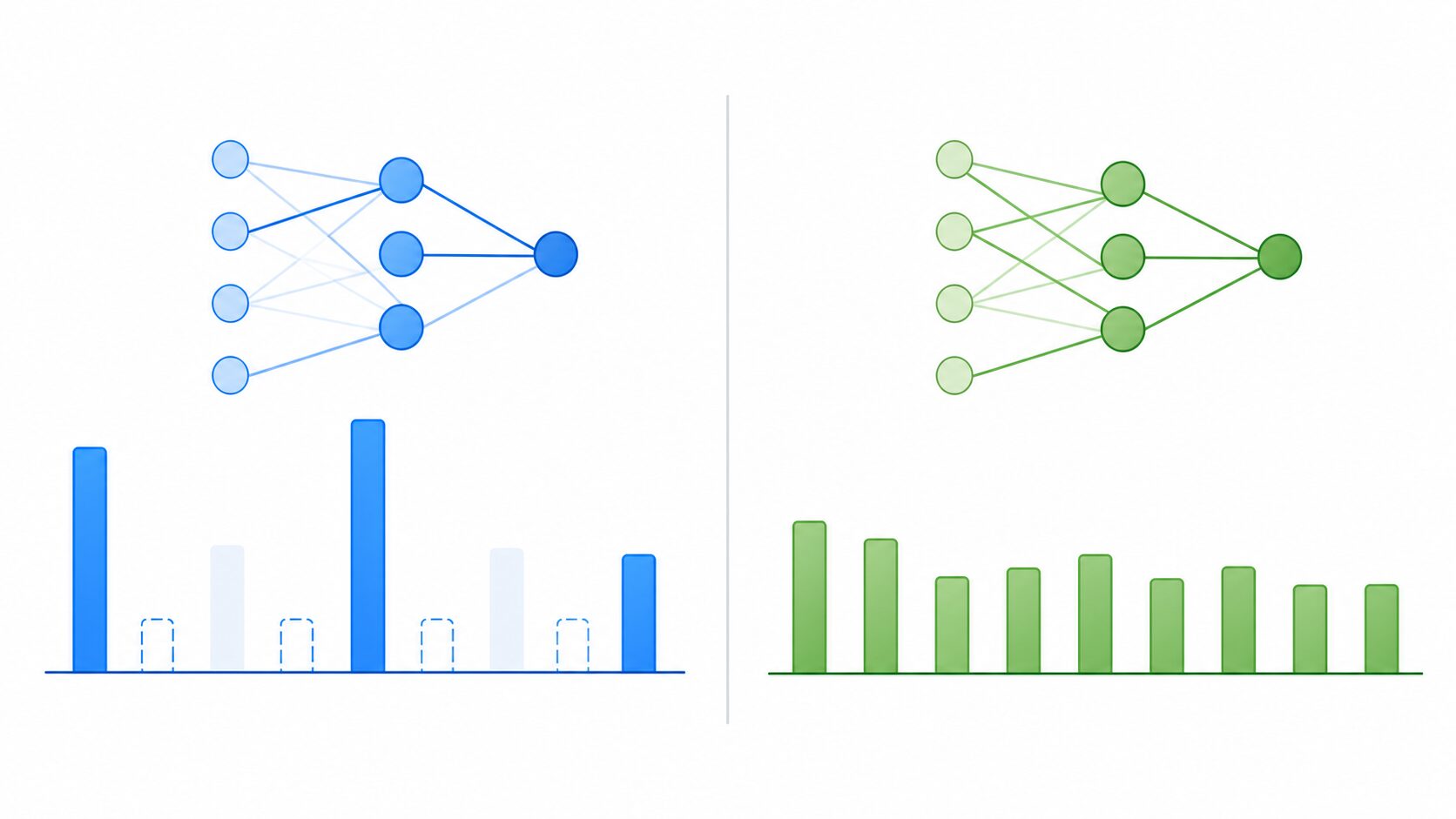

L1正則化とL2正則化は、どちらも損失関数にペナルティを加えて過学習を防ぐ手法です。ただし、ペナルティの形が違うため、重みへの影響も変わります。

L1正則化は、重みの絶対値の合計を使います。この方法では、重要度の低い重みがゼロになりやすく、不要な特徴量を削る「特徴選択」の効果が期待できます。一方、L2正則化は重みの二乗和を使うため、重みを完全にゼロへ落とすよりも、全体的に小さく縮める方向に働きます。

つまり、L1正則化は「使う特徴を絞る」イメージ、L2正則化は「すべての特徴を残しながら影響を穏やかにする」イメージです。多数の特徴量のうち一部だけが重要だと考えられる場合はL1が合いやすく、複数の特徴が少しずつ予測に関わる場合はL2が使いやすいことがあります。

| 項目 | L1正則化 | L2正則化 |

|---|---|---|

| 正則化項 | 重みの絶対値の合計 | 重みの二乗和 |

| 重みへの影響 | 一部の重みをゼロにしやすい | 重み全体を小さくしやすい |

| 主な効果 | 特徴選択、モデルの簡素化 | 過学習の抑制、予測の安定化 |

| 向いている場面 | 不要な特徴量が多いと考えられる場合 | 多くの特徴量が少しずつ効くと考えられる場合 |

| 組み合わせ | Elastic NetでL2と併用できる | Elastic NetでL1と併用できる |

L2正則化のメリットと使いどころ

L2正則化の大きなメリットは、過学習を抑えながら、モデルの予測を安定させやすいことです。重みが大きくなりすぎると、入力のわずかな変化が出力に大きく影響します。L2正則化で重みを小さく保つと、予測の変化がなめらかになり、ノイズに対して過敏に反応しにくくなります。

また、L2正則化は計算しやすい点も利点です。二乗和は微分しやすく、勾配降下法などの最適化手法に組み込みやすいため、多くの機械学習ライブラリで標準的に利用できます。scikit-learnのRidge回帰やロジスティック回帰、ニューラルネットワークのweight decayなどは、L2正則化と関係の深い例です。

実務では、特徴量が多いデータ、訓練データが限られているデータ、ノイズが含まれるデータで有効になることがあります。特に「訓練データでは高精度なのに検証データで精度が落ちる」という状況では、L2正則化を含む正則化手法を検討する価値があります。

| メリット | 内容 |

|---|---|

| 過学習を抑えやすい | 重みの極端な増大を防ぎ、訓練データのノイズに反応しすぎる状態を避ける。 |

| 予測が安定しやすい | 入力の小さな変化に対して、出力が急に変わりにくくなる。 |

| 計算に組み込みやすい | 二乗和は微分しやすく、多くの最適化手法やライブラリで扱いやすい。 |

| 幅広いモデルで使える | 線形モデル、分類モデル、ニューラルネットワークなどで活用される。 |

使うときの注意点

L2正則化は便利ですが、入れれば必ず精度が上がるわけではありません。正則化係数 \lambda が小さすぎると、重みを抑える力が弱く、過学習を防ぎにくくなります。逆に大きすぎると、モデルが十分に学習できず、訓練データにも検証データにも合わない学習不足の状態になります。

そのため、正則化の強さは交差検証や検証データを使って調整します。訓練データの精度だけを見るのではなく、検証データやテストデータで性能がどう変わるかを確認することが重要です。

また、L2正則化は特徴量のスケールにも影響を受けます。片方の特徴量が0から1の範囲、もう片方が0から10000の範囲のように大きく違うと、重みの意味も比較しにくくなります。線形モデルなどでL2正則化を使う場合は、標準化などの前処理もあわせて検討しましょう。

なお、L2正則化とL2正規化は別物です。L2正則化は学習時に重みへペナルティを加える手法で、L2正規化はベクトルの長さを1にそろえる前処理や変換を指すことが多い言葉です。名前が似ているため、学習時には文脈を確認する必要があります。

実践的な学習方法

L2正則化を理解するには、説明を読むだけでなく、実際に手を動かして挙動を確認するのが効果的です。Pythonで簡単な回帰データを作り、正則化なしのモデルとRidge回帰のようなL2正則化ありのモデルを比べると、曲線のなめらかさや検証データでの性能差を確認できます。

学習の流れとしては、まず過学習が起きやすいモデルを作り、訓練データと検証データの精度差を確認します。次にL2正則化の強さを変えながら、重みの大きさ、訓練精度、検証精度がどう変化するかを見ます。グラフにすると、正則化が弱すぎる場合と強すぎる場合の違いが直感的に理解しやすくなります。

さらに理解を深めたい場合は、損失関数、勾配降下法、バイアスとバリアンス、交差検証をあわせて学ぶとよいでしょう。L2正則化は単独のテクニックではなく、モデル評価やハイパーパラメータ調整と一緒に使って初めて効果を判断できます。

まとめ

L2正則化は、機械学習モデルの重みが大きくなりすぎることを抑え、過学習を防ぐための代表的な手法です。損失関数に重みの二乗和を加えることで、訓練データに過剰に合わせるのではなく、未知データにも対応しやすい滑らかなモデルを目指します。

L1正則化が特徴選択をしやすいのに対し、L2正則化は全体の重みを小さくして予測を安定させる点に特徴があります。正則化係数を適切に調整し、検証データで性能を確認しながら使うことで、L2正則化は実践的な過学習対策として役立ちます。

更新履歴

| 日付 | 内容 |

|---|---|

| 2025年2月2日 | 初回公開 |

| 2026年5月1日 | L2正則化の定義、数式、L1正則化との違い、使いどころ、注意点を初心者向けに再構成 |