アルゴリズム

アルゴリズム リッジ回帰:滑らかなモデルを作る

峰回帰は、統計学や機械学習の分野で予測を行うための強力な手法です。複雑なデータの関係性を捉え、将来の値を予測するために活用されます。

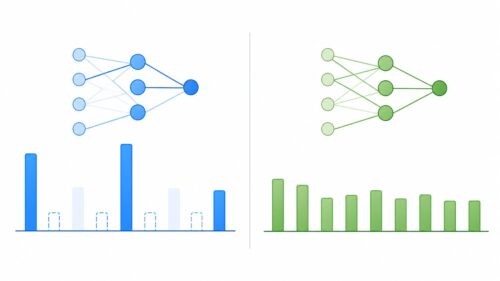

峰回帰は、重回帰分析を発展させた手法です。重回帰分析では、説明変数と目的変数の間の関係を直線で表し、説明変数の値から目的変数の値を予測します。しかし、説明変数が多く、データのばらつきが大きい場合、重回帰分析では予測が不安定になることがあります。具体的には、学習データに過剰に適合し、未知のデータに対する予測精度が低下する現象、いわゆる過学習が起こりやすくなります。

この問題に対処するために、峰回帰では正則化という工夫が用いられます。正則化とは、モデルの複雑さを抑えるための仕組みです。峰回帰では、モデルのパラメータ(重み)の大きさに制限を加えることで、過学習を防ぎます。具体的には、損失関数(予測値と実測値のずれを表す関数)に、パラメータの二乗和を加えることで、パラメータの値が大きくなりすぎるのを防ぎます。この二乗和にかかる係数を正則化パラメータと呼び、この値を調整することで、正則化の強さを制御します。正則化パラメータが大きいほど、正則化の効果が強くなり、モデルは単純になります。

峰回帰を使う利点は、データのばらつきによる影響を抑え、安定した予測モデルを作れることです。過学習を防ぐことで、未知のデータに対しても高い予測精度を維持できます。つまり、峰回帰は、様々な状況で使える、汎用性の高い予測手法と言えるでしょう。特に、説明変数の数が多い場合や、データにノイズが多い場合に効果を発揮します。

峰回帰は、様々な分野で応用されています。例えば、経済学では経済指標の予測に、医学では病気のリスク予測に、マーケティングでは顧客の購買行動の予測などに利用されています。このように、峰回帰は、複雑な現象を理解し、未来を予測するための強力な道具として、幅広い分野で活躍しています。