学習

学習 一つの大きな繋がりで学ぶ、エンドツーエンド学習

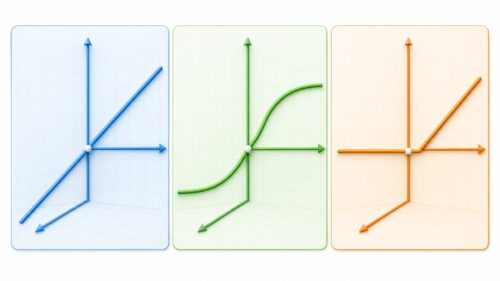

近頃、機械学習の分野で「全体をまとめて学習」という新しい学習方法が注目を集めています。この方法は「端から端まで学習」とも呼ばれ、従来の方法とは大きく異なる特徴を持っています。従来の機械学習では、問題を複数の小さな段階に分割し、それぞれの段階で個別に学習を進めていました。例えば、写真から文字を読み取るためには、まず写真の明るさやコントラストを調整する前処理を行い、次に文字が書かれている部分を特定し、最後にその部分の文字を認識するという複数の段階を踏みます。それぞれの段階で最も適した方法を用いることで、全体として良い結果を得ようとしていたのです。

しかし、全体をまとめて学習する方法は、これらの段階を全て一つにまとめます。一つの大きな繋がりを持った仕組みで、入力から出力までを直接学習するのです。写真から文字を読み取る例で言えば、写真を入力し、読み取った文字を出力するという関係だけを学習させます。この間の処理は、全てこの大きな仕組みが自動的に学習するのです。これは、複雑な機械の内部構造を知らなくても、入力と出力の関係だけから機械の操作方法を学ぶようなものです。

全体をまとめて学習する最大の利点は、全体としてより良い結果が得られる可能性があることです。従来の方法では、それぞれの段階で最適化を行いますが、それが全体にとって最適とは限りません。全体をまとめて学習することで、それぞれの段階の処理が全体最適化に貢献するように自動的に調整されるため、より良い結果につながる可能性が高まります。また、個々の段階で調整の手間が省けるため、開発にかかる時間や労力を削減できるという利点もあります。しかし、学習に必要なデータ量が膨大になる場合や、学習に時間がかかる場合もあるため、課題も残されています。今後、更なる研究開発によって、これらの課題が克服されていくことが期待されます。