アルゴリズム

アルゴリズム 探索を効率化するαβ法とは?意味と仕組みを初心者向けに解説

勝負の世界では、常に最善の一手を打つことが求められます。コンピューターゲームでもそれは変わらず、人工知能はどのようにして最適な行動を決めているのでしょうか。理想的には、考えられる全ての手を調べ、その中で最も有利な手を選ぶことです。しかし、ゲームの複雑さによっては、全ての手を調べることは現実的に不可能です。例えば、囲碁や将棋のようなゲームでは、局面の数が天文学的になり、現在のコンピューターの計算能力をもってしても、全てを調べるには時間がかかりすぎます。

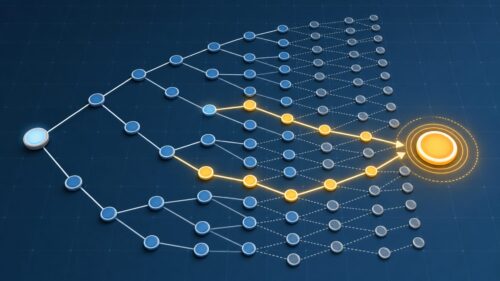

そこで、効率的に探索を行うための様々な方法が考え出されてきました。その一つが、αβ法と呼ばれる方法です。αβ法は、無駄な探索を省くことで、計算量を減らし、より深くまで探索することを可能にします。具体的には、ある局面よりも悪いと分かっている局面は、それ以上深く調べません。例えば、将棋で「王手」をかけられた局面よりも明らかに不利な局面は、その後の展開を詳しく調べる必要がないからです。αβ法は、将棋や囲碁のようなゲームだけでなく、様々な探索問題にも応用できます。例えば、経路探索や最適化問題など、様々な分野で利用されています。αβ法は、木構造と呼ばれるデータ構造を用いて探索を行います。木構造は、根と呼ばれる出発点から枝分かれして広がる構造をしており、ゲームの局面や選択肢を表現するのに適しています。αβ法は、この木構造を効率的に探索することで、最良の選択肢を見つけ出します。

αβ法は、探索の深さを調整することで、計算時間と探索の精度を両立させることができます。探索を深くすればするほど精度は上がりますが、計算時間も増えます。逆に、探索を浅くすれば計算時間は短くなりますが、精度は下がります。そのため、ゲームの性質や利用できる計算資源に合わせて、適切な探索の深さを設定することが重要です。