学習

学習 学習を最適化:AdaGrad

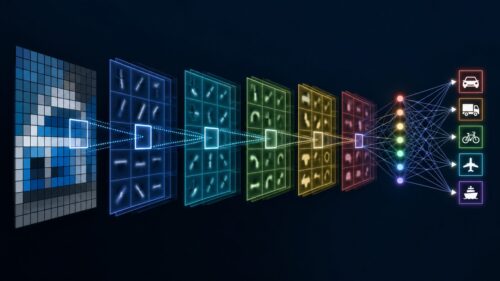

機械学習とは、コンピュータに大量の情報を学習させ、そこから規則性や関連性を見つけ出す技術のことです。この技術の中で、最適化手法は重要な役割を果たします。最適化手法とは、予測の正確さを高めるために、計算のやり方を調整する技術のことです。様々な最適化手法が存在しますが、その中で注目されている手法の一つが「エイダグラッド」です。

エイダグラッドは、過去の学習情報を活用することで、より効率的に学習を進める手法です。具体的には、過去の情報に基づいて、各々の変数の更新の大きさを調整します。例えば、過去に大きく変化した変数は、その後は小さな変化に留めるように調整されます。逆に、過去にあまり変化しなかった変数は、その後は大きく変化させるように調整されます。このように、エイダグラッドは、変数ごとに適切な学習の度合いを調整することで、全体的な学習効率を高めることを目指しています。

従来の手法では、すべての変数に対して一律に学習の度合いを調整していました。そのため、既に最適な値に近づいている変数も、そうでない変数も、同じように更新されてしまうという問題がありました。エイダグラッドは、この問題を解決するために、変数ごとに学習の度合いを調整する仕組みを取り入れています。

エイダグラッドを使うことで、学習の速度が向上するだけでなく、より精度の高い予測モデルを構築できる可能性が高まります。そのため、エイダグラッドは、画像認識や自然言語処理など、様々な機械学習の分野で活用されています。エイダグラッドは、今後も機械学習の発展に貢献していくことが期待される、重要な最適化手法と言えるでしょう。