学習係数:機械学習の鍵

AIの初心者

先生、「学習係数」って、大きすぎても小さすぎてもいけないってどういうことですか?

AI専門家

いい質問だね。目的地に着くために一歩ずつ進むことを想像してみよう。学習係数は一歩の大きさを決めるものなんだ。大きな一歩だと早く着けるかもしれないけど、通り過ぎてしまうかもしれない。逆に小さすぎると、なかなか着きそうにないよね。

AIの初心者

なるほど。じゃあ、ちょうどいい大きさの一歩を見つけるのが大切ってことですね。

AI専門家

その通り!AIの学習では、ちょうどいい学習係数を見つけることで、より早く、より正確に学習を進めることができるんだ。

学習係数とは。

人工知能の学習において、”学習係数”という用語があります。これは、パラメータ(人工知能の部品となる数値)を調整する際に、一度にどれくらい数値を変化させるかを表す数値です。この数値は常に正の値であり、大きければ大きいほど、一度の調整でパラメータの変化も大きくなります。つまり、学習の歩幅が大きくなるということです。

学習係数が大きいと、学習の歩幅が大きくなるため、目的とする精度に早く到達できる可能性があります。しかし、歩幅が大きすぎると、目的の精度を通り過ぎてしまい、うまく学習できないという問題が発生する可能性があります。逆に、学習係数が小さいと、学習の歩幅が小さくなるため、目的の精度に到達するまでに多くの回数が必要となり、学習に時間がかかってしまうという問題が発生する可能性があります。

そのため、より良い人工知能を作るためには、適切な学習係数を設定することが重要です。

はじめに

機械学習とは、与えられた情報から法則や傾向を見つけ出す技術のことで、近年様々な分野で活用が広がっています。まるで人が経験から学ぶように、機械も情報から学習し賢くなっていくのです。この機械学習において、学習の進み具合や成果に大きく影響を与える要素の一つが「学習係数」です。学習係数は、学習の際の「一歩の大きさ」を調整する役割を担っています。

例えるならば、山の頂上を目指す登山を想像してみてください。一歩が小さすぎると、頂上に辿り着くまでに時間がかかりすぎてしまいます。逆に一歩が大きすぎると、頂上を通り過ぎてしまったり、谷底に落ちてしまったりする危険性があります。学習係数も同様に、適切な大きさの一歩を設定することが重要です。小さすぎると学習に時間がかかり、なかなか良い結果が得られません。大きすぎると、最も良い結果を飛び越えてしまい、かえって精度が悪くなってしまう可能性があります。

この学習係数を適切に設定することで、より高い精度の結果を効率的に得ることが可能になります。そのため、機械学習を行う際には、この学習係数の調整が非常に重要になります。最適な学習係数は、扱う情報の種類や量、学習の目的などによって変化します。そのため、様々な値を試しながら、最適な学習係数を見つける作業が必要になります。

この記事では、学習係数の役割や、適切な値の設定方法について、より詳しく説明していきます。具体的には、よく使われる学習係数の調整方法や、最新の研究成果なども紹介することで、読者が実践的に学習係数を設定できるよう、段階的に解説していきます。

| 学習係数とは | 役割 | 設定の重要性 | 最適値の探索 |

|---|---|---|---|

| 機械学習の学習における「一歩の大きさ」 | 学習の進み具合や成果を調整 | 適切な大きさで効率よく高精度な結果を得る | 情報の種類、量、学習目的によって変化するため、様々な値を試す必要がある |

学習係数の役割

機械学習において、学習係数はモデルの訓練を左右する重要な要素です。この値は、モデルがどれくらい速く学習し、どれくらい正確に答えを見つけられるかに影響を与えます。具体的には、学習係数は損失関数の勾配を使ってモデルのパラメータを調整する際に、その調整の度合いを決める役割を担います。

損失関数とは、モデルの予測と実際の値との間の誤差を表す関数です。この関数の勾配は、どの向きにパラメータを調整すれば誤差を減らせるかを示す道しるべのようなものです。学習係数は、この道しるべに従って進む際の一歩の大きさを決める値と言えます。

もし学習係数が大きすぎると、一歩が大きすぎて最適なパラメータ値を飛び越えてしまい、学習が不安定になることがあります。まるで目的地に向かって大ジャンプを繰り返すうちに、目的地を通り過ぎて行ったり来たりしてしまうようなものです。逆に、学習係数が小さすぎると、一歩が小さすぎて学習に時間がかかりすぎることがあります。これは目的地に向かって少しずつ歩みを進めるようなもので、目的地に辿り着くまでに長い時間がかかります。

最適な学習係数の値は、扱う問題やデータによって異なります。そのため、適切な学習係数を見つけるためには試行錯誤が必要です。一般的には、最初は大きめの値から始めて、学習の進み具合を見ながら徐々に値を小さくしていく方法が用いられます。丁度良い一歩の大きさを見つけることで、モデルは効率的に学習し、より正確な予測を行うことができるようになります。

| 学習係数 | 役割 | 値が大きすぎる場合 | 値が小さすぎる場合 | 最適値の決定 |

|---|---|---|---|---|

| モデルの訓練を左右する重要な要素 | 損失関数の勾配を使ってモデルのパラメータを調整する際の調整度合いを決める | 学習が不安定になる (最適値を飛び越える) | 学習に時間がかかりすぎる (最適値への到達が遅い) | 問題やデータに依存するため、試行錯誤が必要 |

適切な学習係数の設定

機械学習において、学習の進み具合を調整する重要な要素の一つに学習係数があります。これは、モデルがどの程度大きくパラメータを更新するかを決定する値です。この値の設定はモデルの性能に大きく影響するため、適切な値を選択することが不可欠です。

もし学習係数を大きく設定しすぎると、最適なパラメータ値を飛び越えてしまう可能性があります。ちょうど、山の頂上を目指しているのに、一歩が大きすぎて頂上を通り過ぎてしまうようなものです。この結果、学習は不安定になり、望ましい結果を得ることが難しくなります。具体的には、損失関数の値が振動したり、発散したりするなどの現象が見られます。

逆に、学習係数を小さく設定しすぎると、学習の速度が非常に遅くなります。これは、一歩一歩が小さすぎて、なかなか頂上に辿り着かないようなものです。十分な学習が行われる前に学習が停滞し、最適なパラメータ値に到達できない可能性があります。結果として、モデルの性能が十分に発揮されません。

最適な学習係数は、扱うデータの性質やモデルの複雑さによって変化します。画像認識、自然言語処理など、タスクの種類によっても適切な値は異なります。そのため、常に同じ値が最適とは限りません。一般的には、様々な値を試して、モデルの性能を比較することで、最適な学習係数を決定します。例えば、0.1、0.01、0.001といった値から始めて、徐々に値を調整していくことが推奨されます。

近年では、学習の進捗に合わせて学習係数を自動的に調整する手法も研究されています。このような手法を用いることで、試行錯誤の手間を省き、より効率的に学習を進めることが可能になります。

| 学習係数 | 影響 | 結果 |

|---|---|---|

| 大きすぎる | 最適なパラメータ値を飛び越える | 学習が不安定(損失関数の値が振動、発散) |

| 小さすぎる | 学習の速度が遅い | 学習が停滞、最適なパラメータ値に到達できない |

| 最適な値 | データの性質、モデルの複雑さ、タスクの種類による | 様々な値を試して、モデルの性能を比較 |

| 自動調整 | 学習の進捗に合わせて自動調整 | 試行錯誤の手間を省き、効率的に学習 |

学習係数の調整方法

機械学習において、学習の効率を大きく左右する要素の一つに学習係数があります。これは、モデルのパラメータを更新する際に、どれくらいの大きさで変更するかを決める重要な値です。適切な学習係数を設定することで、より速く、より正確に最適なモデルを構築することができます。

学習係数を調整する有効な方法の一つとして、学習の進み具合に合わせて値を変化させることが挙げられます。具体的には、学習の初期段階では大きめの学習係数を設定します。そうすることで、モデルは大まかな探索を行い、最適なパラメータが存在するおおよその範囲を素早く見つけることができます。

学習がある程度進むと、今度はより細かい調整が必要になります。この段階では、学習係数を徐々に小さくしていくことで、パラメータの微調整を行い、最適な値へと収束させていきます。大きすぎる学習係数のままだと、最適な値を通り過ぎてしまう可能性があるため、徐々に小さくしていくことが重要です。

このような学習係数の調整方法は、学習率の減衰と呼ばれ、様々な方法が提案されています。段階的に学習係数を減衰させる方法や、指数関数的に減衰させる方法、多項式を用いて減衰させる方法などがあります。

これらの手法は、学習が進むにつれて、あるいは一定の回数ごとに、自動的に学習係数を調整します。適切な減衰方法を選ぶことで、学習の効率を高め、より良いモデルを構築することができます。どの方法が最適かは、扱うデータやモデルの種類によって異なるため、様々な方法を試して、最適なものを選ぶことが重要になります。

| 学習フェーズ | 学習係数 | 探索方法 | 目的 |

|---|---|---|---|

| 学習初期 | 大きめ | 大まかな探索 | 最適パラメータ範囲の特定 |

| 学習後期 | 小さめ | パラメータ微調整 | 最適値への収束 |

| 学習率減衰方法 |

|---|

| 段階的減衰 |

| 指数関数的減衰 |

| 多項式減衰 |

様々な学習係数最適化手法

機械学習において、学習係数はモデルの訓練を左右する重要な要素です。適切な学習係数の設定は、モデルの性能向上に直結します。近年、様々な学習係数最適化手法が開発され、より効率的なモデル学習が可能となりました。

従来の学習係数の設定方法は、試行錯誤に頼る部分が大きく、最適な値を見つけるのに時間がかかりました。しかし、近年の最適化手法は、この問題を解決する糸口となります。例えば、広く知られている手法の一つに「勢い」があります。この手法は、過去の勾配情報を考慮することで、学習の振動を抑え、より速く最適解へと近づきます。まるでボールが坂道を転がるように、勢いをつけながら最適解を目指していくイメージです。

また、「アダム」と呼ばれる手法も注目されています。「アダム」は「勢い」に加えて、各パラメータに対して異なる学習係数を適用します。これは、モデルのパラメータごとに適切な学習の度合いを調整することで、より効率的な学習を実現します。それぞれの楽器に合わせて音量を調整するオーケストラのように、各パラメータが調和しながら学習を進めていくのです。

さらに、学習の進捗状況に合わせて学習係数を自動的に調整する手法も存在します。これは、学習の初期段階では大きな学習係数を用いて大まかに学習を進め、徐々に学習係数を小さくすることで、より精密な調整を行う手法です。まるで、最初は大きな一歩で進み、目的地に近づくにつれて歩幅を小さくしていくように、学習係数を調整することで最適解へと近づいていきます。

これらの学習係数最適化手法は、学習の安定性向上と最適なパラメータ値への収束の加速に大きく貢献します。適切な手法を選択、活用することで、より高性能なモデルを構築することが可能になります。

| 手法 | 特徴 | イメージ |

|---|---|---|

| 従来手法 | 試行錯誤、時間かかる | – |

| 勢い | 過去の勾配情報を考慮、学習の振動抑制、最適解への収束高速化 | ボールが坂道を転がる |

| アダム | 勢い + 各パラメータに異なる学習係数を適用、パラメータごとの学習度合い調整 | オーケストラの楽器の音量調整 |

| 自動調整手法 | 学習進捗に合わせ学習係数を自動調整、初期は大きく徐々に小さく | 歩幅を調整しながら目的地に近づく |

まとめ

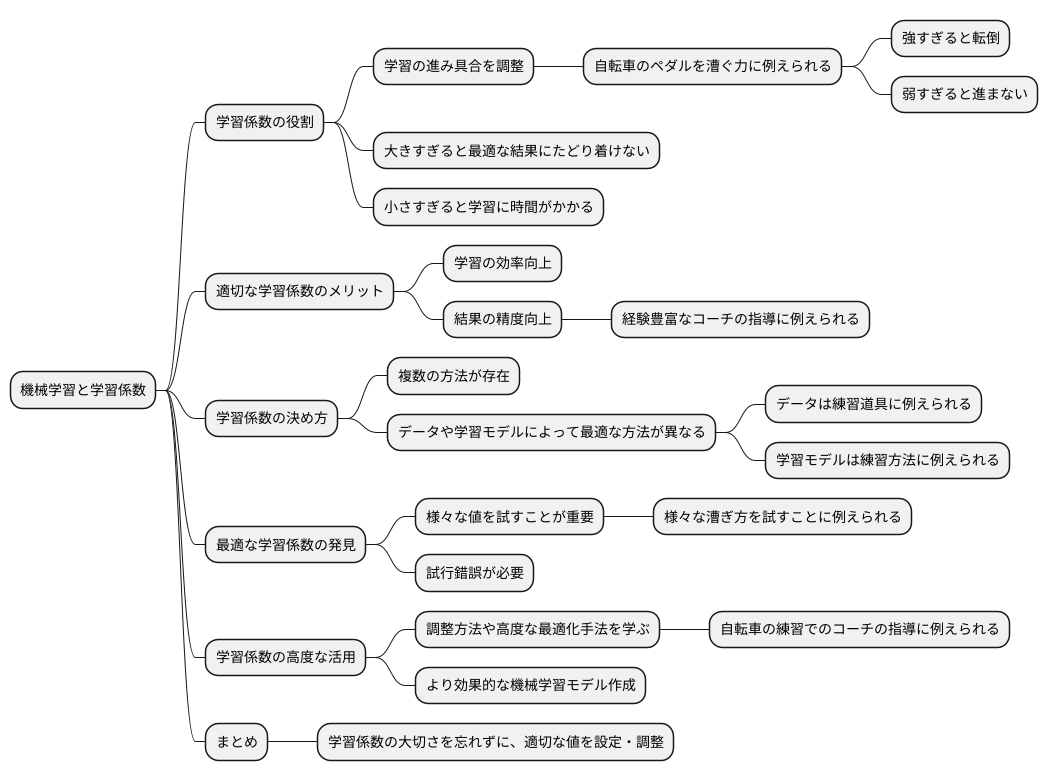

機械学習の世界では、学習係数というものがとても大切です。これは、学習の進み具合を調整する役割を果たします。ちょうど、自転車に乗る練習で、ペダルを漕ぐ力を調整するようなものです。力を入れすぎるとうまく乗れず転んでしまいますし、弱すぎると前に進みません。学習係数も同様に、大きすぎると最適な結果にたどり着けず、小さすぎると学習に時間がかかってしまいます。

適切な学習係数を設定することで、学習の効率が大きく変わります。学習が早く進むだけでなく、最終的に得られる結果の精度も向上します。まるで、経験豊富なコーチが的確な指導をしてくれるおかげで、短期間で上達するようなものです。

この学習係数を決める方法は、いくつかあります。今回の記事で紹介した方法以外にも、様々なやり方があります。どの方法が最適かは、扱うデータや学習モデルによって異なります。データは、例えるなら練習で使う道具のようなものです。自転車の練習には自転車が、水泳の練習にはプールが必要です。学習モデルは、練習方法のようなものです。同じ自転車の練習でも、補助輪をつける場合とつけない場合では練習方法が違います。道具や練習方法によって、最適なペダルの漕ぎ方が変わるように、データや学習モデルによって最適な学習係数は変わります。

そのため、色々な値を試してみて、最適な学習係数を見つけることが重要です。色々な漕ぎ方を試して、自分に合った漕ぎ方を見つけるようなものです。試行錯誤を繰り返すことで、最適な学習係数を見つけることができます。

さらに、学習係数の調整方法や高度な最適化手法を学ぶことで、より効果的に機械学習モデルを作ることができます。自転車の練習でも、ただ闇雲に練習するよりも、コーチから適切な指導を受け、練習方法を工夫することで、より早く上達できます。

これから機械学習を学ぶ際には、学習係数の大切さを忘れずに、適切な値を設定し、調整するようにしましょう。自転車に乗る練習でも、ペダルの漕ぎ方を意識することで、上達が早まるように、学習係数を意識することで、より良い機械学習モデルを作ることができるようになります。