アルゴリズム

アルゴリズム Rainbowとは?DQNを拡張した強化学習手法をわかりやすく解説

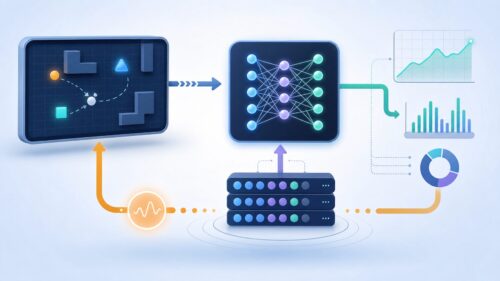

虹のように鮮やかな七色の技術を組み合わせた手法、それが2017年に発表された画期的な深層強化学習の手法、「レインボー」です。この手法は、まるで七色の光が混ざり合って美しい虹を作り出すように、七つの優れた要素技術を組み合わせることで、目覚ましい成果を生み出しています。その七つの要素技術とは、「ディーキューエヌ」と呼ばれる基本技術を土台として、「ダブルディーキューエヌ」「デュエリングネットワーク」「マルチステップラーニング」「ノイジーネットワーク」「カテゴリカルディーキューエヌ」、そして「優先度付き経験再生」です。これらの要素技術は、それぞれ単独でも高い性能を示しますが、「レインボー」はこれらを統合することで、個々の技術の力を最大限に引き出し、より高いレベルへと押し上げています。

「ディーキューエヌ」は、過去の経験から学習する強化学習の手法で、「レインボー」の基礎となっています。「ダブルディーキューエヌ」は、学習の安定性を高める工夫を加えた技術です。「デュエリングネットワーク」は、行動の価値と状態の価値を分けて学習することで、より効率的な学習を実現します。「マルチステップラーニング」は、将来の報酬を予測することで、より長期的な視点での学習を可能にします。「ノイジーネットワーク」は、学習過程にわざとノイズを加えることで、より頑健な学習を実現します。「カテゴリカルディーキューエヌ」は、報酬の分布を学習することで、より正確な予測を行います。そして「優先度付き経験再生」は、重要な経験を優先的に学習することで、学習効率を向上させます。

これらの七つの技術は、それぞれ異なる側面から深層強化学習の性能向上に貢献します。「レインボー」は、これらの技術を巧みに組み合わせることで、まるで七色の光が一つになって輝く虹のように、個々の技術の力を最大限に発揮させ、調和させています。その結果、「レインボー」は従来の手法を凌駕する性能を達成し、深層強化学習の新たな可能性を示しました。まさに、七色の技術が織りなす虹色の輝きが、深層強化学習の未来を明るく照らしていると言えるでしょう。