学習

学習 大域最適解とは?機械学習における最適解

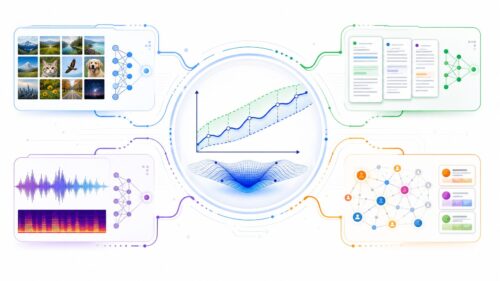

機械学習は、まるで職人が道具を調整するように、様々な数値を調整することで性能を高めます。この調整する数値のことを「媒介変数」と呼び、最も良い性能を発揮する媒介変数の組み合わせを見つけ出すことが、機械学習の肝となります。この最高の組み合わせのことを「大域最適解」と呼びます。

例えるなら、山の頂上を目指して進む登山家の姿を想像してみてください。目指す頂上はただ一つ、最も高い場所、すなわち「大域最適解」です。しかし、山には大小様々な峰が存在します。これらの小さな峰は「局所最適解」と呼ばれ、一見すると頂上に見えますが、全体で見れば真の頂上ではありません。登山家が小さな峰にたどり着き、そこが頂上だと勘違いしてしまうと、真の頂上、つまり最高の性能に到達することはできません。

機械学習も同じように、局所最適解に捕らわれてしまう危険性があります。媒介変数を調整する過程で、一見性能が上がったように見えても、それは局所最適解に過ぎないかもしれません。真に目指すべきは大域最適解であり、そこへ到達するためには、様々な工夫が必要です。

大域最適解は、モデルが持つ潜在能力を最大限に引き出す鍵です。大域最適解を見つけることで、精度の高い予測が可能になり、様々な課題を解決する強力な道具となります。大域最適解の探索は時に困難を伴いますが、その先にある成果は計り知れません。だからこそ、私たちは様々な手法を用いて、この最適な媒介変数の組み合わせを探し求めるのです。