アルゴリズム

アルゴリズム 畳み込み処理の仕組みとは?計算方法・CNNでの役割・活用例をわかりやすく解説

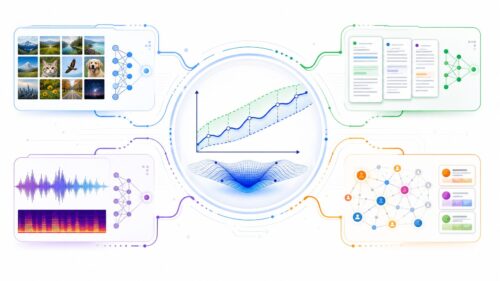

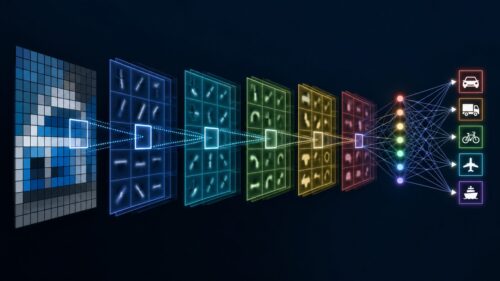

畳み込みとは、画像処理や信号処理などで広く使われている大切な演算処理です。まるで画像の上を小さな虫眼鏡が滑っていくように、入力データ全体に小さなフィルター(核とも呼ばれます)を少しずつずらして適用していきます。このフィルターは、画像の特定の特徴を見つけるための道具のようなものです。

具体的な処理としては、まずフィルターと入力データの対応する部分を掛け合わせます。例えば、フィルターが3×3の大きさであれば、入力データの同じ大きさの部分と対応させ、それぞれの数値を掛け合わせます。次に、これらの掛け合わせた結果を全て足し合わせます。これが、新しいデータ(特徴地図)のある一点の値となります。フィルターを少しずつずらして、この計算を繰り返すことで、入力データ全体の特徴地図を作成します。

この畳み込みの処理によって、入力データから様々な特徴を抽出したり、不要なノイズを取り除いたりすることができます。例えば、画像の縁(境界)を見つけるためのフィルターを適用すると、縁が強調された画像が得られます。縁とは、色の明るさや濃さが急に変化する部分のことです。このフィルターは、色の変化が大きい部分を強調し、変化が小さい部分を抑えるように設計されています。

また、ぼかし効果のあるフィルターを適用すると、画像が滑らかになります。ぼかしとは、画像の細かい部分を平均化することで、滑らかな印象にする処理です。このフィルターは、周りの画素の値を平均して、急激な色の変化を和らげるように設計されています。

このように、フィルターの種類によって様々な効果を得ることができ、画像処理の分野ではなくてはならない技術となっています。フィルターは、画像処理の目的や対象に合わせて、様々な種類が考案され、使われています。どのようなフィルターを使うかによって、画像からどのような特徴を抽出できるかが決まり、最終的な処理結果に大きな影響を与えます。