学習

学習 信用割当問題とは?誤差逆伝播法との関係をわかりやすく解説

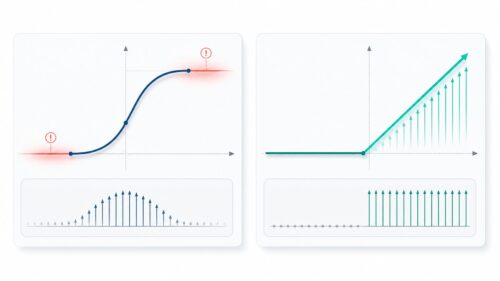

機械学習、とりわけ神経回路網の分野においては、学習の仕組みを理解することが極めて大切です。学習とは、いわば問題を解くための手順を機械に覚えさせることですが、その手順がどのように導き出されたのかを把握することは、その機械の信頼性を高める上で欠かせません。しかし、神経回路網、特に多くの層を持つ複雑な構造の回路網の場合、どの部分が予測にどのように関わっているのかを解き明かすことは容易ではありません。これは、信用割当問題と呼ばれる難題の一つです。

無数の結び目と、それらをつなぐ複雑な繋がりから成る回路網において、個々の結び目の役割を明らかにすることは、巨大な迷路の中で特定の通路の役割を見つけるようなものです。それぞれの結び目は、特定の役割を担っており、結び目同士が複雑に影響し合いながら最終的な予測結果を生み出しています。ある結び目の働きを調整することで予測の精度が向上するかもしれませんが、別の結び目の働きを調整すると、逆に精度が悪化してしまう可能性もあります。

この複雑な相互作用のため、どの結び目をどのように調整すれば全体の精度を高められるのかを判断することは非常に困難です。まるで複雑に絡み合った糸を一本ずつ丁寧に解きほぐしていくような、緻密で根気のいる作業が必要となります。この問題を解決するために、様々な工夫が凝らされ、研究が進められています。回路網の構造を単純化する方法や、結び目間の影響を分析する新しい手法などが開発されています。これらの研究の進展により、近い将来、複雑な回路網の内部 workings をより深く理解し、より信頼性の高い機械学習システムを構築することが可能になると期待されています。