学習

学習 ファインチューニングとは?意味・仕組み・転移学習との違いを初心者向けに解説

人工知能の分野で「ファインチューニング」という言葉をよく耳にするようになりました。これは、人工知能のモデルを特定の仕事に合うように、効率よく鍛え上げる手法のことです。まるで、様々な運動能力が高いスポーツ選手を、ある特定の競技の達人に仕立て上げるようなものです。

最初からすべての技術をゼロから教え込むのは大変な時間と労力がかかります。しかし、既に基本的な体力や運動能力を備えた選手であれば、特定の競技に必要な技術だけを重点的に鍛えることで、短期間で高い成果を期待できます。ファインチューニングもこれと同じ考え方です。

人工知能のモデルは、大量のデータを使って学習することで、様々な知識や能力を身につけます。この学習済みのモデルは、まるで基礎訓練を終えたスポーツ選手のようなものです。既に一般的な知識や能力を備えているため、これを土台として、特定の仕事に特化した訓練を行うことで、効率的に高い性能を発揮できるようになります。これがファインチューニングの利点です。

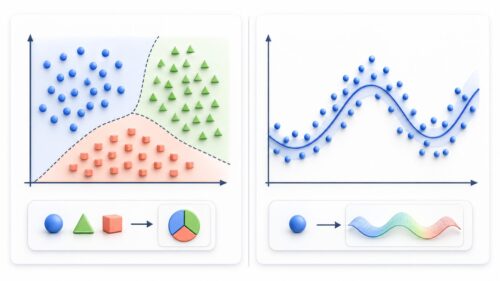

具体的には、学習済みのモデルに新たな層を追加し、既に学習済みの部分も微調整しながら、特定の仕事に関連するデータを使って再学習を行います。これにより、モデル全体が特定の仕事に最適化され、高い精度で目的の成果を出せるようになります。

例えば、画像認識の分野で、猫を認識するモデルを作りたいとします。ゼロからモデルを作るのは大変ですが、既に様々な種類の画像を認識できる学習済みモデルがあれば、それをファインチューニングすることで、効率よく猫を認識するモデルを作ることができます。具体的には、猫の画像データを使ってモデルを再学習することで、猫の特徴を捉える能力を高めます。

このように、ファインチューニングは、時間と資源を節約しながら、高性能な人工知能モデルを開発するための重要な技術となっています。