アルゴリズム

アルゴリズム 系列から系列への変換:Seq2Seqモデル

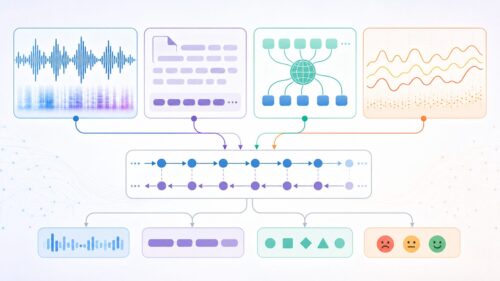

近ごろ、機械学習の進歩には目を見張るものがあり、様々な分野で活用されています。中でも、自然言語処理の分野において、時間とともに変化するデータ、いわゆる時系列データの扱いは特に重要です。例えば、文章を考えてみましょう。文章は単語が順番に並んだものであり、時間の流れに沿って意味が作られます。音声データも同様に、時間とともに変化する信号です。このような時間的順序を持つデータを扱うための強力な方法として、系列変換モデル、つまり「系列から系列へ」の変換を学習するモデルが登場しました。このモデルは、入力された系列データを別の系列データに変換する深層学習モデルであり、様々なタスクに適用できます。

具体的には、ある言語の文章を別の言語の文章に変換する機械翻訳や、音声を文字に変換する音声認識、長い文章を短い文章にまとめる文章要約など、幅広い分野で活用されています。このモデルは、入力系列と出力系列の対応関係を学習することで、複雑な変換処理を自動的に行うことができます。例えば、機械翻訳では、日本語の文章を入力すると、英語の文章が出力されます。このとき、モデルは日本語の単語と英語の単語の対応関係だけでなく、文法や語順の違いも学習します。

さらに、このモデルは過去の情報を記憶する機構を備えています。そのため、時系列データ特有の、過去の情報が現在の状態に影響を与えるという性質をうまく捉えることができます。例えば、文章のある時点での単語は、それ以前の単語の影響を受けています。音声認識においても、ある時点での音は、それ以前の音の影響を受けています。このモデルは、このような文脈情報を考慮することで、より正確な変換処理を実現しています。

このように、系列変換モデルは時系列データを扱うための強力なツールであり、自然言語処理をはじめ、様々な分野で応用が期待されています。今後、さらに研究開発が進むことで、より高度な時系列データ処理が可能になり、私たちの生活をより豊かにしてくれることでしょう。