アルゴリズム

アルゴリズム 活性化関数ELU:滑らかさと速さを両立

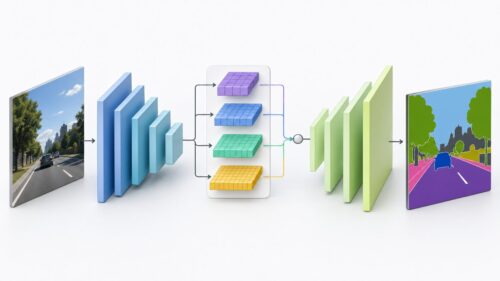

人間の頭脳の仕組みを真似た数理模型であるニューラルネットワークは、人工知能の中核を担っています。このネットワークは、神経細胞に似たたくさんの「節」が複雑に繋がった構造をしています。情報はこれらの節の間を流れながら処理されます。この情報の流れを制御する重要な役割を担うのが活性化関数です。

それぞれの節は、他の節から送られてきた複数の信号を受け取ります。これらの信号は数値で表され、足し合わされて一つの値になります。この値をそのまま次の節に送るのではなく、活性化関数という特別な計算を施します。活性化関数は、受け取った値を基に、次の節へ送る信号の強さを調整する役割を果たします。

もし活性化関数がなければ、ネットワーク全体は単純な比例計算の組み合わせでしかなく、複雑な事柄を学ぶことはできません。例えば、直線は比例計算で表せますが、曲線は比例計算だけでは表せません。活性化関数は、比例計算ではない、複雑な計算を可能にする重要な要素です。これにより、ネットワークは複雑な模様や規則性を学ぶことができ、高度な作業をこなせるようになります。

活性化関数には様々な種類があり、それぞれに特徴があります。よく使われるものとして、しきい値関数を滑らかにしたシグモイド関数や、より計算が簡単なReLU関数などがあります。これらの関数は、入力値に応じて出力値が変化する非線形関数です。つまり、入力値が2倍になったからといって、出力値も2倍になるとは限りません。この非線形性が、ニューラルネットワークの表現力を高める鍵となっています。

例えば、写真を見て何が写っているかを判断する画像認識や、人間の言葉を理解する自然言語処理など、現代の人工知能技術の多くは、活性化関数の非線形性によって支えられています。