計算資源を効率的に使う方法

近頃は、人工知能の技術が驚くほどの速さで進歩しています。中でも、特に注目を集めているのが巨大言語モデルと呼ばれるものです。このモデルは、人間が書いた文章を大量に読み込んで学習することで、まるで人間のように自然な文章を書いたり、質問に答えたりすることができるのです。

この目覚ましい進歩の理由は、モデルの規模にあります。つまり、モデルが持つ情報量を示すパラメータの数や、学習に使う文章の量が増えたことで、性能が向上したのです。規模が大きくなるほど、モデルはより複雑な作業もこなせるようになります。例えば、長い文章の要約や、異なる言語間の翻訳なども可能になります。まるで、人間の脳が大きくなるにつれて、より高度な思考ができるようになるのと似ています。

しかし、この規模の拡大には、大きな問題も付いてきます。それは、計算に使う資源の消費量が膨大になることです。モデルに学習させるには、非常に高い計算能力を持つ計算機が必要で、その計算機を動かすための電力も莫大な量になります。この大量の電力消費は、環境への負荷も大きく、このままでは持続可能な社会を実現することが難しくなります。

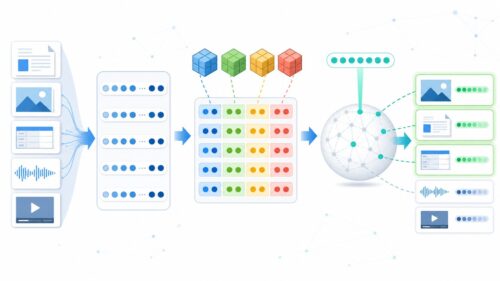

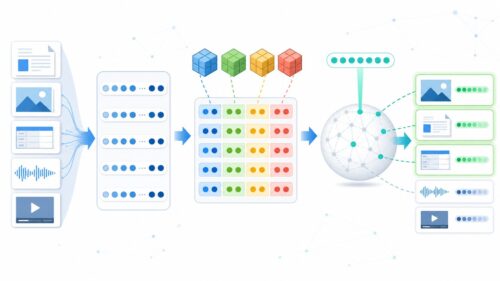

そこで、限られた計算資源をうまく活用するための技術開発が、今、非常に重要な課題となっています。例えば、計算の効率を高めるアルゴリズムの開発や、消費電力を抑えるための専用計算機の開発などが進められています。これらの技術革新によって、巨大言語モデルのさらなる発展と、環境問題への配慮を両立させることが期待されています。巨大言語モデルは、様々な分野で私たちの生活をより豊かにする可能性を秘めています。そのためにも、持続可能な形で発展させていく必要があるのです。

アルゴリズム

アルゴリズム  アルゴリズム

アルゴリズム  LLM

LLM  アルゴリズム

アルゴリズム  学習

学習  学習

学習  アルゴリズム

アルゴリズム