AIサービス

AIサービス キーワード検索の進化:ベクトル検索

これまで、多くの検索窓で使われてきた方法は、入力された言葉と全く同じ言葉が書かれた文書を探し出すものでした。例えば、「おいしい料理」と入力して検索すると、「おいしい食べ物」という言葉を含む文書は、検索結果に表示されないことがありました。これは、計算機が言葉の意味を理解しておらず、似た意味の言葉や関連する言葉を認識できないことが原因でした。

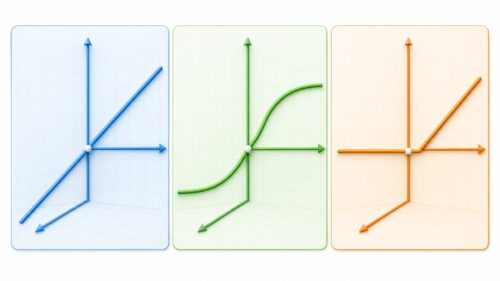

しかし、近年、「ベクトル検索」と呼ばれる新しい検索方法が登場しました。この方法は、言葉の意味を数字の列で表すことで、これまでの検索方法の問題点を解決します。この数字の列は、「ベクトル」と呼ばれ、言葉の意味を多次元空間上の点として表すことができます。似た意味を持つ言葉は、この空間上で近くに配置されるという特徴があります。例えば、「おいしい料理」と「おいしい食べ物」は、意味が近いため、空間上でも近くに位置することになります。

ベクトル検索では、この空間的な近さを利用して検索を行います。つまり、「おいしい料理」で検索した場合でも、「おいしい食べ物」のように意味が近い言葉を含む文書も検索結果に表示されるようになります。従来の方法では、入力した言葉と完全に一致する文書しか見つかりませんでしたが、ベクトル検索では、言葉の意味の繋がりを考慮した検索が可能になります。

このように、ベクトル検索は、従来の検索方法よりも、人間の思考に近い検索を実現します。私たちは、言葉の意味を理解し、関連する言葉を連想しながら考えます。ベクトル検索は、この人間の思考プロセスを、計算機上で再現することを目指した技術と言えるでしょう。これにより、より柔軟で精度の高い情報検索が可能になり、私たちの生活をより豊かにする可能性を秘めています。