学習

学習 バッチ正規化とは?仕組み・計算手順・標準化との違いをわかりやすく解説

深層学習と呼ばれる、多くの層を持つ学習手法は、画期的な成果を上げていますが、学習の難しさも抱えています。層が深くなるにつれて、各層への入力データの分布が学習中に変化してしまうのです。これは、前の層のパラメータが更新される度に、次の層への入力データの分布が影響を受けるためです。このような現象を内部共変量シフトと呼び、学習の効率を悪くする大きな要因となっています。

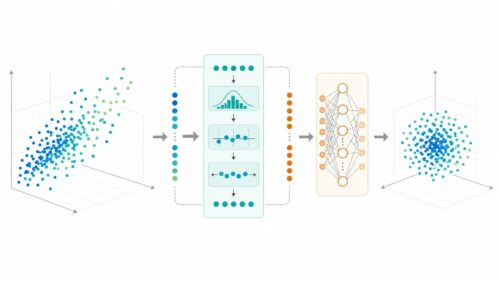

そこで、内部共変量シフト問題を解決するために、バッチ正規化という手法が考案されました。この手法は、ミニバッチと呼ばれる少量の学習データごとに、入力データの分布を調整します。具体的には、ミニバッチ内のデータの平均値をゼロ、標準偏差を1に変換する処理を各層ごとに行います。

平均値をゼロ、標準偏差を1にすることで、各層への入力データの分布が常に一定の範囲に収まるようになり、学習の安定化が期待できます。まるで、でこぼこ道を平らにすることで、歩きやすくなるようなものです。

さらに、バッチ正規化は学習速度の向上にも貢献します。学習が安定することで、より大きな学習率を設定できるようになり、学習の進みが速くなります。また、パラメータの初期値に対する依存度も軽減されるため、初期値の設定に頭を悩ませる必要も少なくなります。

このように、バッチ正規化は深層学習において、内部共変量シフト問題を軽減し、学習を安定させ、効率化するための重要な手法となっています。これにより、より深い層を持つ複雑なネットワークの学習も可能になり、様々な分野で応用されています。