AI活用

AI活用 見込み客を点数で管理:リードスコアリングとは

見込みのあるお客さまを見つけ出すことは、商売繁盛の鍵となります。そのためには、どの見込み客がより高い関心を持っているのか、誰が実際に商品を買ってくれる可能性が高いかを的確に見極める必要があります。この作業を効率的に行うための方法として、見込み客に点数をつける方法があります。これは「見込み客点数評価」と呼ばれ、多くの会社で取り入れられています。

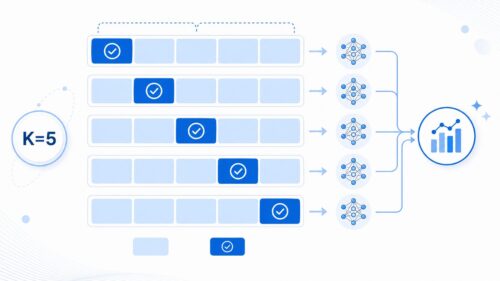

見込み客点数評価とは、文字通り、見込み客一人ひとりに点数をつけ、その点数で関心の度合いを見える化する手法です。点数は、お客さまの行動や特徴に基づいて計算されます。例えば、会社のホームページに何度も足を運んでいる人や、商品案内の資料をダウンロードした人には高い点数がつきます。反対に、ホームページを一度見ただけでその後何もしていない人などは、低い点数になります。

点数をつけるための材料は様々です。ホームページへの訪問回数以外にも、どのページをどれくらい見ていたか、問い合わせフォームからどんな質問を送ってきたかなども重要な情報となります。さらに、会社の規模や業種、役職といった情報も点数に影響を与える要素になります。これらの情報を組み合わせて、それぞれの会社に合った独自の点数計算方法を作ります。

見込み客点数評価を導入することで、営業担当者は高い点数を持った見込み客に優先的に対応できるようになります。限られた時間の中で、より成約に繋がりやすいお客さまに集中することで、営業活動の効率を大幅に向上させることが可能です。また、点数に基づいて顧客への対応を変えることもできます。例えば、高い点数の人には特別なキャンペーン情報を送ったり、営業担当者から直接電話をかけたりするなど、より丁寧な対応をすることができます。このように、見込み客点数評価は、売上向上に大きく貢献する強力な手法と言えるでしょう。