アルゴリズム

アルゴリズム 高速テキスト分類器:fastText

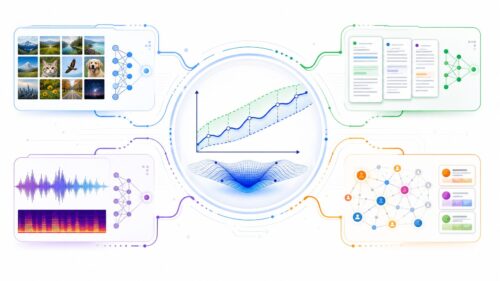

「高速テキスト分類器」、通称「fastText」とは、交流サイトを運営する会社の研究所で作られた、文章を扱うための便利な道具です。これは、言葉を数字の列に変換してコンピュータに意味を理解させたり、文章を決められた種類に仕分けることを得意としています。

言葉を数字の列に変換する技術は「単語の表現学習」と呼ばれ、コンピュータが言葉の意味を理解するのに役立ちます。例えば、「王様」と「男性」は近い数字の列、「王様」と「テーブル」は遠い数字の列に変換されることで、コンピュータはこれらの言葉の関連性を理解できます。

文章を種類分けする技術は「テキスト分類」と呼ばれ、様々な用途で使われています。例えば、「この映画は最高!」という文章は「肯定的」に、「この映画は最悪…」という文章は「否定的」に分類できます。このように、文章の内容を自動的に判断し、分類することが可能になります。

fastTextはこれらの技術を素早く効率的に行うため、多くの場面で活用されています。例えば、人の気持ちを分析する「感情分析」、迷惑な広告メールを見分ける「迷惑メール判別」、膨大な資料を種類分けする「文書分類」など、様々な応用が考えられます。

fastTextの大きな特徴は、その処理速度です。大量の文章データを扱う場合でも、高速に処理できるため、大規模な分析に適しています。また、様々な国の言葉を扱うことができるため、多言語の文章データにも対応可能です。

このように、fastTextは言葉の分析を高速かつ効率的に行うための強力な道具であり、様々な分野で役立つ可能性を秘めています。今後、更なる発展と応用が期待される技術と言えるでしょう。