LLM

LLM 位置エンコーディングとは?Transformerに順序を教える仕組みを解説

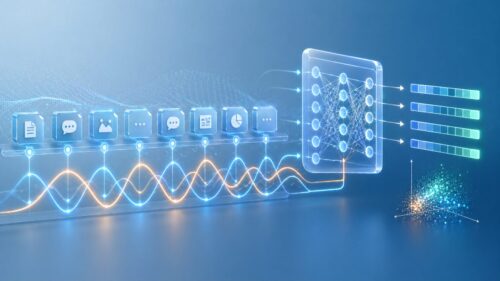

近ごろ、言葉を扱うコンピューター技術が大きく進歩し、まるで人間のように文章を理解したり、文章を作ったりする人工知能が現実のものになりつつあります。この進歩を支えている技術の一つに、「変形する器」という意味を持つ「トランスフォーマー」と呼ばれる仕組みがあります。このトランスフォーマーは、文章の中の単語同士の関係性を理解するのが得意で、外国語を私たちの言葉に翻訳したり、新しい文章を作ったりといった作業で高い能力を発揮します。

トランスフォーマーが文章を理解する上で重要な役割を果たしているのが、「位置の情報」です。人間であれば、「太郎が花子にプレゼントを渡した」と「花子が太郎にプレゼントを渡した」のように、単語の順番が変われば意味も変わることがすぐに分かります。しかし、コンピューターにとっては、単語の順番を理解するのは簡単ではありません。そこで、単語の位置情報をコンピューターに教えるために、「位置符号化」と呼ばれる技術が使われます。この位置符号化を理解することは、トランスフォーマーの仕組みを理解する上で欠かせません。

では、位置符号化とは一体どのようなものでしょうか?簡単に言うと、位置符号化とは、各単語が文章のどの位置にあるのかを数値で表したものです。例えば、「今日、私は学校へ行く」という文章があるとします。「今日」は一番最初の単語なので「1」、「私」は二番目の単語なので「2」、というように、それぞれの単語に番号を振っていきます。そして、この番号を基に、三角関数などを用いて特別な計算を行い、各単語に位置を表す固有の数値を割り当てます。

このようにして作られた位置情報は、トランスフォーマーが文章の意味を理解するために重要な役割を果たします。位置情報がないと、トランスフォーマーは単語の順番を無視してしまい、文章の意味を正しく理解することができません。この記事では、位置符号化とは何か、なぜ必要なのか、そしてどのように計算されるのかについて詳しく説明しました。これらを理解することで、トランスフォーマーの仕組みをより深く理解できるようになるでしょう。