鞍点:機械学習における落とし穴

AIの初心者

先生、「鞍点」って、馬の鞍みたいな形をしているからそう呼ばれているんですよね?

AI専門家

そうだね、良いところに気がついたね。馬の鞍のような形をしているから「鞍点」と呼ばれているんだ。ある方向から見ると谷底のように一番低い点に見えるけれど、別の方向から見ると山の頂上のように一番高い点に見える、不思議な点なんだよ。

AIの初心者

なんだか、どっちつかずな点ですね。AIの学習では、どうしてこれが問題になるのですか?

AI専門家

AIの学習は、一番低い点を見つけることで最適な状態を目指しているんだ。鞍点では、ある方向では低い点なので、まるで一番低い点に辿り着いたように見える。でも、実際には違う方向にはもっと低い点がある。だから、鞍点で学習が止まってしまうと、本当はもっと良い状態があるのに、それを見つけられないまま終わってしまうんだ。

鞍点とは。

人工知能の分野でよく使われる「あんてん」という用語について説明します。あんてんとは、ある方向から見ると一番低い谷底のように見え、別の方向から見ると一番高い山頂のように見える地点のことです。機械学習では、誤差を少なくするように学習を進めていきますが、この誤差を示す関数にあんてんが生じると問題が起こります。本来の最小値に到達していないにも関わらず、あたかも谷底にいるかのように傾きがなくなってしまい、学習が止まってしまうのです。

鞍点とは

馬の鞍のような形を想像してみてください。馬の背中に沿って前後に見ると、鞍の中央は最も低い位置になっています。しかし、馬の胴体に対して垂直に、左右を見ると、鞍の中央部分は盛り上がっています。まさに、ある方向から見ると谷底、別の方向から見ると山頂のように見える、これが鞍点です。

数学的に表現すると、鞍点は多次元の空間で定義された関数の特別な点です。この点の周辺のごく狭い範囲に着目すると、ある方向に進むと関数の値が増加し、別の方向に進むと減少します。二次元の平面上では、ちょうど馬の鞍のような形になります。ある方向に沿って切ると下に凸のカーブ、別の方向に沿って切ると上に凸のカーブを描きます。

この鞍点という概念は、様々な分野で登場しますが、特に機械学習の分野では重要な意味を持ちます。機械学習では、学習の目標は、ある関数の値を最小にする、あるいは最大にする最適な点を見つけることです。しかし、学習過程で鞍点に捕まってしまうと、そこが真の最適解ではないにもかかわらず、抜け出せなくなる可能性があります。なぜなら、鞍点の周辺では、どの方向に少し進んでも関数の値が良くなったり悪くなったりを繰り返すだけで、全体としては改善しないからです。まるで、山登りで頂上を目指しているのに、鞍部に留まってしまい、真の頂上に到達できないような状態です。そのため、機械学習のアルゴリズム開発では、この鞍点の問題をいかに回避するかが大きな課題となっています。

| 特徴 | 説明 |

|---|---|

| 形状 | 馬の鞍のような形。ある方向で見ると谷底、別の方向で見ると山頂。 |

| 数学的表現 | 多次元空間の関数における特別な点。ある方向で増加、別の方向で減少。 |

| 機械学習での意味 | 学習の目標(最小値/最大値)を達成するための最適点ではないにも関わらず、その周辺で値が改善しないため、学習過程で抜け出せなくなる可能性のある点。 |

| 機械学習での課題 | 鞍点に捕まらないように、いかに回避するかが重要。 |

機械学習における問題点

近年の計算機の性能向上に伴い、機械学習、中でも深層学習は目覚ましい発展を遂げてきました。画像認識や自然言語処理といった様々な分野で、複雑な課題を解決する強力な手法として注目を集めています。深層学習では、膨大なデータからパターンや特徴を自動的に学習することで、高度な識別や予測を可能にします。この学習過程は、誤差関数と呼ばれる指標を最小化するように進められます。誤差関数は、モデルの予測と実際の値とのずれを表すもので、このずれが小さいほど、モデルの性能が良いと判断されます。

誤差関数を最小化するためによく用いられる手法が、勾配降下法です。勾配降下法は、関数の傾きが最も急な方向にパラメータと呼ばれるモデル内部の数値を調整することで、徐々に誤差関数の値を小さくしていく方法です。このパラメータの調整は、関数の勾配に基づいて行われます。勾配は、各パラメータがわずかに変化したときに、誤差関数の値がどれくらい変化するかを示す指標です。勾配が大きいほど、そのパラメータが誤差関数に与える影響が大きいことを意味します。

しかし、この勾配降下法には課題も存在します。誤差関数に鞍点と呼ばれる平坦な領域が存在する場合、勾配が零になってしまうことがあります。鞍点は、ある方向から見ると極小点のように見えますが、別の方向から見ると極大点のように見える特殊な点です。勾配が零になると、勾配降下法はそれ以上パラメータを更新できなくなり、学習が停止してしまいます。これは、実際には誤差関数の真の最小値に到達していないにもかかわらず、鞍点で学習が止まってしまうことを意味します。結果として、モデルの性能が十分に発揮されない可能性があります。この問題は、特に高次元空間を扱う深層学習において深刻です。なぜなら、高次元空間には鞍点が多く存在する傾向があるからです。そのため、鞍点への停滞を回避するための様々な研究が盛んに行われています。

| 項目 | 説明 |

|---|---|

| 深層学習 | 膨大なデータからパターンや特徴を自動的に学習し、高度な識別や予測を可能にする機械学習の手法。誤差関数を最小化することで学習を進める。 |

| 誤差関数 | モデルの予測と実際の値とのずれを表す指標。この値が小さいほど、モデルの性能が良い。 |

| 勾配降下法 | 誤差関数を最小化するためによく用いられる手法。関数の傾きが最も急な方向にパラメータを調整することで、徐々に誤差関数の値を小さくしていく。 |

| 勾配 | 各パラメータがわずかに変化したときに、誤差関数の値がどれくらい変化するかを示す指標。 |

| 勾配降下法の課題 | 誤差関数に鞍点と呼ばれる平坦な領域が存在する場合、勾配が零になり学習が停止してしまう。 |

| 鞍点 | ある方向から見ると極小点、別の方向から見ると極大点のように見える特殊な点。 |

| 鞍点問題の影響 | 真の最小値に到達せず学習が停止し、モデルの性能が十分に発揮されない可能性がある。高次元空間を扱う深層学習では特に深刻。 |

| 今後の研究 | 鞍点への停滞を回避するための様々な研究が盛んに行われている。 |

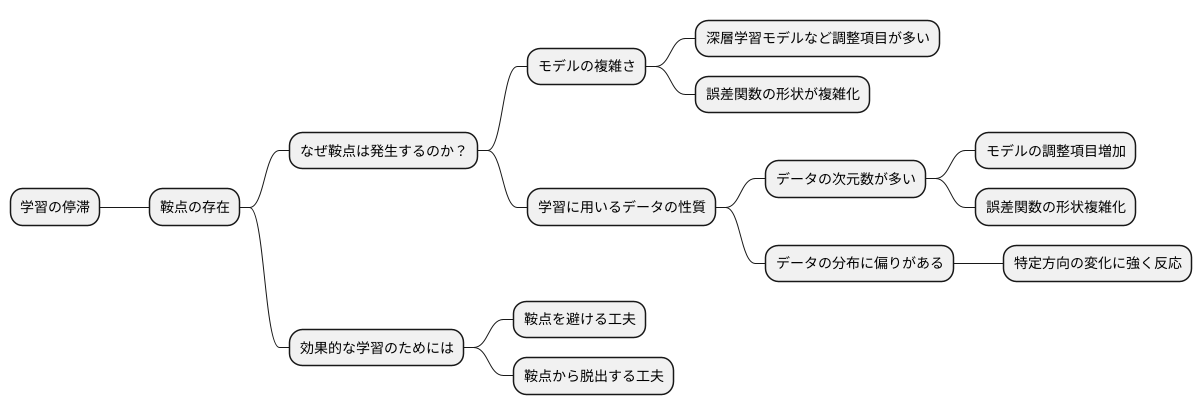

鞍点の発生原因

機械学習において、学習の停滞は大きな課題です。この停滞を引き起こす要因の一つに、鞍点の存在が挙げられます。鞍点とは、ある方向で見れば極小点のように見えながら、別の方向では極大点のように見える、いわば馬の鞍のような形状をした点です。この鞍点に学習が捕まってしまうと、そこから抜け出すことが難しくなり、学習が進まなくなってしまいます。

では、なぜ鞍点は発生するのでしょうか。まず大きな要因として、扱うモデルの複雑さが挙げられます。特に、近年の深層学習モデルのように膨大な数の調整項目を持つモデルでは、誤差を表す関数の形が非常に複雑になり、高次元空間において鞍点が現れやすくなります。まるで起伏の激しい山脈に、無数の鞍部が存在するようなイメージです。

次に、学習に用いるデータの性質も鞍点の発生に大きく関わっています。データが持つ情報の次元数が多い、つまりデータが複雑なほど、それを学習するために必要なモデルの調整項目も多くなり、結果として誤差関数の形が複雑化し、鞍点が発生しやすくなります。また、データの分布に偏りがある場合、特定の方向への変化に対してのみ強く反応し、他の方向への変化は無視される傾向が生じます。これは、特定の谷間への道だけが急勾配で、他の道は平坦な地形のようなものです。このような状況では、学習は容易にその谷間に落ち込み、鞍点に捕まってしまう可能性が高まります。

このように、鞍点の発生はモデルの複雑さとデータの特性が複雑に絡み合って生じる現象であり、効果的な学習を実現するためには、鞍点を避ける、あるいは鞍点から脱出するための様々な工夫が必要となります。

鞍点への対策

機械学習において、複雑な関数の最小値を見つけることは重要な課題です。しかし、その過程で鞍点と呼ばれる地点に遭遇することがあります。鞍点は、ある方向から見ると谷底のように見えますが、別の方向から見ると尾根のように見える特殊な点です。このような地点では、勾配がほぼゼロになるため、学習が停滞してしまう可能性があります。

鞍点による学習の停滞を避けるためには、様々な工夫が凝らされています。その一つとして、確率的勾配降下法(SGD)の改良版が挙げられます。通常の勾配降下法は、全ての学習データを使って勾配を計算しますが、計算に時間がかかります。一方、SGDは学習データの一部を無作為に選び、それを使って勾配を計算します。この無作為性のおかげで、鞍点に完全に捕まってしまうのを防ぎ、学習を続けられる可能性が高まります。

また、勢いを模倣した手法も有効です。これは、過去の勾配の情報を積み重ね、現在の勾配と合わせて使うことで、まるでボールが坂道を転がるように学習を進める方法です。過去の勾配の情報を使うことで、鞍点のような平坦な場所でも勢いを利用して乗り越えることが期待できます。さらに、AdamやRMSpropといった最適化手法も鞍点対策として有効です。これらの手法は、学習の進み具合に応じて、パラメータごとの学習率を調整します。これにより、より効率的に最小値を探し出すことができます。具体的には、各パラメータの勾配の大きさや変化の度合いを見て、学習率を調整します。

これらの手法を適切に組み合わせることで、鞍点による学習の停滞を効果的に防ぎ、より良い学習成果を得ることが期待できます。

| 鞍点問題 | 対策 | 説明 |

|---|---|---|

| 学習の停滞 | 確率的勾配降下法(SGD) | データの一部を無作為に選び勾配計算することで、鞍点に完全に捕まるのを防ぐ。 |

| 勢い | 過去の勾配情報を積み重ね、鞍点のような平坦な場所を勢いで乗り越える。 | |

| Adam, RMSprop | パラメータごとの学習率を調整し、効率的に最小値を探す。 |

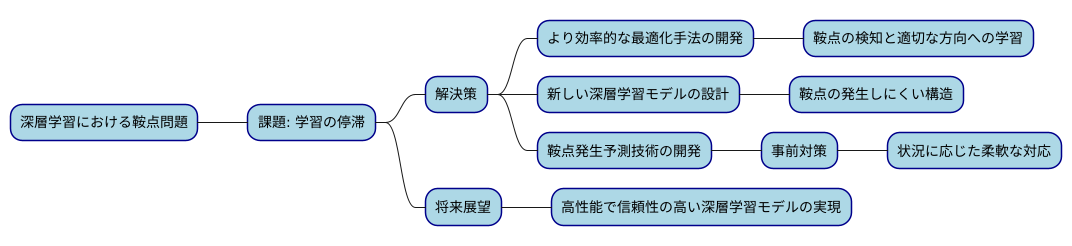

今後の展望

機械学習、とりわけ深層学習という分野において、学習の停滞を引き起こす「鞍点」という問題が大きな壁となっています。この問題を解消すべく、現在も世界中で盛んに研究が行われています。今後の研究の方向性としては、まず鞍点問題をうまく乗り越える、より効率的な最適化手法を開発することが重要です。現在の学習方法は、山を下るように最適な値を探しますが、鞍点のような平坦な場所では、どちらに進んでいいのか分からず、学習が止まってしまいます。そこで、鞍点を素早く検知し、適切な方向へと学習を導く新しい手法の開発が期待されています。

また、鞍点そのものが発生しにくいような、新しい深層学習モデルの設計も重要な研究テーマです。モデルの構造や学習方法を工夫することで、最初から鞍点の発生を抑え、よりスムーズな学習を実現できる可能性があります。さらに、鞍点の発生を事前に予測する技術の開発も重要です。どのような条件で鞍点が発生しやすいかを事前に把握できれば、あらかじめ対策を講じることが可能になります。例えば、学習の初期段階で鞍点が発生しやすいと分かれば、その段階では特別な学習方法を用いるなど、状況に応じた柔軟な対応が可能になります。これにより、学習の効率を大幅に向上させ、深層学習モデルの性能向上に大きく貢献できると期待されます。

このように、深層学習の性能向上を目指す上で、鞍点問題の理解と対策は欠かせません。今後の研究の進展によって、より高性能で信頼性の高い深層学習モデルが実現すると期待されています。