ε-greedy方策とは?探索と活用のバランスをわかりやすく解説

AIの初心者

「ε-greedy方策」って何ですか? 強化学習では、いつも一番よさそうな行動を選べばよいのではないですか?

AI専門家

現時点で一番よさそうな行動だけを選ぶと、まだ試していない行動の中にもっと良い選択肢があっても見逃すことがあります。そこでε-greedy方策では、ときどきランダムな行動も試します。

AIの初心者

わざと違う行動を試すことで、新しい可能性を探すんですね。どのくらいの頻度で試すのですか?

AI専門家

その頻度を決めるのがεです。たとえばεを0.1にすると、約10%はランダムに探索し、残りの約90%は今までの経験で最も良いと推定される行動を選びます。

ε-greedy方策とは。

ε-greedy方策は、強化学習でエージェントが行動を選ぶときに使われる基本的な方策です。一定の確率εでランダムな行動を選び、それ以外の確率では現時点で最も価値が高いと考えられる行動を選びます。単純な仕組みですが、未知の選択肢を試す「探索」と、これまでの知識を使う「活用」のバランスを取るうえで重要な考え方です。

はじめに

強化学習は、エージェントが環境の中で行動し、その結果として得られる報酬をもとに学習する機械学習の一分野です。ゲームでより高い得点を目指すAI、ロボットの動作制御、広告や推薦の最適化など、試行錯誤からより良い行動を学ぶ場面で使われます。

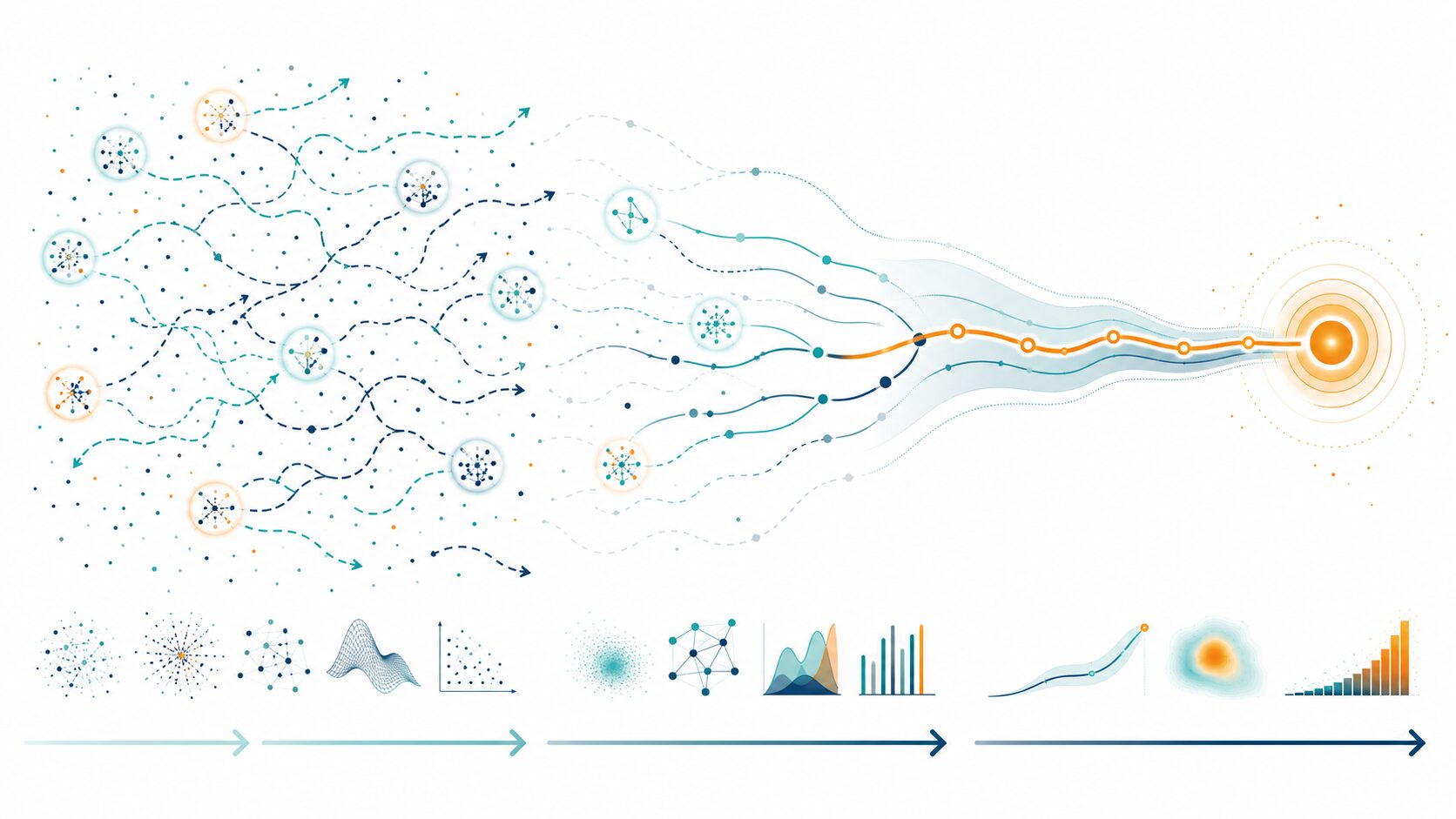

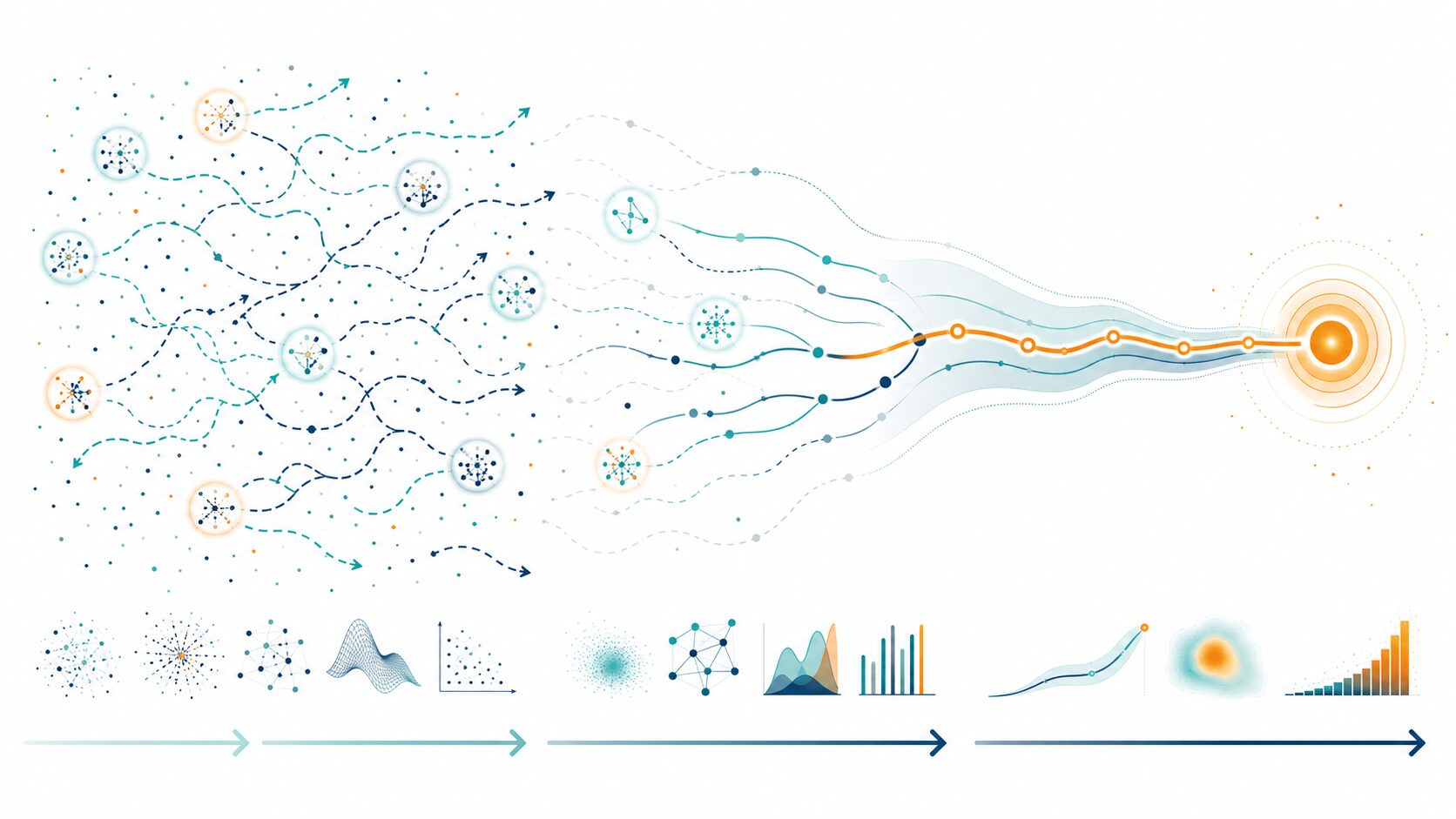

このとき重要になるのが、エージェントが次にどの行動を選ぶかです。現時点で最も良さそうな行動だけを選び続ければ、短期的には安定した報酬を得られるかもしれません。しかし、まだ試していない行動の中にもっと良い選択肢がある場合、その可能性を見つけられません。

一方で、ランダムな行動ばかり選ぶと、未知の選択肢は広く調べられますが、すでに見つけた良い行動を十分に活かせず、学習効率が下がります。つまり強化学習では、探索と活用のバランスをどう取るかが学習の成果を大きく左右します。ε-greedy方策は、この問題に対するシンプルで実用的な解決策です。

ε-greedy方策とは

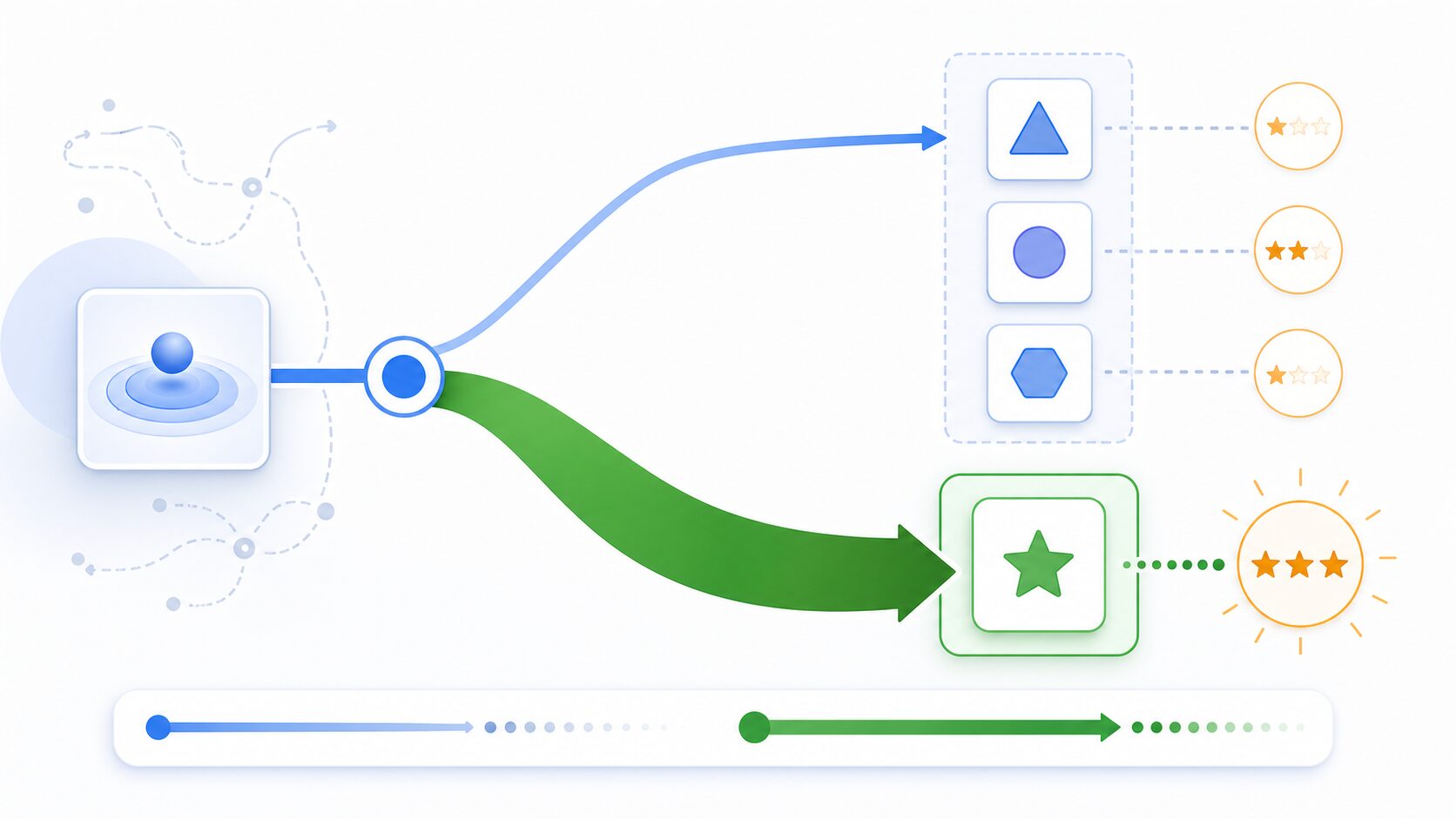

ε-greedy方策(イプシロン・グリーディー方策)とは、強化学習における行動選択アルゴリズムの一つです。名前の中の「greedy」は、現時点で最も良いと推定される行動を選ぶことを意味します。ただし、常に greedy に行動するのではなく、確率εでランダムな行動も選びます。

具体的には、行動を選ぶたびに次のように判断します。確率εでは、利用可能な行動の中からランダムに選びます。これは探索です。残りの確率1-εでは、これまでの学習で最も価値が高いと推定される行動を選びます。これは活用です。

たとえばε=0.1なら、約10%の確率でランダムな行動を選び、約90%の確率で現時点の最良行動を選びます。ここで注意したいのは、この「最良行動」は真の意味で最適と証明された行動ではなく、今までの経験から最も良さそうだと推定されている行動だという点です。

この仕組みによって、エージェントは基本的には良い行動を選びつつ、ときどき別の行動を試せます。単純ですが、強化学習の初期実験やQ学習、SARSAなどの基本的な手法と組み合わせやすく、入門から実務のベースラインまで広く使われます。

探索と活用のジレンマ

探索とは、まだ十分に試していない行動を選び、より良い選択肢がないか調べることです。たとえば、いつも同じ店に行くのではなく、新しい店に入ってみるようなものです。失敗する可能性もありますが、より良い店を見つける可能性もあります。

活用とは、これまでに得た情報を使って、現時点で最も良いと考えられる行動を選ぶことです。お気に入りの店に行けば、満足できる確率は高いでしょう。しかし、それだけを続けると、他にもっと良い店があっても気づけません。

強化学習でも同じです。探索が少なすぎると、局所的な最適解にとどまりやすくなります。活用が少なすぎると、報酬を得る機会を逃し、学習が不安定になります。ε-greedy方策は、εという一つの値でこのジレンマを扱える点が特徴です。

| 考え方 | 意味 | 例 | 注意点 |

|---|---|---|---|

| 探索 | 未知の行動を試し、より良い選択肢を探す | 新しい店を試す、ゲームで別の戦略を試す | 短期的には報酬が下がることがある |

| 活用 | 現時点で最も良いと推定される行動を選ぶ | いつもの店に行く、勝率の高い戦略を使う | より良い未知の行動を見逃すことがある |

| ε-greedy方策 | εで探索し、1-εで活用する | ε=0.1なら10%探索、90%活用 | εの設定次第で学習効率が変わる |

εの決め方

εは0から1の間で設定します。εが大きいほどランダムな探索が増え、εが小さいほど現時点の最良行動を選びやすくなります。たとえばε=0なら完全に greedy な方策となり、探索を行いません。ε=1なら常にランダムに行動し、学習した知識を活用しません。

実際には、ε=0.1や0.05のような小さめの値を固定して使う方法があります。固定εは理解しやすく、実装も簡単です。ただし、学習の初期も後半も同じ割合でランダム行動を続けるため、問題によっては探索が不足したり、逆に後半のランダム行動が無駄になったりします。

もう一つの考え方が、学習初期はεを大きくし、学習が進むにつれて小さくする方法です。これはε減衰と呼ばれることがあります。最初は多くの行動を試して環境を広く知り、後半は学習した価値を活かして安定した行動を選ぶ設計です。

初心者が混同しやすい点として、εは「良い行動を選ぶ確率」ではありません。εは「ランダムに試す確率」です。εを小さくすれば常に性能が良くなるわけではなく、学習初期に小さすぎると探索不足になりやすい点に注意が必要です。

ε-greedy方策の利点

ε-greedy方策の大きな利点は、仕組みが非常に単純なことです。行動価値を比較して最良行動を選ぶ処理に、一定確率でランダム行動を混ぜるだけなので、複雑な計算を必要としません。強化学習の基本を学ぶ段階でも理解しやすく、実装の見通しも立てやすい方法です。

また、調整すべき中心的な値がεであるため、探索と活用の割合を直感的に変えられます。εを大きくすれば探索を増やし、小さくすれば活用を増やせます。試行錯誤しながら学習曲線を観察し、問題に合う設定を探すこともできます。

さらに、ε-greedy方策は他の強化学習アルゴリズムと組み合わせやすい点も重要です。Q学習やSARSAでは、行動価値を更新する部分と、次の行動を選ぶ部分を分けて考えられます。ε-greedy方策はこの行動選択部分として使えるため、強化学習のベースラインとして扱いやすい手法です。

| 利点 | 説明 |

|---|---|

| 実装しやすい | 確率でランダム行動を混ぜるだけなので、基本構造がわかりやすい |

| 計算量が少ない | 複雑な推定や追加モデルを必要としにくい |

| 調整が直感的 | εを変えることで探索と活用の割合を調整できる |

| 組み合わせやすい | Q学習、SARSA、関数近似などの行動選択部分に使いやすい |

ε-greedy方策の欠点

一方で、ε-greedy方策には弱点もあります。まず、εの値をどう決めるかが問題になります。εが大きすぎるとランダム行動が多くなり、せっかく学習した良い行動を十分に活用できません。εが小さすぎると探索が不足し、早い段階で見つけたそこそこ良い行動に偏る可能性があります。

また、ランダムに探索するとき、ε-greedy方策は基本的にすべての行動を同じように選びます。そのため、明らかに見込みの低い行動も、良さそうな未知の行動も同じ確率で選ばれることがあります。これは単純さの裏返しであり、探索効率の面ではUCBやソフトマックス方策のような手法の方が適する場合もあります。

さらに、環境が複雑で行動の数が多い場合、単純なランダム探索だけでは十分に良い行動へたどり着くまで時間がかかります。ε-greedy方策は便利な出発点ですが、常に最良の探索方法とは限りません。まずベースラインとして試し、必要に応じてより高度な方策と比較するのが実務的です。

適用事例

ε-greedy方策は、探索と活用のバランスが必要な場面で広く使えます。ゲームAIでは、これまで勝率の高かった行動を選びつつ、ときどき別の攻撃や移動を試すことで、新しい戦略を発見できる可能性があります。

広告配信でも考え方は似ています。クリック率が高い広告を優先して表示するだけでは、新しい広告の可能性を評価できません。そこで、一定割合で新しい広告を表示し、反応を観察することで、より効果的な広告を見つけやすくなります。

ロボット制御では、これまで成功した動作を活用しながら、少し違う動作も試すことで、より効率の良い制御方法を学習できます。推薦システムやA/Bテストに近い場面でも、既知の良い選択肢を使いながら未知の候補を試すという考え方は重要です。

| 分野 | 活用イメージ |

|---|---|

| ゲームAI | 高報酬だった戦略を使いながら、新しい戦略も試す |

| 広告配信 | 実績のある広告を表示しつつ、新しい広告の反応も調べる |

| ロボット制御 | 成功した動作を活かしながら、改善につながる動作を探索する |

| 推薦・実験設計 | 既知の人気候補を出しつつ、未知の候補を少しずつ評価する |

まとめ

ε-greedy方策は、強化学習における行動選択の基本手法です。確率εでランダムに探索し、確率1-εで現時点の最良行動を活用することで、未知の選択肢を試す機会と、学習済みの知識を使う機会を両立します。

重要なのは、εを「探索の確率」として理解することです。εが大きすぎるとランダム性が強くなり、εが小さすぎると探索不足になります。問題の性質や学習段階に応じて、固定εやε減衰を使い分けることが大切です。

ε-greedy方策は単純で実装しやすいため、Q学習やSARSAを学ぶときの出発点として適しています。一方で、行動数が多い問題や探索効率が重要な問題では、UCBやソフトマックス方策などとの比較も検討するとよいでしょう。

更新履歴

| 日付 | 内容 |

|---|---|

| 2025年2月2日 | 初回公開 |

| 2026年4月30日 | ε-greedy方策の定義、探索と活用の違い、εの決め方、利点・欠点、応用例を初心者向けに再構成 |