コスト関数:機械学習の最適化を学ぶ

AIの初心者

先生、「コスト関数」ってよく聞くんですけど、難しそうでよくわからないです。簡単に教えてもらえますか?

AI専門家

そうだね。「コスト関数」は、AIの学習において、AIが出した答えがどれだけ正解から離れているかを測るものだよ。 例えば、犬と猫を見分けるAIを作るとする。AIが猫の画像を見て「犬」と答えたとする。この時、正解とのずれが大きいよね? このずれの大きさを数値で表すのがコスト関数だよ。

AIの初心者

なるほど。ずれの大きさ…ですか。でも、そのずれを測ってどうするんですか?

AI専門家

いい質問だね。AIは、このコスト関数の値が小さくなるように、つまり、ずれが小さくなるように学習していくんだ。 コスト関数の値が小さければ小さいほど、AIの答えは正解に近づいていくんだよ。だから、コスト関数はAIの学習においてとても重要な役割を果たしているんだ。

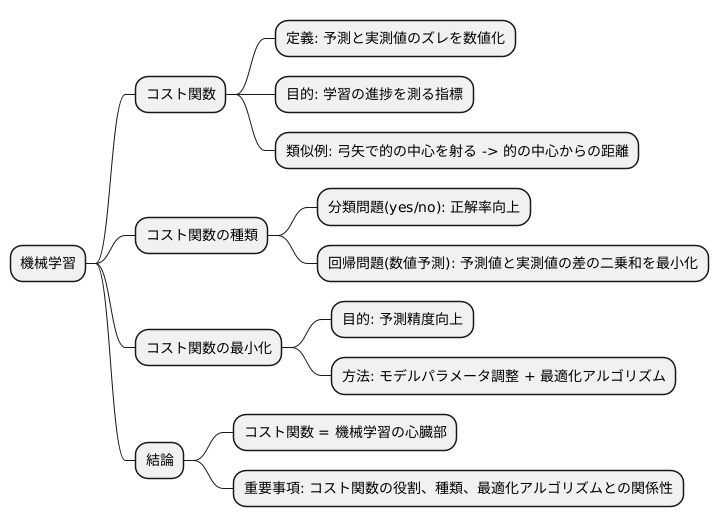

コスト関数とは。

「人工知能」の言葉である「費用関数」について説明します。費用関数は、機械学習で、どのくらい損失があるかを計算するためのものです。この損失をできるだけ小さく、あるいは大きくすることで、機械学習の模型をより良いものにします。

はじめに

機械学習は、まるで人が経験から学ぶように、与えられた情報から規則性やパターンを見つけ出す技術です。そして、その学習成果をもとに未来の予測を行います。この学習において、予測の正確さを測る重要な役割を担うのが「費用関数」です。費用関数は、モデルが算出した予測値と、実際に観測された値との間の差を数値化します。この差が小さければ小さいほど、モデルの予測精度が高いことを示します。

例えるなら、弓矢で的を射ることを想像してみてください。的の中心に当てられれば、予測が完璧だったことを意味します。しかし、中心から外れてしまうと、そのずれの大きさが費用関数によって数値化されます。中心から大きく外れた場合、費用関数の値は大きくなり、逆に中心に近いほど値は小さくなります。

機械学習の目的は、この費用関数を最小化することです。費用関数が最小になれば、モデルの予測値と実際の値とのずれが最も小さくなり、精度の高い予測が可能になります。ちょうど、弓矢で何度も練習を重ね、的に当たるように技術を磨いていく過程に似ています。

費用関数の最小化は、様々な計算手法を用いて行われます。これらの手法は、山を下るように、費用関数の値が最も小さくなる場所を探し出します。そして、その場所に辿り着いた時、モデルは最適な状態となり、最も精度の高い予測を行うことができるようになります。つまり、費用関数は、機械学習モデルの精度向上に欠かせない重要な指標と言えるでしょう。

コスト関数の役割

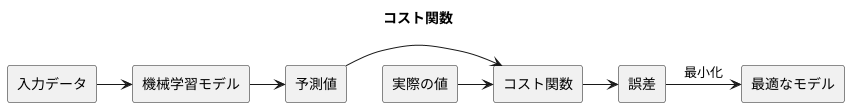

機械学習において、予測モデルの良し悪しを測るための重要な役割を担うのが、コスト関数です。この関数は、モデルがどれくらい正確に予測できているかを数値で示す指標であり、モデルの学習において中心的な役割を果たします。

モデルは、入力データに基づいて予測値を出力します。しかし、この予測値は必ずしも実際の値と完全に一致するとは限りません。この予測値と実際の値とのずれ、つまり誤差を定量化するのがコスト関数の役割です。

コスト関数は、この誤差を計算し、一つの数値として出力します。この数値が小さいほど、モデルの予測は実際の値に近い、つまり予測精度が高いことを意味します。逆に、数値が大きい場合は、予測と実際の値のずれが大きく、予測精度が低いことを示しています。

コスト関数の値を最小にする、あるいは場合によっては最大にすることで、最適なモデルを作り出すことができます。例えば、住宅価格を予測するモデルを考えてみましょう。このモデルは、家の広さや築年数などの入力データから住宅価格を予測します。コスト関数は、予測価格と実際の販売価格との差を計算し、その差が小さいほど良いモデルと判断されます。

最適なモデルを見つけるためには、様々なモデルを試行し、それぞれのコスト関数の値を比較する必要があります。そして、コスト関数の値が最も小さくなる、つまり誤差が最も小さくなるモデルが、最も精度の高いモデルとして選ばれます。このように、コスト関数は、機械学習モデルの精度を評価し、最適なモデルを選択するための重要な指標となるのです。

様々な種類のコスト関数

機械学習モデルの訓練には、モデルの予測と実際の値との間の誤差を測る指標であるコスト関数が不可欠です。様々な種類のコスト関数が存在し、それぞれ異なる特性を持つため、扱う問題の種類やデータの特性に合わせて適切に選択する必要があります。

回帰問題、つまり連続した数値を予測する問題では、平均二乗誤差がよく使われます。これは、予測値と実際の値の差を二乗し、その平均を計算することで得られます。二乗することで、大きな誤差を持つデータの影響がより強く反映されます。例えば、住宅価格の予測などで用いられます。この方法は計算が比較的簡単で、誤差が正規分布に従う場合に最適な推定量となります。

一方、分類問題、例えば画像認識やスパムメール判定のように、データをいくつかの種類に分類する問題では、クロスエントロピー誤差がよく使われます。これは、予測された確率分布と実際の確率分布との間の差を測る指標です。例えば、画像が猫である確率を予測する場合、実際の値は猫である場合は1、そうでない場合は0となります。この時、予測確率が実際の値に近いほど、クロスエントロピー誤差は小さくなります。複数の選択肢から一つを選ぶ多クラス分類問題にも対応可能です。

その他にも、特定の問題に特化したコスト関数が存在します。例えば、ヒンジ損失はサポートベクターマシンと呼ばれる分類アルゴリズムでよく用いられます。また、絶対値誤差は平均二乗誤差と同様に回帰問題で使われ、外れ値の影響を受けにくいという特徴があります。

適切なコスト関数を選ぶことは、モデルの精度向上に大きく貢献します。そのため、各コスト関数の特性を理解し、問題に合わせて最適なものを選択する必要があるのです。

| コスト関数 | 問題の種類 | 説明 | 例 | 特徴 |

|---|---|---|---|---|

| 平均二乗誤差 | 回帰 | 予測値と実際の値の差を二乗し、その平均を計算。 | 住宅価格の予測 | 計算が簡単、誤差が正規分布に従う場合に最適 |

| クロスエントロピー誤差 | 分類 | 予測された確率分布と実際の確率分布との間の差を測る。 | 画像認識、スパムメール判定 | 多クラス分類問題にも対応可能 |

| ヒンジ損失 | 分類 | サポートベクターマシンでよく用いられる。 | – | – |

| 絶対値誤差 | 回帰 | 平均二乗誤差と同様に使用、外れ値の影響を受けにくい。 | – | 外れ値の影響を受けにくい |

最適化アルゴリズムとの関係

値を最小にするための手順を定めたものが最適化計算手順です。この最適化計算手順と、良し悪しを数値で表すための関数である費用関数は、切っても切れない関係にあります。費用関数の値を最小にする、あるいは最大にするという目的を達成するために、最適化計算手順を用いるからです。

費用関数の値を山の高さに例えると、最適化計算手順は、山の頂上や谷底を探すための道案内のようなものです。谷底を探す場合、つまり費用関数を最小にする場合によく使われる道案内の一つに、勾配降下法というものがあります。勾配降下法は、現在地から見て最も急な下り坂の方向へ少し進むことを繰り返すことで、最終的に谷底にたどり着くことを目指します。この「最も急な下り坂」は、費用関数の勾配によって示されます。勾配とは、各地点での傾きを表す数値です。

勾配降下法には、いくつかの種類があります。例えば、確率的勾配降下法は、全てのデータを使うのではなく、無作為に選んだ一部のデータだけを使って勾配を計算し、計算の手間を減らす方法です。

どの最適化計算手順を選ぶかは、費用関数と同様に、解きたい問題の種類やデータの性質によって大きく変わってきます。例えば、谷が一つしかない滑らかな山であれば、単純な勾配降下法でもうまく谷底にたどり着けます。しかし、谷が複数ある複雑な山や、でこぼこした山の場合、より高度な最適化計算手順が必要になります。最適な手順を選ぶためには、問題の特徴を良く理解し、様々な計算手順を試してみる必要があります。適切な費用関数と最適化計算手順を選ぶことは、目的を達成するための鍵となります。

| 用語 | 説明 | 関連事項 |

|---|---|---|

| 最適化計算手順 | 値を最小にするための手順。費用関数の値を最小化/最大化するために用いる。 | 費用関数、勾配降下法、確率的勾配降下法 |

| 費用関数 | 良し悪しを数値で表す関数。 | 最適化計算手順、勾配 |

| 勾配降下法 | 費用関数を最小にするための最適化計算手順の一つ。現在地から見て最も急な下り坂の方向へ少し進むことを繰り返す。 | 費用関数、勾配、確率的勾配降下法 |

| 勾配 | 各地点での傾きを表す数値。勾配降下法で利用される。 | 費用関数、勾配降下法 |

| 確率的勾配降下法 | 勾配降下法の一種。無作為に選んだ一部のデータだけを使って勾配を計算する。 | 勾配降下法 |

コスト関数の選択方法

機械学習の模型を作る上で、結果の良し悪しを測るための計算方法、つまり費用関数の選び方はとても大切です。費用関数をうまく選べば、模型の働きを良くすることができます。では、どのように費用関数を選べば良いのでしょうか?いくつか大切な点があります。

まず、どんな問題を解きたいのかを考える必要があります。例えば、数値を予測する問題と、物事を分類する問題では、適した費用関数が違います。数値を予測する問題、つまり回帰問題では、予測値と実際の値のずれを測る方法がいくつかあります。よく使われるのは、ずれの二乗の平均を計算する方法や、ずれの絶対値の平均を計算する方法です。一方、物事を分類する問題、つまり分類問題では、どれくらい正確に分類できたかを測る方法を使います。例えば、交差エントロピー誤差やヒンジ損失といった計算方法があります。

次に、データの特徴も重要な要素です。もしデータの中に極端に大きい値や小さい値、つまり外れ値がたくさんある場合は、それらの値に影響されにくい費用関数を選ぶ必要があります。そうでないと、模型が外れ値に引っ張られてしまい、正しい予測ができなくなってしまいます。外れ値の影響を受けにくい費用関数としては、例えば、フバー損失というものがあります。

最後に、模型の複雑さも考慮する必要があります。複雑な模型には、より高度な費用関数が適している場合があります。

このように、問題の種類、データの特徴、模型の複雑さなどを総合的に考えて、状況に合った費用関数を選ぶことで、より正確な予測ができる模型を作ることができます。費用関数の選び方は、模型作りにおいて重要な一歩と言えるでしょう。

| 考慮すべき点 | 詳細 | 例 |

|---|---|---|

| 問題の種類 | 数値を予測する問題(回帰問題)と物事を分類する問題(分類問題)では、適した費用関数が異なる。 |

|

| データの特徴 | 外れ値が多い場合は、外れ値に影響されにくい費用関数を選ぶ必要がある。 | フバー損失 |

| モデルの複雑さ | 複雑なモデルには、より高度な費用関数が適している場合がある。 | (具体的な例は本文にないため省略) |

まとめ

機械学習は、まるで人間の学習のように、データからパターンや法則を学び取る技術です。この学習プロセスにおいて、「どのくらい学習がうまく進んでいるか」を測るための重要な指標となるのが「コスト関数」です。コスト関数は、現在の予測と実際の値との間のズレを数値で表す関数です。このズレが小さければ小さいほど、学習はうまく進んでいると判断できます。

例えるなら、弓矢で的の中心を射ることを想像してみてください。的の中心から矢がどれだけ離れているかを測る尺度がコスト関数に相当します。中心に近いほど、つまりコスト関数の値が小さいほど、良い結果と言えるでしょう。

機械学習では、様々な種類の問題に対応するために、多様なコスト関数が存在します。例えば、yes/noを予測する分類問題では、正解率を上げるための特有のコスト関数が用いられます。また、数値を予測する回帰問題では、予測値と実測値の差の二乗和を最小化するといった方法が用いられます。このように、扱う問題の種類に応じて適切なコスト関数を選択することが重要です。

コスト関数の値を最小化することで、予測精度を向上させることができます。そのため、学習過程では、このコスト関数の値を最小にするようにモデルのパラメータを調整していきます。この調整は、まるで山の斜面を下っていくように、少しずつ最適な値へと近づいていくイメージです。この最適な値を見つけるための手法を「最適化アルゴリズム」と呼びます。

最適なコスト関数と最適化アルゴリズムを選択することで、高性能な機械学習モデルを構築することが可能になります。言い換えれば、コスト関数は機械学習の心臓部と言えるでしょう。機械学習を深く理解するためには、コスト関数の役割、種類、そして最適化アルゴリズムとの関係性を理解することが不可欠です。