AIの透明性:その重要性とは?

AIの初心者

先生、「AIの透明性」って、AIの中身が透けて見えるってことですか?どんな感じで見えるんでしょうか?

AI専門家

良い質問ですね。まさに、中身が見えるってことです。たとえば、AIがどうやって結論を出したのか、その根拠や手順が誰にでも分かる状態ですね。ガラスの箱に例えると、中にある歯車や部品の動き、繋がりが見え、全体の仕組みが理解できるようなイメージです。

AIの初心者

なるほど。では、例えば、おすすめの商品を教えてくれるAIの場合、透明性があるとどうなるんですか?

AI専門家

その場合、なぜその商品をおすすめしたのか、例えば「過去の購入履歴」や「商品の評価」など、根拠となるデータや、そのデータをどのように使ったのかといった判断の過程が分かるようになります。だから、ただおすすめされるだけでなく、納得して商品を選べるようになるんですよ。

透明性とは。

人工知能について、よく使われる言葉に『透明性』というものがあります。一般的には、ガラス箱の中身がすけて見えるように、物事の中身がはっきりとわかることを指します。人工知能や機械学習でも同じ意味で使われます。つまり、機械学習の過程全体や、それぞれの段階の内容が、誰にとってもわかりやすい状態のことを『透明性』と言います。

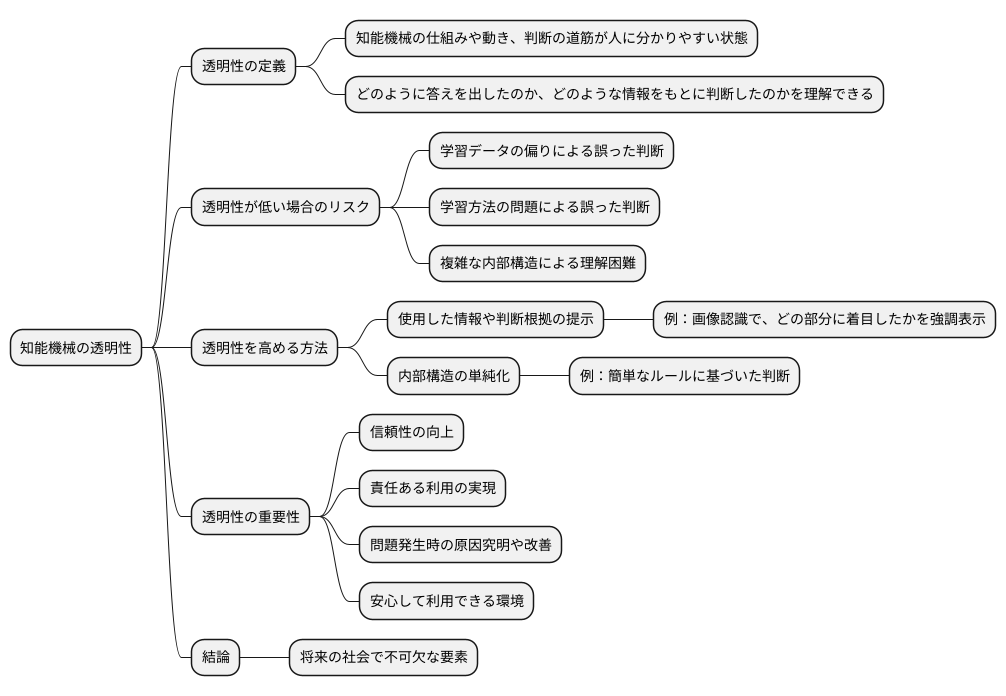

透明性の定義

人工知能(以下、知能機械という)の『透明性』とは、知能機械の仕組みや動き、判断の道筋が人に分かりやすいように示されている状態のことです。これは、まるで透き通った箱の中身を見るように、知能機械がどのように答えを出したのか、どのような情報をもとに判断したのかをはっきりと理解できることを意味します。

知能機械の仕組みは様々ですが、多くの場合、大量の情報を学習することで特定の課題をこなす能力を獲得します。例えば、画像認識を行う知能機械は、膨大な画像データとそれに対応するラベル(例えば「猫」「犬」など)を学習することで、新しい画像に何が写っているかを判断できるようになります。しかし、学習データが偏っていたり、学習方法に問題があったりすると、知能機械は誤った判断をする可能性があります。また、知能機械の内部構造が複雑な場合、たとえ正しい判断をしたとしても、なぜその判断に至ったのかを人間が理解することは困難です。

知能機械の透明性を高めるためには、いくつかの方法があります。一つは、知能機械が使用した情報や判断の根拠を人に分かりやすく提示することです。例えば、画像認識の知能機械であれば、どの部分に着目して「猫」と判断したのかを画像上で強調表示するなどが考えられます。もう一つは、知能機械の内部構造を単純化し、その動作原理を理解しやすくすることです。複雑な計算式ではなく、簡単なルールに基づいて判断する知能機械であれば、人間がその判断過程を理解しやすくなります。

知能機械の技術は日々進歩しており、その仕組みはますます複雑になっています。だからこそ、知能機械の透明性を確保することは、その信頼性を高め、責任ある利用を実現するために非常に重要です。透明性のある知能機械は、人が安心して利用できるだけでなく、問題が発生した場合の原因究明や改善にも役立ちます。将来、様々な場面で知能機械が活用される社会において、透明性はなくてはならない要素となるでしょう。

透明性が求められる理由

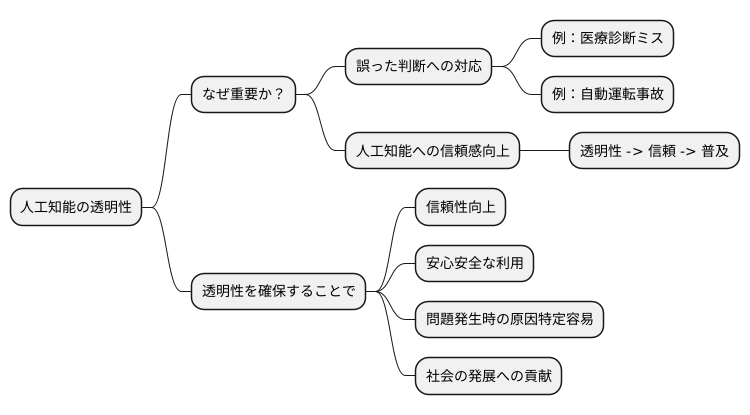

人工知能(じんこうちのう)は、近年わたしたちの暮らしの様々な場面で活用されるようになってきました。病院での診察やお金のやり取り、車の自動運転など、人間がこれまで行ってきた重要な判断を人工知能が代わりに行う機会が増えています。

このような状況において、人工知能の透明性(とうめいせい)がますます重要になっています。透明性とは、人工知能がどのような仕組みで考え、どのような理由で特定の判断を下したのかがはっきりと分かることです。もし、人工知能の判断の根拠が分からなければ、どのような問題が起こるでしょうか。

例えば、人工知能を使った医療診断で、誤った診断が下されたとします。もし、その人工知能の判断過程が分からなければ、なぜ誤りが起きたのかを理解することが難しく、同じ間違いを繰り返す可能性があります。また、自動運転中に事故が起きた場合、人工知能がなぜそのような行動をとったのかが分からなければ、責任の所在を明らかにすることが難しくなります。

さらに、人工知能の判断根拠が不透明であれば、人々は人工知能を信頼しにくくなります。信頼できない技術は、社会に広く受け入れられることは難しく、せっかくの技術の利点を活かすことができなくなってしまいます。

だからこそ、人工知能の透明性を確保することは非常に重要です。人工知能がどのように判断したのかを理解できるようにすることで、人々は人工知能を信頼し、安心して利用できるようになります。また、問題が発生した場合にも原因を特定し、改善策を講じることが容易になります。透明性によって、人工知能はより安全で信頼できる技術となり、社会の発展に大きく貢献することが期待されます。

透明性確保の課題

人工知能、とりわけ深層学習といった複雑な手順を踏む仕組みは、その内部構造が非常に込み入っており、専門家でも理解が難しい場合があります。これは、人工知能の透明性を保つ上で大きな問題となっています。

膨大な量の資料から学習する人工知能は、人が理解できない複雑な模様を見分け、判断を下すことがあります。例えば、画像認識の人工知能が、特定の写真を「猫」と判断したとしても、なぜその写真が「猫」と判断されたのか、その詳しい理由を人が理解できる言葉で説明することは簡単ではありません。人工知能は、数多くの資料から統計的な繋がりを学習しますが、その繋がりは、必ずしも人が理解できる論理に基づいているとは限りません。まるで、直感で判断しているように見えることもあります。

人工知能の判断理由がわからないと、どんな問題が生じるでしょうか?例えば、病気の診断支援を行う人工知能が、誤った判断を下した場合、その原因がわからなければ、改善策を見つけることが難しくなります。また、ローン審査を行う人工知能が、特定の人物への融資を不当に拒否した場合、その理由がわからなければ、公正な審査が行われているかを確認できません。

さらに、人工知能の仕組みを明かすことには、企業の機密や知的財産権の保護といった側面からの難しさもあります。人工知能の開発には多大な費用と時間がかかっており、その成果は企業にとって重要な資産です。そのため、人工知能の内部構造をすべて公開してしまうと、他社に模倣されたり、不正利用されたりするリスクがあります。このような理由から、人工知能の透明性確保と企業秘密の保護の間で、適切なバランスを見つけることが求められています。人工知能技術の発展と共に、どのように透明性を高め、社会全体の理解と信頼を得ていくのか、引き続き議論と工夫が必要です。

| 問題点 | 具体例 | 影響 |

|---|---|---|

| AIの判断理由の不透明性 | 画像認識AIがなぜ「猫」と判断したのか説明が難しい |

|

| 透明性確保と企業秘密保護の両立の難しさ | AIの内部構造公開による模倣・不正利用のリスク | AI技術の発展と社会の理解・信頼獲得のために議論と工夫が必要 |

透明性を高めるための取り組み

人工知能の判断がどのように行われているかを明らかにすることは、信頼性を高める上で欠かせません。そのため、様々な角度からの取り組みが必要です。まず挙げられるのは、人工知能の思考過程を人間が理解できる言葉で説明できるようにする技術、いわゆる「説明できる人工知能」の開発です。この技術は現在盛んに研究開発が行われており、将来的には人工知能がなぜそのような結論を出したかを明確に示すことが可能になると期待されています。

また、人工知能を作る過程全体で透明性を意識することも重要です。情報の集め方、計算方法の選び方、正しさの測り方など、あらゆる段階で判断の理由を明らかにしていくことで、信頼できる人工知能を作ることができます。それぞれの段階での選択が、最終的な結果にどう影響するかを理解できるようにすることで、問題点の発見や改善もしやすくなります。

さらに、人工知能に関する道徳的な指針や法的な整備も必要不可欠です。透明性に関する明確な基準を設けることで、人工知能を作る人や使う人の責任を明確にし、健全な発展を促すことができます。ルールがはっきりしていれば、開発者は責任ある行動を取りやすくなり、利用者は安心して人工知能を使うことができます。これらの取り組みが相まって、初めて人々に受け入れられる、信頼できる人工知能が実現すると言えるでしょう。

| 取り組み | 内容 | 期待される効果 |

|---|---|---|

| 説明できるAIの開発 | AIの思考過程を人間が理解できる言葉で説明できるようにする技術の開発 | AIがなぜそのような結論を出したかを明確に示すことが可能になる |

| AI作成過程の透明化 | 情報の集め方、計算方法の選び方、正しさの測り方など、あらゆる段階で判断の理由を明らかにする | 信頼できるAIを作成、問題点の発見や改善 |

| 道徳的指針・法的整備 | 透明性に関する明確な基準を設ける | AIを作る人や使う人の責任を明確にし、健全な発展を促す |

今後の展望

人工知能技術は、まるで生き物のように日々進化を続け、私たちの生活の様々な場面で使われるようになってきています。これから、人工知能は社会にとってなくてはならないものになっていくと考えられます。それと同時に、人工知能がどのように考え、どのように答えを出しているのかを明らかにすること、つまり透明性を確保することが、これまで以上に大切になってきます。

人工知能がどのように判断を下したのかを説明できる人工知能、いわゆる説明可能な人工知能の開発は、透明性を高めるための重要な取り組みです。人間にも分かりやすい説明ができる人工知能ならば、安心して利用することができます。また、人工知能を倫理的に正しく使うための議論も、より活発に行われる必要があります。人工知能は便利な道具ですが、使い方を間違えると社会に悪影響を与える可能性も秘めているからです。どのような人工知能を開発し、どのように活用していくべきなのか、社会全体で考えていく必要があります。

人工知能の透明性を高めるためには、私たち一人ひとりの理解と協力が欠かせません。人工知能がどのように動いているのか、その仕組みを知ることで、私たちは人工知能を正しく使うことができます。また、透明性の重要性を認識することで、人工知能に関する議論にも積極的に参加できるようになります。人工知能と人間が共に生きる社会を実現するためには、人工知能に関する教育や情報提供を充実させ、社会全体の理解を深めていくことが重要です。子供から大人まで、誰もが人工知能について学ぶ機会を持つことで、人工知能をより良い形で活用できる社会を作っていけると考えられます。

| テーマ | 要点 |

|---|---|

| AIの進化と透明性 | AIは進化を続け、社会に不可欠になりつつある。AIの透明性を確保することが重要。 |

| 説明可能なAI | 説明可能なAIの開発は透明性を高めるための重要な取り組み。安心して利用でき、倫理的な議論も活発になる。 |

| AIと倫理 | AIは使い方を間違えると悪影響を与える可能性があるため、社会全体で開発と活用について考える必要がある。 |

| AIの理解と協力 | AIの透明性を高めるには、一人ひとりの理解と協力が必要。仕組みを知ることで正しく使えるようになる。 |

| AI教育の重要性 | AIと人間が共に生きる社会を実現するには、教育や情報提供を充実させ、社会全体の理解を深めることが重要。 |

まとめ

人工知能(じんこうちのう)の透明性(とうめいせい)とは、人工知能システムの内部構造(ないぶこうぞう)や意思決定(いしけってい)の過程(かてい)を人が理解(りかい)できる状態(じょうたい)のことを指します。人工知能が、どのように判断(はんだん)を下したのか、なぜそのような結果(けっか)に至ったのかが、分かるということです。まるで、ガラスのように中身が分かりやすい状態を想像してみてください。

近年、人工知能は私たちの生活の様々な場面で活用(かつよう)され始めています。例えば、病気の診断(しんだん)や、車の自動運転(じどううんてん)、商品の推薦(すいせん)などです。人工知能が社会の重要な役割(やくわり)を担うようになるにつれて、その判断過程(はんだんかてい)を人が理解できること、つまり透明性を確保(かくほ)することは、ますます重要になってきています。

もし、人工知能がどのように判断したのか分からなければ、私たちは人工知能の判断を信頼(しんらい)することができません。例えば、車の自動運転中に事故が起きた時、なぜ人工知能がその判断をしたのか分からなければ、事故の原因(げんいん)を特定(とくてい)することが難しく、再発防止(さいはつぼうし)にも繋がらないでしょう。また、人工知能が不公平(ふこうへい)な判断を下したとしても、その理由(りゆう)が分からなければ、是正(ぜせい)することができません。

透明性を高めるためには、人工知能の内部構造や意思決定過程を分かりやすく説明(せつめい)できる技術(ぎじゅつ)の開発(かいはつ)が必要です。同時に、人工知能の倫理的(りんりてき)な側面(そくめん)についても、議論(ぎろん)を深めていく必要があります。人工知能が私たちの社会にとって有益(ゆうえき)な存在であり続けるためには、人工知能と人間が互いに理解(おたがいにりかい)し合い、共存(きょうぞん)していく社会を築いていかなければなりません。そのためにも、人工知能の透明性は、今後ますます重要なキーワードとなるでしょう。

| 人工知能の透明性とは | AIシステムの内部構造や意思決定の過程を人が理解できる状態 |

|---|---|

| 重要性 | AIの判断の信頼性確保、事故原因の特定、不公平な判断の是正、AIと人間の共存 |

| 実現のための課題 |

|

| 具体的な例 | 病気の診断、車の自動運転、商品の推薦など |