共変量シフトとは?機械学習で起こるデータ分布のズレを解説

AIの初心者

「共変量シフト」ってなんですか?名前が難しくて、どんな問題なのかつかめません。

AI専門家

簡単に言うと、AIを学習させたときのデータと、実際に使うときのデータの出方が変わってしまうことだよ。たとえば晴れた昼間の猫写真ばかりで学習したモデルを、夜や雨の日の写真に使うと、猫を見落としやすくなることがある。これが共変量シフトが問題になる典型例だね。

AIの初心者

つまり、学習データと実際のデータにズレがあると、AIの予測が外れやすくなるんですね。どうしてそんなズレが起こるんですか?

AI専門家

原因はいくつもあるよ。時間がたって流行や利用者の行動が変わることもあるし、データを集める場所、機器、方法が変わることもある。モデルを作ったときの世界と、モデルを使うときの世界が同じとは限らない、という点が大事なんだ。

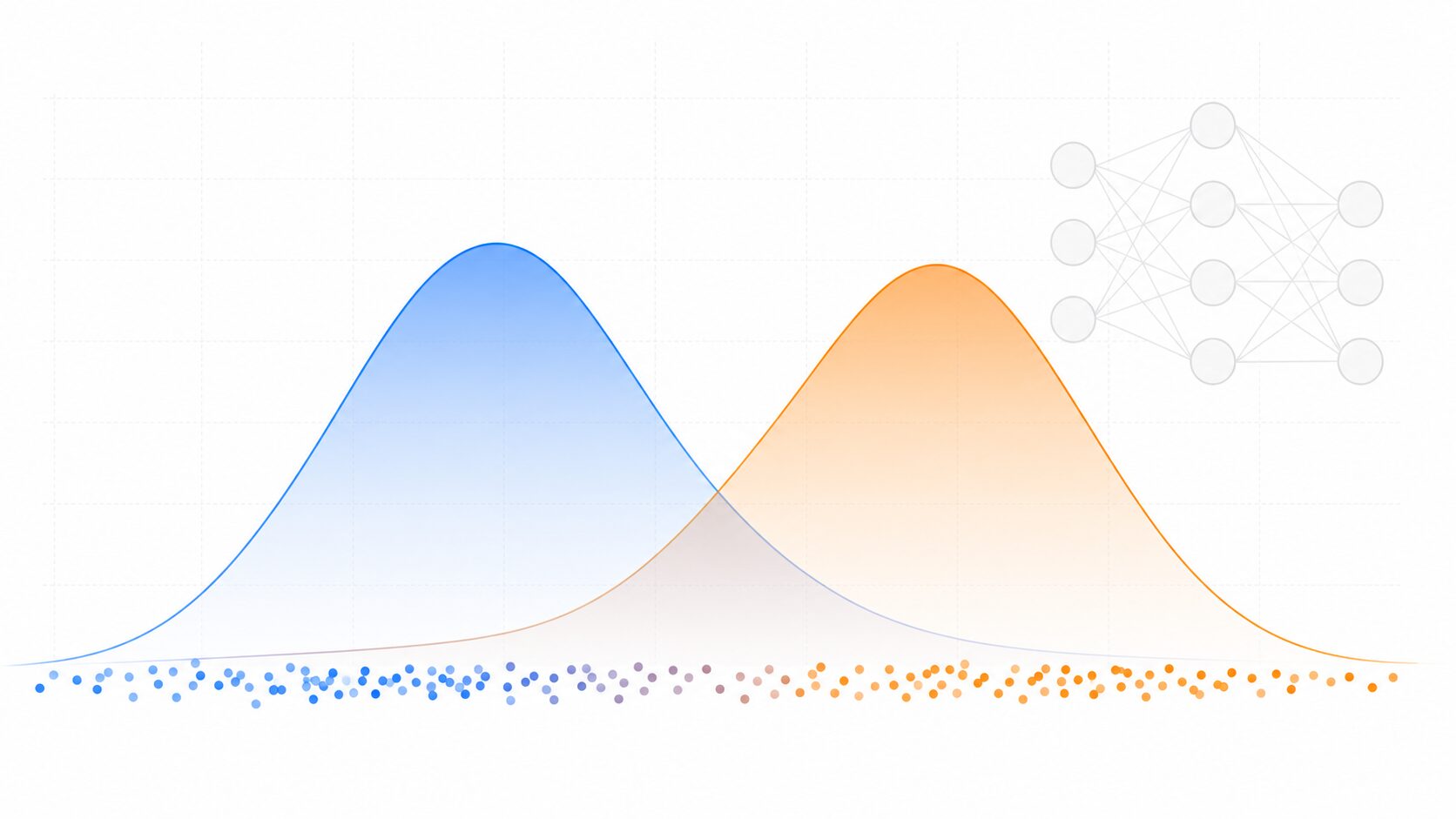

共変量シフトとは。

共変量シフトは、機械学習モデルの精度が運用中に下がる原因としてよく取り上げられる現象です。学習時と予測時で入力データの分布が変わるため、過去のデータではうまく動いていたモデルが、現実のデータでは期待通りに働かないことがあります。似た言葉にデータドリフトや概念ドリフトがあり、違いを整理しておくと対策を考えやすくなります。

共変量シフトの基本

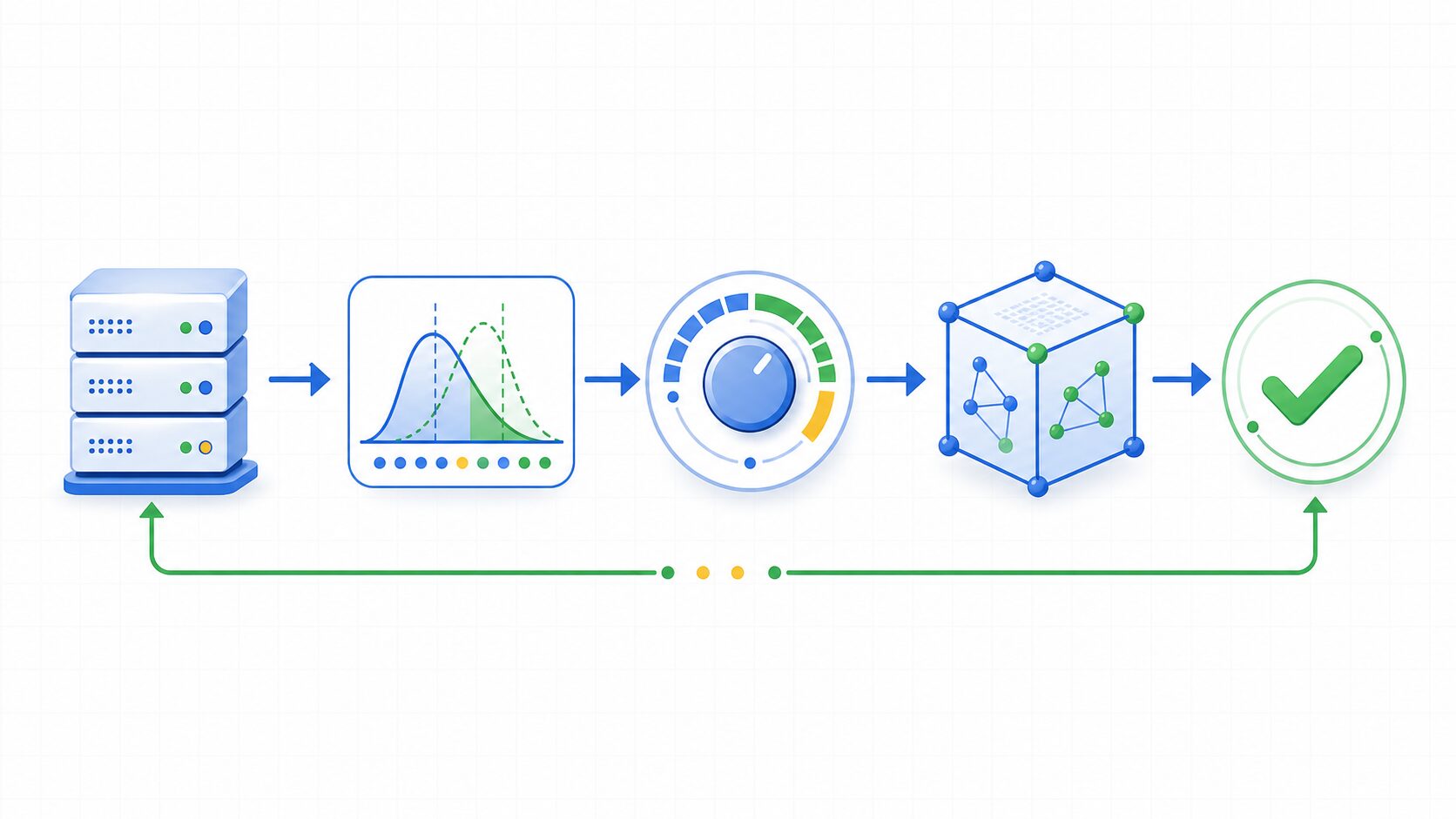

共変量シフトとは、機械学習モデルを学習したときの入力データと、実際に予測するときの入力データで、データの現れ方が変わっている状態を指します。ここでいう入力データは、画像の明るさ、商品の価格、顧客の年齢、センサー値、検査値など、モデルが予測に使う特徴量のことです。

機械学習モデルは、学習データに含まれるパターンをもとに予測します。そのため、学習データと運用データが似ていれば、学習した知識を活かしやすくなります。反対に、学習時にはほとんど見なかったタイプのデータが運用時に増えると、モデルは判断に迷いやすくなります。

たとえば、商品の売れ行きを予測するモデルを過去の販売データで作ったとします。学習データには、その時点の景気、流行、価格帯、顧客層が反映されています。しかし、予測したい現在では景気が悪化し、人気の商品カテゴリも変わっているかもしれません。このとき、入力となる購買履歴や顧客属性の分布が変化しており、過去の傾向だけでは現在の売れ行きを捉えにくくなります。

重要なのは、共変量シフトが単なる「データが少ない問題」ではないことです。データ量が多くても、学習データが運用時の状況を代表していなければ、モデルの予測精度は下がります。モデルの性能を見るときは、学習時のスコアだけでなく、実際に使う環境のデータとどれだけ近いかも確認する必要があります。

なぜ共変量シフトが起こるのか

共変量シフトは、現実世界が変化することで起こります。機械学習では、学習データが将来のデータをよく表しているという前提を置きがちですが、実運用ではこの前提が崩れることが珍しくありません。

一つ目の原因は、時間の経過です。ファッション、検索行動、購買傾向、金融市場、医療現場の検査傾向などは、時間とともに変わります。去年の流行を反映したデータで学習した推薦モデルが、今年の流行をうまく扱えないことは十分にあり得ます。

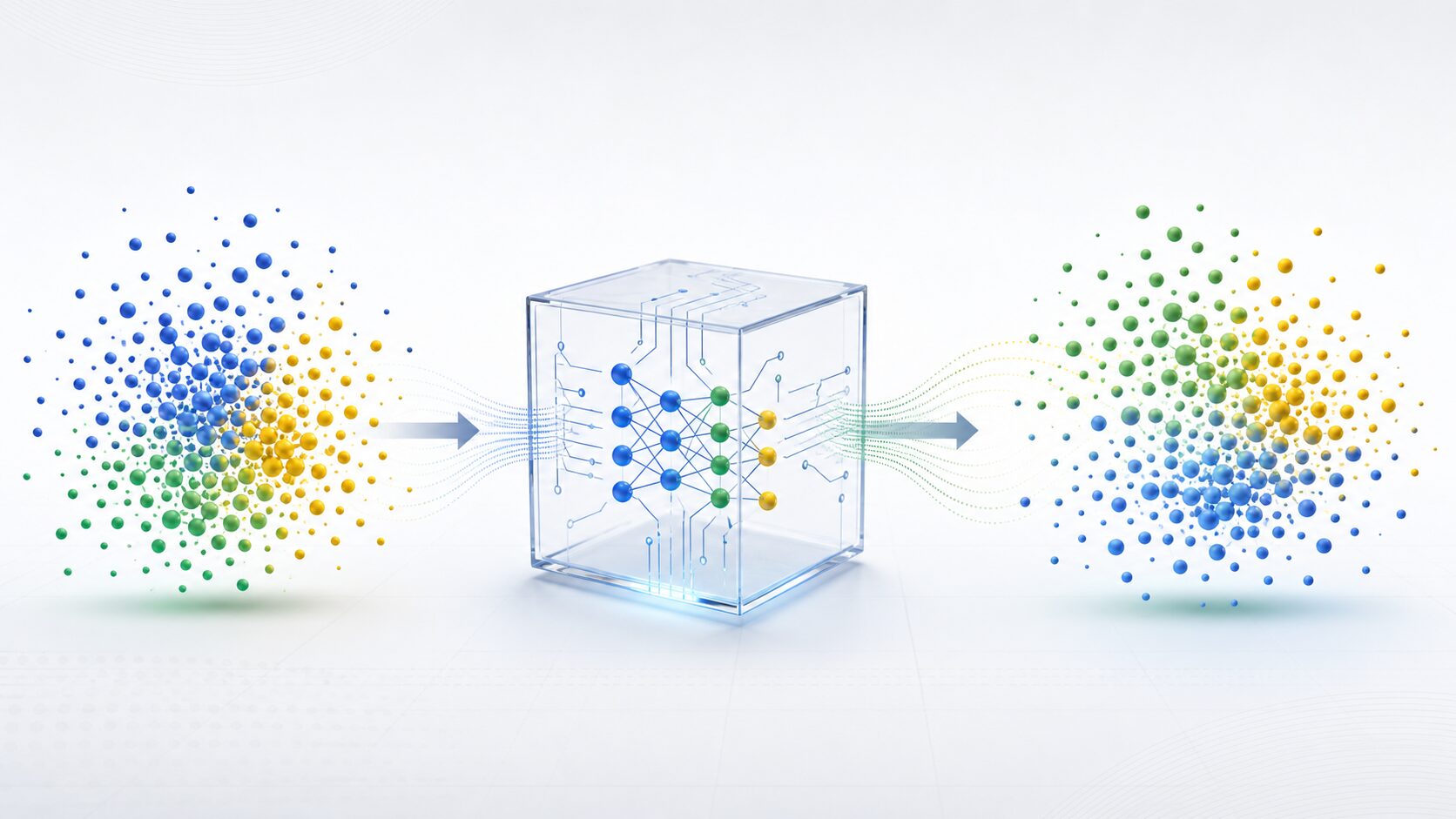

二つ目の原因は、データ収集条件の変化です。センサーの交換、カメラの解像度変更、アンケート対象者の変更、ログ取得方法の変更などがあると、入力データの分布が変わります。工場の外観検査では、照明や材料ロット、製造装置が変わるだけでも、画像に写る欠陥の見え方が変化します。

三つ目の原因は、利用環境の違いです。ある地域の患者データで学習した診断支援モデルを別の地域や病院で使うと、年齢構成、生活習慣、検査機器、検査値の分布が異なる場合があります。天気予測モデルや自動運転モデルでも、地域、季節、道路環境、天候が違えば、学習時とは異なるデータが入力されます。

このような変化は、一度に大きく起こることもあれば、少しずつ進むこともあります。後者は気づきにくいため、モデルを公開したあともデータの状態を継続的に見ることが大切です。

データドリフト・概念ドリフトとの違い

共変量シフトを理解するときは、関連する言葉との違いを整理しておくと混乱しにくくなります。特に、データドリフトと概念ドリフトは一緒に出てくることが多い用語です。

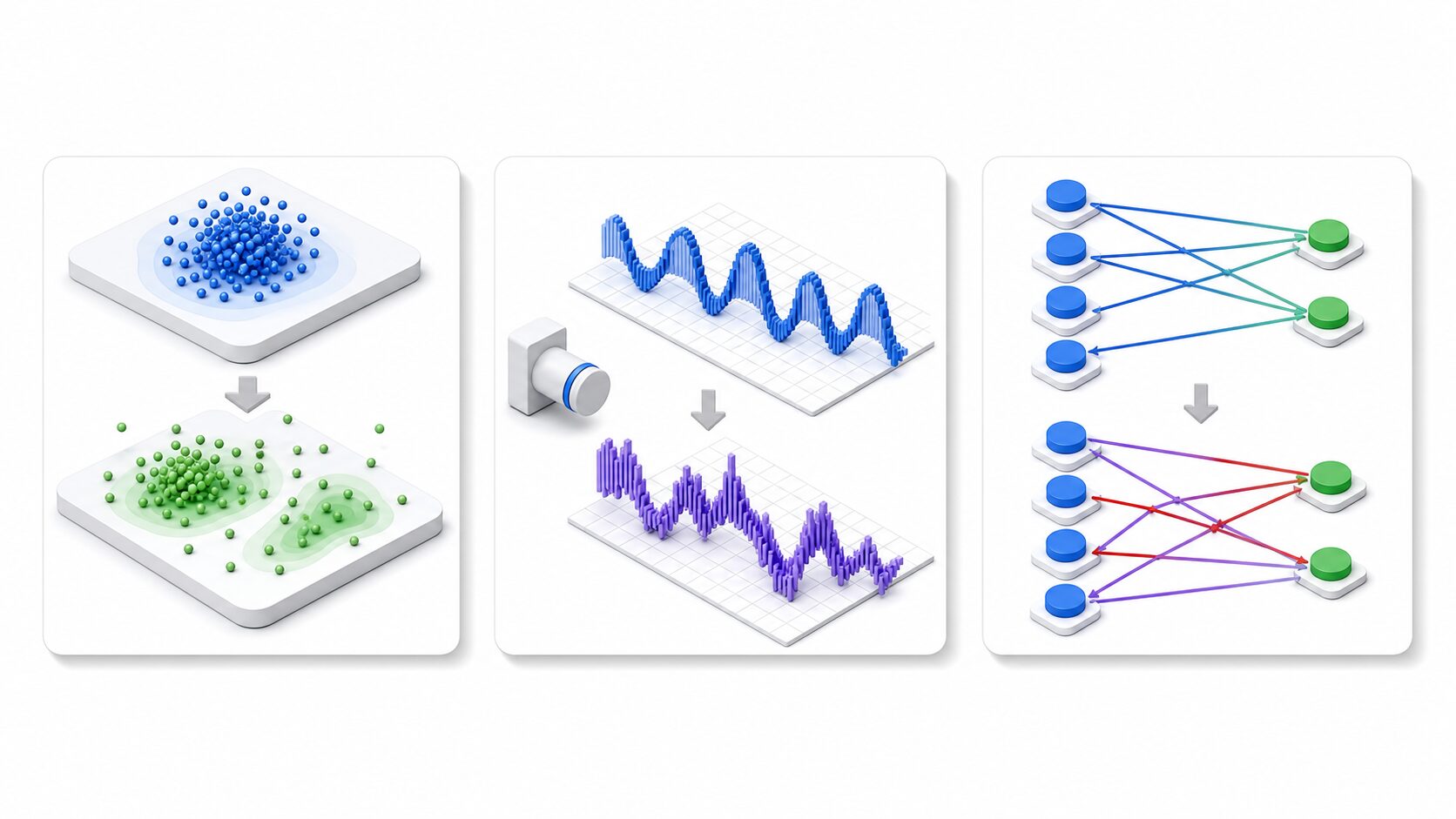

データドリフトは、入力データの分布が変化する現象を広く指します。共変量シフトも、入力分布の変化に注目する点ではデータドリフトに近い考え方です。文脈によっては、共変量シフトをデータドリフトの一種として扱うこともあります。

一方、概念ドリフトは、入力と正解の関係そのものが変わる現象です。たとえば、以前は「低価格」が購入につながりやすかった商品カテゴリで、ブランド価値や環境配慮が重視されるようになると、同じ価格や特徴量でも購入されるかどうかの関係が変わります。この場合は入力データの分布だけでなく、予測すべきルールも変化しています。

| 用語 | 注目する変化 | 例 | 対策の考え方 |

|---|---|---|---|

| 共変量シフト | 学習時と運用時で入力データの分布が変わる | 昼間の画像で学習したモデルを夜間画像に使う | 運用データに近い学習、重み付け、領域適応を検討する |

| データドリフト | 入力データや取得データの傾向が変わる | センサー交換で計測値の分布が変わる | 統計量や分布を監視し、異常な変化を検知する |

| 概念ドリフト | 入力と正解の関係が変わる | 消費者の価値観が変わり購買理由が変化する | モデル再学習、特徴量見直し、ルール変更を行う |

実務では、これらが同時に起こることもあります。購買行動が変われば入力データの分布も変わり、同時に「何が購入につながるか」という関係も変わる可能性があります。そのため、原因を一つに決めつけず、入力データ、正解データ、モデル性能を合わせて確認する姿勢が重要です。

共変量シフトがモデルに与える影響

共変量シフトの直接的な影響は、モデルの予測精度が下がることです。ただし、問題は精度低下だけではありません。予測結果への信頼が下がり、業務判断や安全性にも影響することがあります。

医療診断支援の例では、学習データに含まれていた患者層と、実際に利用する病院の患者層が異なる場合があります。年齢、生活習慣、検査機器、検査値の分布が変わると、モデルは本来の性能を発揮できず、見落としや過剰判定につながる恐れがあります。

金融市場の予測でも、過去の相場環境で学習したモデルが、政策変更、金利変動、世界情勢、新しい技術トレンドに直面すると、過去の規則性をそのまま使えないことがあります。市場データは変化が速いため、共変量シフトを無視すると損失リスクが高まります。

製造工程では、設備の経年変化、原材料のロット違い、カメラや照明の変更によって、検査画像の見え方が変わります。モデルが古い条件の画像に最適化されていると、新しい条件では不良品を見逃したり、正常品を不良と判定したりする可能性があります。

自動運転や監視カメラのように安全性が関わる分野では、天候、時間帯、道路環境、カメラ特性の違いが判断ミスにつながる場合があります。共変量シフトへの対策は、単なる精度改善ではなく、安定した運用のためのリスク管理でもあります。

共変量シフトを検知する考え方

共変量シフトに対応するには、まず変化が起きているかを検知する必要があります。検知の基本は、学習時のデータと運用時のデータを比べることです。平均値、分散、欠損率、カテゴリの比率、外れ値の割合などを継続的に確認すると、入力データの変化に気づきやすくなります。

画像やテキストなど高次元のデータでは、単純な平均だけでは変化を捉えにくいことがあります。その場合は、モデルの中間特徴量、埋め込み表現、予測確率の分布などを見る方法もあります。たとえば、予測の確信度が急に低くなったり、特定のクラスへの偏りが増えたりした場合は、入力データの性質が変わっている可能性があります。

もう一つ重要なのは、モデル性能の監視です。正解ラベルが後から得られる業務では、精度、再現率、適合率、誤検知率などを定期的に確認します。入力分布の変化が小さく見えても、業務上重要なデータ範囲で性能が落ちていることがあるためです。

ただし、分布の変化が見つかったからといって、すぐにモデルを作り直せばよいとは限りません。変化が一時的なものか、継続的なものか、予測結果に実際の影響が出ているかを確認してから対応を選びます。

共変量シフトへの主な対策

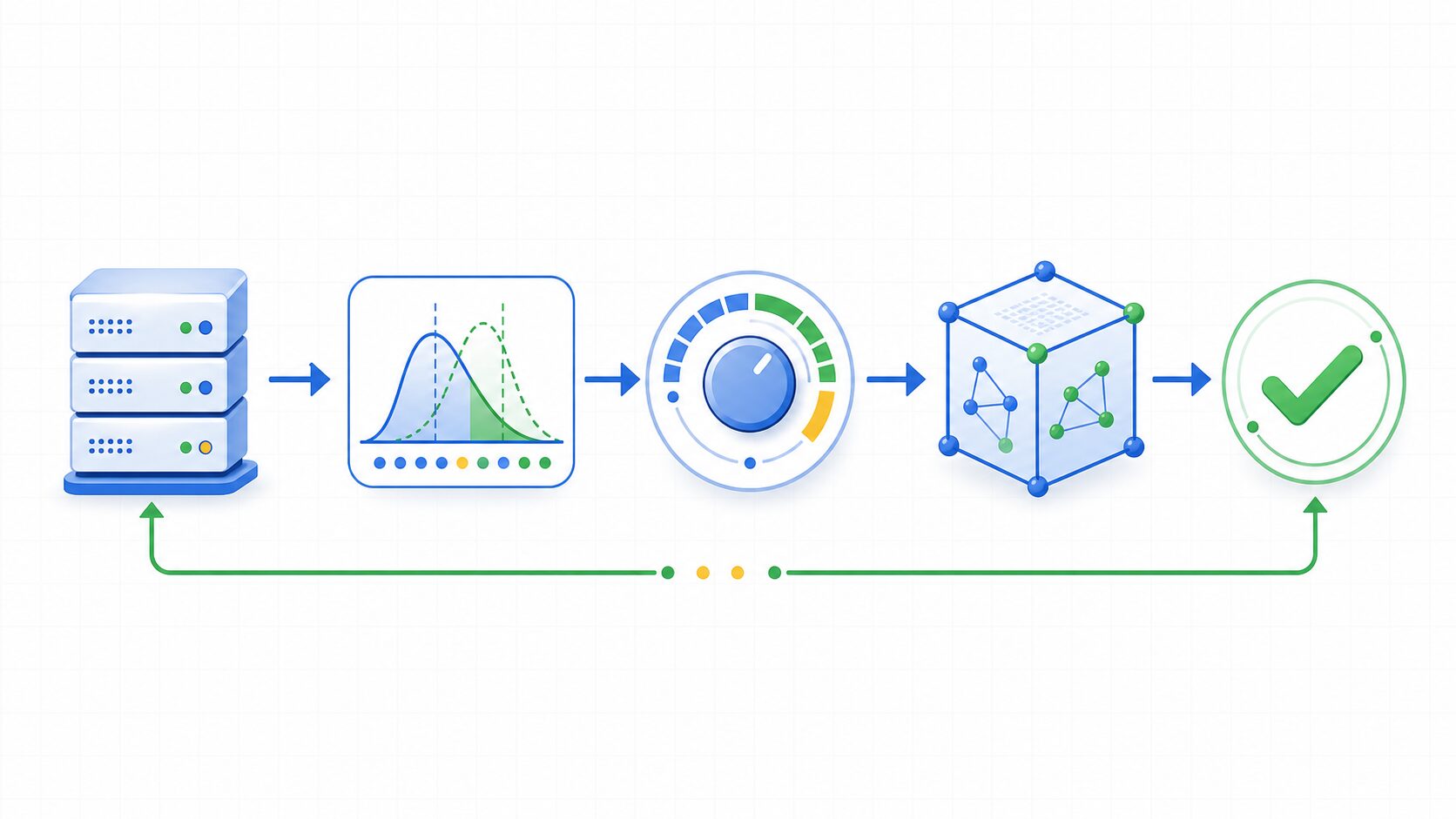

共変量シフトへの対策は、大きく分けると「学習データを運用データに近づける」「モデルを変化に追随させる」「運用中に監視する」の三つです。どれか一つだけで解決するより、状況に応じて組み合わせることが多くなります。

重要度重み付けは、運用データに近い学習データを重く扱い、運用データから遠い学習データを軽く扱う方法です。たとえば、現在の顧客層に近い過去データの影響を強めることで、モデルを現在の状況に近づけます。データを捨てずに調整できる点が利点ですが、重みの推定が不安定だと逆に性能が下がることもあります。

領域適応は、学習データと運用データの分布が近くなるように特徴量や表現を変換する考え方です。ある環境で集めた画像モデルを別の環境へ使いたい場合などに検討されます。学習元と利用先のデータがどの程度似ているか、正解ラベルがどれだけ手に入るかによって手法の選び方が変わります。

再学習は、新しいデータを追加してモデルを作り直す方法です。時間とともに分布が変わる業務では有効ですが、新しいデータの品質確認が欠かせません。誤ったラベルや偏ったデータをそのまま入れると、モデルが現在の問題をさらに学習してしまう可能性があります。

オンライン学習は、データが届くたびに少しずつモデルを更新する方法です。変化に素早く追随できる一方で、短期的なノイズにも反応しやすいため、更新条件や監視ルールを慎重に設計する必要があります。

アンサンブルは、複数のモデルを組み合わせて予測を安定させる方法です。異なる時期や条件で学習したモデルを使い分けることで、一つのモデルに依存するリスクを下げられます。ただし、運用や説明が複雑になりやすい点には注意が必要です。

初心者が押さえたい注意点

共変量シフトを学ぶときにまず押さえたいのは、モデルの精度低下をモデル構造だけの問題と決めつけないことです。学習時に高精度だったモデルが運用で外れる場合、データの集め方や利用環境が変わっている可能性があります。

次に、学習データと運用データを同じ基準で比較することが大切です。学習データでは欠損値を除外していたのに、運用データでは欠損値が多いまま入力されている、といった前処理の違いでも分布は変わります。モデルの前にあるデータ処理の流れも確認しましょう。

また、共変量シフトと概念ドリフトを混同しないことも重要です。入力データの出方が変わっただけなら、重み付けや領域適応で改善できる場合があります。一方で、入力と正解の関係が変わっているなら、特徴量や目的変数、業務ルールの見直しが必要になることがあります。

最後に、対策は一度入れて終わりではありません。機械学習モデルは作って公開した瞬間から、現実世界の変化にさらされます。データ分布、予測結果、正解データ、業務上の影響を継続的に確認する仕組みが、安定したAI活用につながります。

まとめ

共変量シフトは、学習データと運用データで入力データの分布が変わり、機械学習モデルの性能が低下する現象です。時間の経過、データ収集方法の変更、利用環境の違い、センサーや設備の変化など、実務ではさまざまな理由で発生します。

似た概念としてデータドリフトや概念ドリフトがあります。共変量シフトは入力分布のズレに注目し、概念ドリフトは入力と正解の関係の変化に注目します。原因によって有効な対策が変わるため、言葉の違いを理解しておくことが大切です。

対策としては、入力データの監視、重要度重み付け、領域適応、再学習、オンライン学習、アンサンブルなどがあります。どの方法を選ぶ場合でも、学習時の評価だけで安心せず、実際に使うデータとモデル性能を継続的に確認することが、機械学習モデルを信頼して運用するための基本になります。

更新履歴

| 日付 | 内容 |

|---|---|

| 2025年1月31日 | 初回公開 |

| 2026年5月10日 | 関連ドリフトとの違いと運用時の監視観点を追記 |