AMSBoundとは?学習率を上下限で制御する最適化手法

AIの初心者

「AMSBound」は、AMSGradの学習率に上限と下限をつける手法ですよね。なぜ、わざわざ範囲を決める必要があるのですか?

AI専門家

ポイントは、学習率が大きすぎても小さすぎても学習がうまく進みにくいことだよ。Adamは初期の学習が速い一方で、条件によっては最後に安定しないことがあり、その改善策としてAMSGradが考えられたんだ。

AIの初心者

AMSGradだけでは足りない場合がある、ということですか?

AI専門家

そうだね。AMSGradは学習率が大きくなりすぎる問題を抑えやすい一方で、学習率が小さくなりすぎると更新が進みにくくなることがある。AMSBoundは上限と下限を設けて、有効な学習率を適切な範囲に保とうとする手法なんだ。

AMSBoundとは。

AMSBoundは、深層学習で使われる最適化手法の一つです。読み方は「エーエムエスバウンド」または、AMSGradとの関係を明確にして「エーエムエスグラッドバウンド」と説明されることがあります。

機械学習では、モデルの誤差が小さくなるようにパラメータを少しずつ更新します。この一回あたりの更新幅を左右する重要な値が「学習率」です。

AMSBoundは、AMSGradを土台にして、学習率が極端に大きくなったり小さくなったりしないように、動的な上限と下限を設定します。

つまり、Adamのような初期学習の速さと、AMSGradの安定性を生かしながら、学習率の範囲を制御して学習の停滞や不安定さを抑えることを目指す手法です。

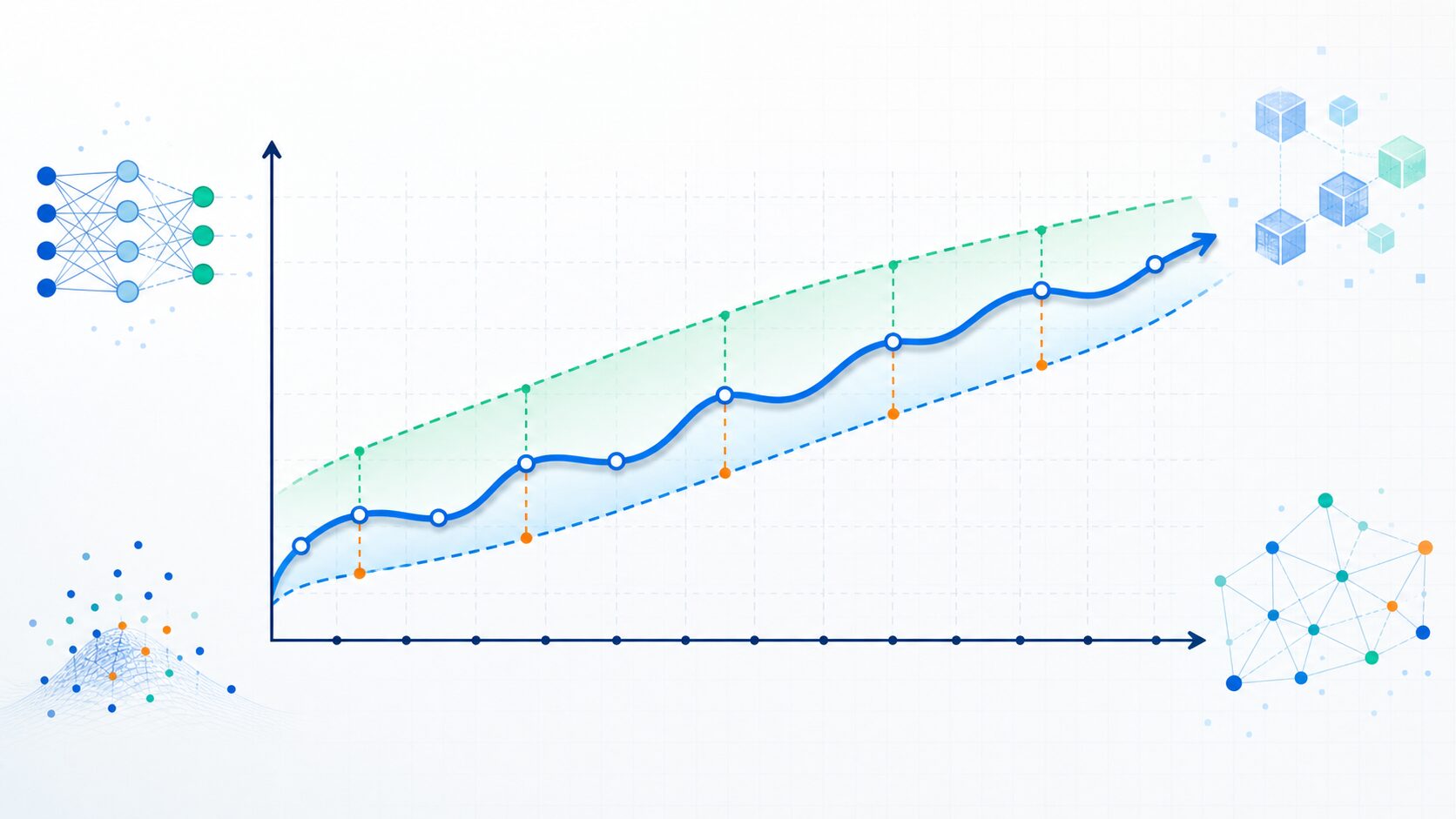

AMSBoundが必要になった背景

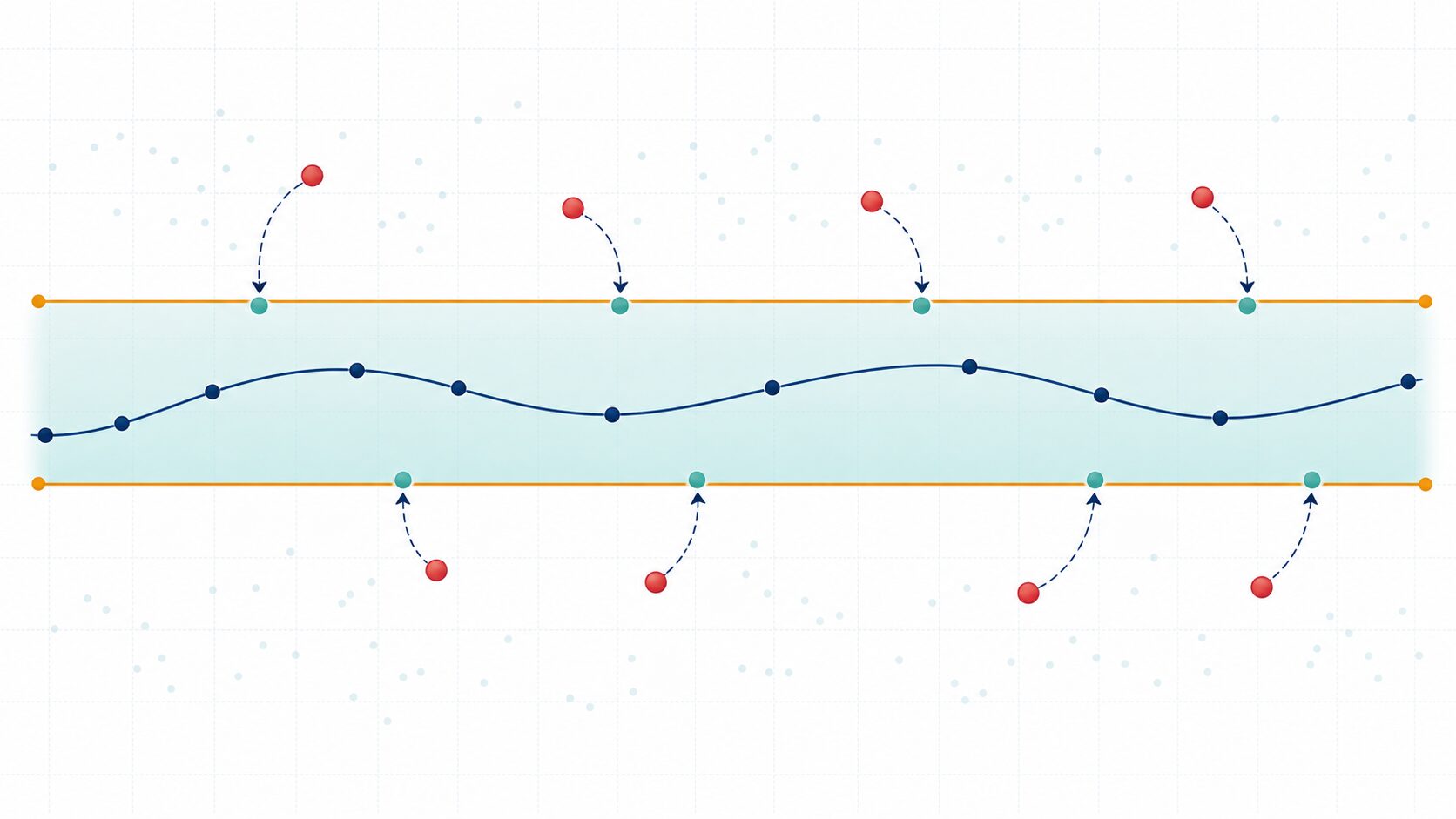

AMSBoundを理解するには、まず学習率の役割を押さえる必要があります。学習率は、モデルの重みを一度にどれくらい動かすかを決める値です。大きすぎると最適な地点を飛び越えて振動したり、発散したりします。小さすぎると更新がほとんど進まず、学習に時間がかかったり、十分な精度に届かなかったりします。

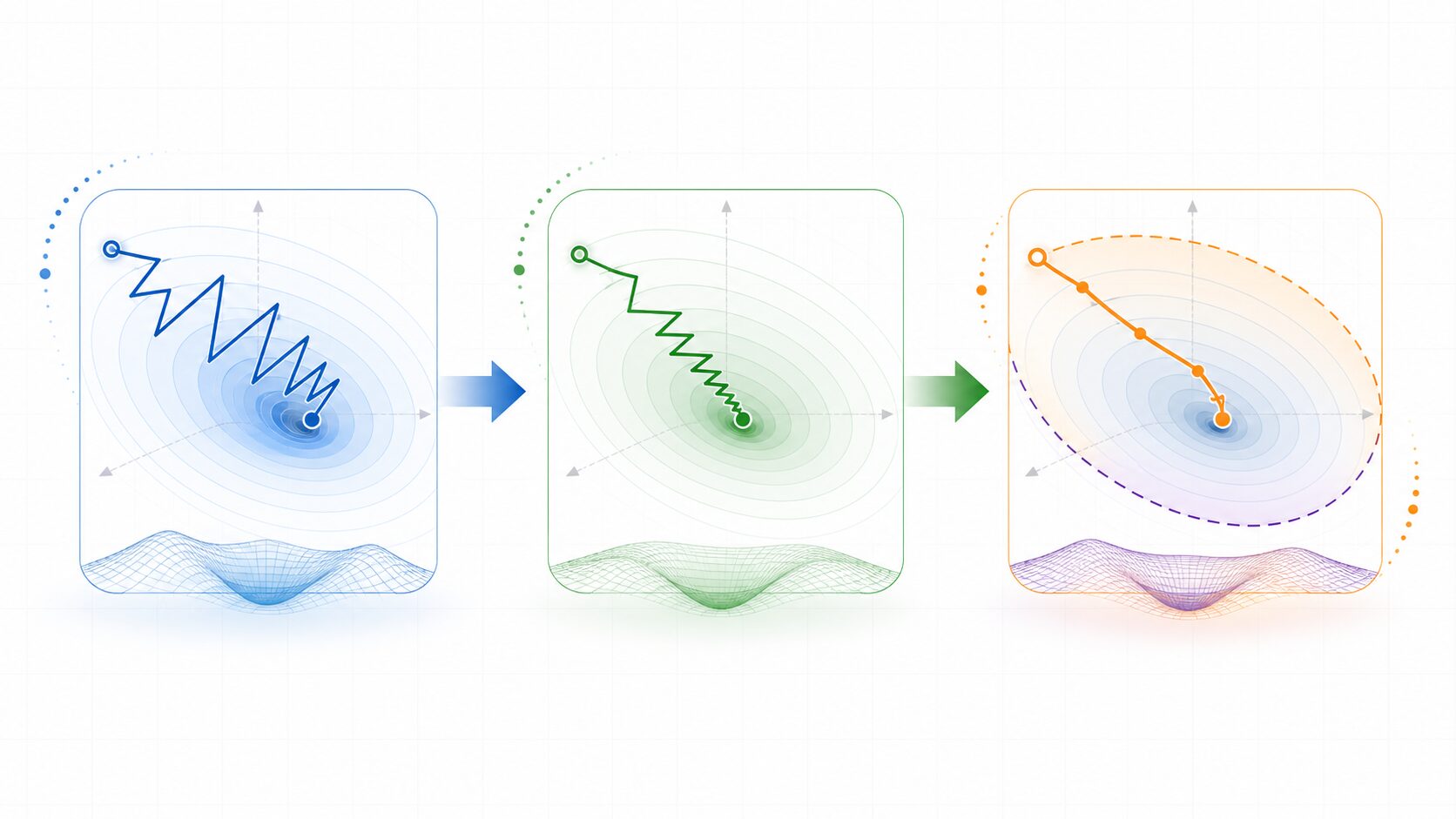

Adamは、勾配の平均的な向きと大きさを使って学習率を自動調整する代表的な最適化手法です。学習初期に素早く改善しやすいため広く使われてきましたが、条件によっては最終的な収束が安定しないという課題が指摘されました。

そこで登場したのがAMSGradです。AMSGradは、Adamの二次モーメント推定に最大値を使うことで、有効学習率が不適切に大きくなることを抑え、より安定した収束を狙います。ただし、場合によっては学習率が小さくなりすぎ、更新が鈍くなる問題が残ります。

AMSBoundはこの流れを受けて、AMSGradの学習率に下限と上限の境界を設けます。下限は学習率が小さくなりすぎる停滞を防ぎ、上限は大きすぎる更新による不安定さを抑えるためのものです。

AMSBoundの仕組み

AMSBoundの基本的な考え方は、AMSGradで計算した有効学習率をそのまま使うのではなく、あらかじめ決めた範囲に収めることです。この操作は、値を範囲内に切り詰める「クリッピング」と考えると分かりやすくなります。

数式で表すと、AMSBoundでは有効学習率を下限と上限の間に収めます。

\(\eta_t^\mathrm{bound}=\mathrm{clip}\left(\frac{\alpha}{\sqrt{\hat{v}_t}+\epsilon},\ l_t,\ u_t\right)

\)

ここで、\alphaは基準となる学習率、\hat{v}_tはAMSGradで使う勾配二乗の最大値に基づく推定量、\epsilonはゼロ除算を避けるための小さな値です。l_tは時点tでの下限、u_tは上限を表します。

重要なのは、上下限が固定値とは限らない点です。学習の初期段階ではある程度広い範囲を許し、学習が進むにつれて適切な範囲へ近づけるように設計できます。これにより、初期には探索しやすく、後期には安定しやすい挙動を目指します。

初心者向けに言えば、AMSBoundは「アクセルを踏みすぎない」「ブレーキをかけすぎない」ための制御を、学習率に加えた手法です。学習率が極端な値になることを避けるため、モデルの更新が急に暴れたり、反対にほとんど動かなくなったりするリスクを下げます。

Adam・AMSGrad・AMSBoundの違い

Adam、AMSGrad、AMSBoundはすべて、勾配情報を使って学習を進める最適化手法です。ただし、学習率をどのように扱うかが異なります。

| 手法 | 主な特徴 | 利点 | 注意点 |

|---|---|---|---|

| Adam | 勾配の一次モーメントと二次モーメントを使って更新幅を調整する | 学習初期に速く改善しやすい | 条件によっては最終的な収束が不安定になることがある |

| AMSGrad | 二次モーメント推定の最大値を保持して有効学習率を抑える | Adamより安定した収束を狙いやすい | 学習率が小さくなりすぎると更新が停滞しやすい |

| AMSBound | AMSGradの有効学習率に動的な下限と上限を設ける | 大きすぎる更新と小さすぎる更新の両方を抑えやすい | 境界の設計やタスクとの相性を検証する必要がある |

この違いを整理すると、Adamは「速く進む」ことに強みがあり、AMSGradは「不安定さを抑える」方向へ改善した手法です。AMSBoundはさらに、学習率が小さすぎる場合にも目を向け、適切な範囲に学習率を保つことを狙います。

AdaBoundとの違い

AdaBoundとAMSBoundは、どちらも学習率に境界を設ける発想を持つ手法です。そのため名前も似ていますが、基礎にしている最適化手法が異なります。

AdaBoundはAdamをベースにし、学習が進むにつれてSGDに近い挙動へ移ることを狙います。初期にはAdamのように素早く探索し、後期にはSGDのように安定して収束するイメージです。

一方、AMSBoundはAMSGradをベースにします。AMSGradが持つ安定性を生かしつつ、学習率が小さくなりすぎる問題を上下限で補う点が特徴です。

| 項目 | AdaBound | AMSBound |

|---|---|---|

| 基礎となる手法 | Adam | AMSGrad |

| 主な狙い | Adamの速さとSGDの収束性を両立する | AMSGradの安定性に学習率境界を加える |

| 学習率制御 | Adamの有効学習率に上下限を設ける | AMSGradの有効学習率に上下限を設ける |

| イメージ | 広く探索してから安定した更新へ寄せる | 安定性を保ちながら極端な学習率を避ける |

AMSBoundの利点

AMSBoundの利点は、学習率の極端な変化を抑えやすいことです。上限があるため、勾配の変化によって更新幅が急に大きくなるリスクを抑えられます。下限があるため、更新幅が小さくなりすぎて学習が進まない状態も避けやすくなります。

また、AMSGradを土台にしているため、Adamの収束性に関する課題を意識した設計になっています。Adamの初期学習の速さを完全に捨てるのではなく、安定した収束へ向かうための制御を加える発想です。

実務や学習では、最適化手法を変えるだけで検証精度や学習曲線が変わることがあります。AMSBoundは、AdamやAMSGradで学習が振動する、あるいは途中から改善が鈍くなる場合に、比較候補として検討できます。

使うときの注意点

AMSBoundは便利な考え方ですが、どのデータやモデルでも必ず最良になるわけではありません。最適化手法の効果は、モデル構造、データ量、バッチサイズ、初期学習率、正則化、学習率スケジュールなどの影響を受けます。

特に初心者が注意したいのは、精度が上がらない原因を最適化手法だけに求めないことです。データの前処理、ラベル品質、モデルの容量、過学習、評価指標の選び方なども結果に大きく関わります。

AMSBoundを試す場合は、Adam、AMSGrad、SGD、AdaBoundなどと同じ条件で比較し、訓練損失だけでなく検証データでの性能も確認するのが基本です。学習曲線を見れば、発散しているのか、停滞しているのか、過学習しているのかを判断しやすくなります。

活用が期待される分野

AMSBoundのような最適化手法は、画像認識、自然言語処理、音声認識、推薦システムなど、深層学習を使う幅広い分野で比較対象になり得ます。特に、学習が不安定になりやすいモデルや、学習率の調整が難しいタスクでは、候補の一つとして意味があります。

たとえば画像分類では、訓練の初期に素早く特徴を学びつつ、後半で精度を安定させたい場面があります。自然言語処理では、モデルが大きく、勾配の挙動が複雑になりやすいため、学習率制御が結果に影響することがあります。

ただし、近年の深層学習ではAdamWや各種スケジューラも広く使われています。AMSBoundを理解することは、単に一つの手法を覚えるだけでなく、学習率をどう制御すると学習が安定するのかを考える助けになります。

まとめ

AMSBoundは、AMSGradを土台にして学習率へ動的な上限と下限を設ける最適化手法です。Adamの速い初期学習、AMSGradの安定性、そして学習率境界による停滞・発散の抑制を組み合わせることを目指します。

初心者は、AMSBoundを「AMSGradの学習率を適切な範囲に保つ手法」と捉えると理解しやすくなります。Adam、AMSGrad、AdaBoundとの違いを比較しながら見ることで、なぜ学習率の制御が重要なのかも整理できます。

実際に使う場合は、AMSBoundだけに頼るのではなく、複数の最適化手法や学習率設定を比較し、検証データで性能を確認することが大切です。

更新履歴

| 日付 | 内容 |

|---|---|

| 2025年1月31日 | 初回公開 |

| 2026年5月1日 | AMSBoundの定義、Adam・AMSGrad・AdaBoundとの違い、学習率制御の仕組み、利点と注意点を初心者向けに再構成 |