大規模言語モデルの弱点とは?LLMが得意なこと・苦手なことをわかりやすく解説

AIの初心者

大規模言語モデルって便利ですが、苦手なこともあるのですか?

AI専門家

あります。文章を作ることは得意ですが、医療や法律の最終判断、厳密な計算、最新ニュースの確認などは注意が必要です。

AIの初心者

たくさんの文章を学習しているのに、なぜ間違えることがあるのでしょうか?

AI専門家

学習した知識には時点の限界があり、長い文脈や事実確認にも限界があります。得意な作業と弱点を分けて理解すると、安全に使いやすくなります。

大規模言語モデルの弱点とは。

大規模言語モデル(LLM)は、膨大な文章データをもとに自然な文章を生成するAIです。質問への回答、要約、翻訳、文章作成、アイデア出しなどでは高い力を発揮します。

一方で、大規模言語モデルは万能な知能ではありません。専門的な判断、最新情報の確認、長文全体の正確な理解、倫理的に慎重な出力などには弱点があります。

この記事では、大規模言語モデルが得意なことと苦手なことを分けながら、なぜ間違いが起きるのか、実務や学習でどのように使えばよいのかをわかりやすく整理します。

大規模言語モデルの弱点とは

大規模言語モデルの弱点を一言で表すと、自然な文章を作れることと、内容が正しいことは別問題だという点です。LLMは、学習データに含まれる言葉のつながりや文脈のパターンをもとに、次に来る可能性が高い表現を予測します。

そのため、説明文やメール文のように「自然な言い回し」が重要な作業では便利です。しかし、医療診断、法律判断、金融判断、研究データの解釈のように、根拠、制度、計算、責任が求められる場面では、人間の確認が欠かせません。

また、LLMは知らないことを「知らない」と返さず、もっともらしい誤情報を生成することがあります。この現象はハルシネーションと呼ばれます。初心者が使う場合は、出力の流暢さだけで信頼せず、情報源や前提条件を確認する姿勢が重要です。

そもそも大規模言語モデルが得意なこと

弱点を理解する前に、LLMが得意な作業も押さえておきましょう。大規模言語モデルは、文章の構成、言い換え、要約、翻訳、分類、質問への一般的な回答、プログラムの下書きなどを得意とします。

例えば、会議メモから議事録のたたき台を作る、難しい説明を初心者向けに言い換える、メール文を丁寧な表現に整える、複数のアイデアを比較する、といった作業では大きな助けになります。これは、過去の膨大な文章から表現パターンを学習しているためです。

ただし、得意なのは主に「言語処理」です。言葉として整えることはできても、現実世界の事実確認、最新の制度変更、個別事情に応じた判断まで自動で保証されるわけではありません。LLMは答えを完成させる機械ではなく、考える材料を広げる補助ツールとして使うと失敗を減らせます。

弱点1:専門判断や厳密な計算は間違えることがある

大規模言語モデルは、法律、医療、自然科学、会計、セキュリティなどの専門領域で、それらしい説明を作ることがあります。しかし、専門家と同じように根拠を検証し、制度や例外条件を厳密に適用しているとは限りません。

たとえば法律相談では、条文、判例、契約条件、管轄、時期によって結論が変わります。医療では、症状だけでなく検査値、既往歴、服薬状況、緊急性を含めた判断が必要です。LLMの回答は参考情報にはなっても、最終判断として扱うには危険があります。

計算についても注意が必要です。LLMは文章のパターンを扱うモデルであり、電卓や数式処理ソフトそのものではありません。簡単な計算でも途中式を取り違えることがあり、複雑な統計処理や科学計算では特に検算が必要です。

| 領域 | 起こりやすい問題 | 安全な使い方 |

|---|---|---|

| 医療 | 症状だけから断定的な説明をする | 一般情報の整理にとどめ、診断は医師に確認する |

| 法律 | 古い制度や一般論を個別案件に当てはめる | 論点整理に使い、条文や専門家確認を行う |

| 計算 | 途中式や数値をもっともらしく間違える | 電卓、表計算、専用ツールで検算する |

弱点2:最新情報はそのままでは追えない

大規模言語モデルは、基本的には学習に使われたデータの範囲で知識を持ちます。そのため、学習後に発表されたニュース、製品仕様、法律改正、価格、組織変更、研究成果については、そのままでは正しく答えられない場合があります。

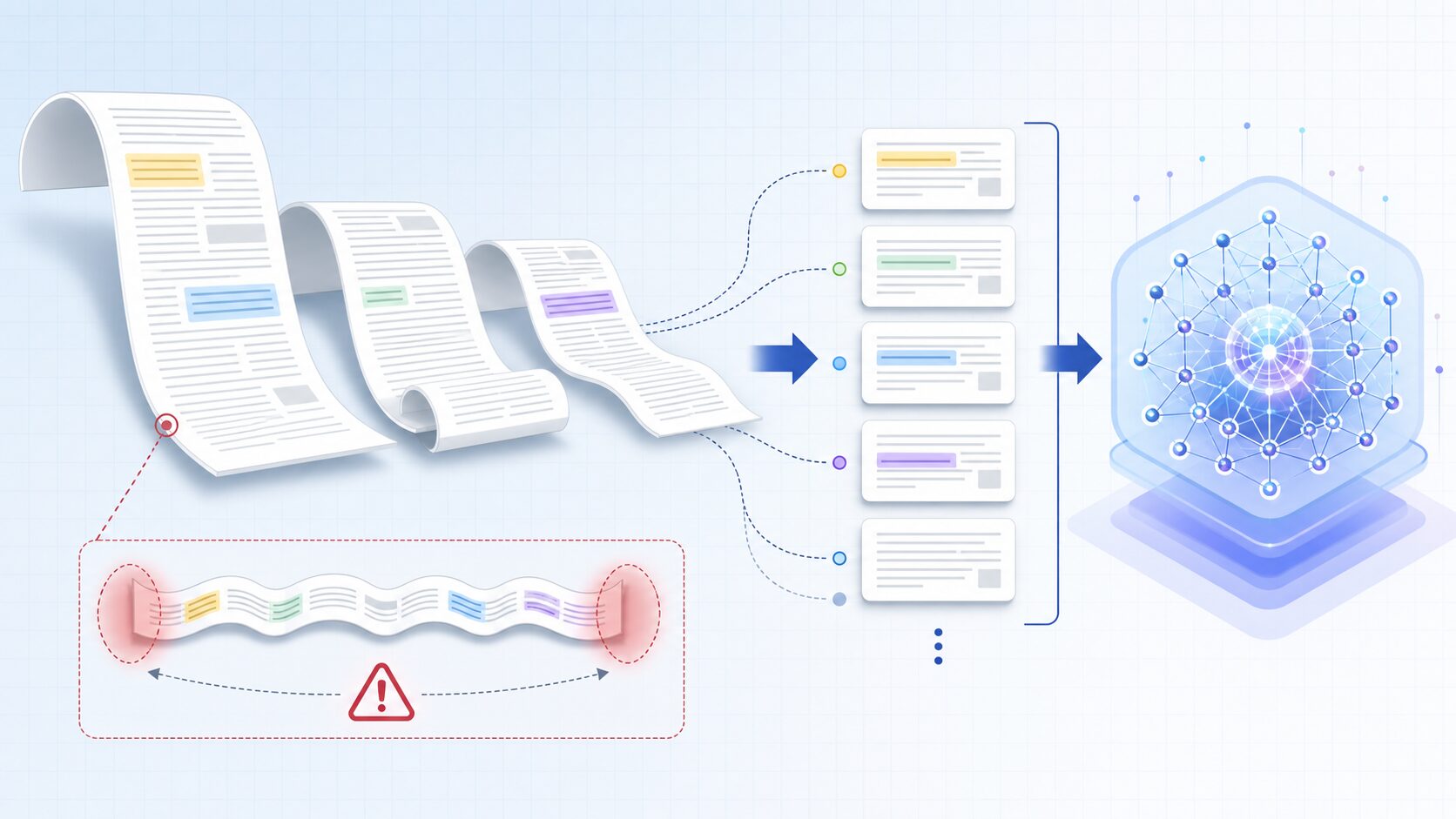

近年は、検索機能や社内データベースと接続して最新情報を参照する仕組みも広がっています。代表的な考え方にRAG(検索拡張生成)があります。これは、モデルがすべてを記憶するのではなく、必要な資料を検索してから回答を作る方法です。

ただし、検索連携がある場合でも安心しきることはできません。検索結果の選び方、引用元の信頼性、古いページの混入、情報の読み違いによって誤りは起こります。最新情報を扱うときは、回答だけでなく参照元、日付、一次情報を確認することが重要です。

弱点3:長文や複雑な文脈では取りこぼしが起きる

LLMには、一度に扱える入力と出力の量に上限があります。この上限はコンテキスト長と呼ばれます。コンテキスト長が大きいモデルでも、非常に長い契約書、議事録、論文、仕様書を丸ごと正確に理解できるとは限りません。

長い文章では、冒頭の条件、途中の例外、後半の結論が離れて存在します。モデルが重要な箇所を見落としたり、似た項目を混同したり、細かい制約をまとめすぎたりすることがあります。要約では読みやすくなる一方で、例外条件や数値の根拠が落ちることもあります。

背景には、アテンションという仕組みがあります。アテンションは文章中の語句同士の関係を計算する技術ですが、文章が長くなるほど処理は重くなり、重要度の判断も難しくなります。長文を扱うときは、文書を章ごとに分ける、質問を具体化する、出力に根拠箇所を添えさせる、といった工夫が有効です。

弱点4:偏り、誤情報、著作権などの倫理的な課題がある

大規模言語モデルは、学習データに含まれる社会的な偏りや古い価値観を反映することがあります。性別、年齢、国籍、職業、地域などについて、偏った表現や不適切な推測を生成する可能性があります。

また、実在しない出典、架空の論文、誤った引用、事実と異なる説明を作ることもあります。文章が自然であるほど、読者は誤りに気づきにくくなります。外部に公開する資料や顧客向け文書では、事実確認とレビューの工程を必ず入れるべきです。

さらに、機密情報や個人情報を入力しないことも大切です。社内資料、顧客データ、未公開の契約情報などを扱う場合は、利用しているAIサービスの規約、データ保持方針、社内ルールを確認する必要があります。著作権のある文章や画像をそのまま再利用する場合も、権利関係に注意が必要です。

実務で安全に使うためのポイント

LLMを安全に使うコツは、弱点を避けるのではなく、弱点が出る前提でワークフローを作ることです。特に、事実確認、専門家レビュー、出典確認、機密情報の扱い、公開前チェックを工程に含めると、実務で使いやすくなります。

まず、依頼内容を具体的にします。「説明して」だけでなく、対象読者、前提条件、使う目的、避けたい表現、確認してほしい観点を伝えると、出力の品質が安定します。次に、出力をそのまま採用せず、重要な主張、数値、固有名詞、法制度、日付を確認します。

社内利用では、LLMに任せてよい作業と任せてはいけない作業を分けることも有効です。下書き、要約、分類、観点出しは任せやすい一方、最終判断、顧客への断定、法的助言、医療判断、セキュリティ上の重要変更は人間が責任を持って確認する必要があります。

| 使い方 | 向いている作業 | 注意点 |

|---|---|---|

| 下書き作成 | メール、記事構成、FAQ案 | 事実や固有名詞は確認する |

| 要約 | 会議メモ、資料の概要把握 | 例外条件や数値が落ちていないか見る |

| 専門領域の補助 | 論点整理、質問案、比較表 | 結論は専門家や一次資料で確認する |

今後の展望

大規模言語モデルの弱点は、技術の進歩によって少しずつ改善されています。長い文脈を扱えるモデル、外部ツールを使って計算する仕組み、検索や社内データと連携するRAG、特定分野に合わせて調整するファインチューニングなどが発展しています。

ただし、性能が上がっても、すべてのリスクが自動的に消えるわけではありません。モデルが複雑になるほど、なぜその答えになったのかを説明しにくい場面もあります。高精度なAIを使うほど、利用者側の確認方法や責任範囲を明確にすることが重要になります。

これからのLLM活用では、AIだけで完結させるのではなく、人間、検索、データベース、計算ツール、レビュー体制を組み合わせる考え方が中心になります。大規模言語モデルの強みは文章処理の速さ、弱点は正確性や責任が必要な判断にあります。この違いを理解することが、AIを安全に使う第一歩です。

更新履歴

| 日付 | 内容 |

|---|---|

| 2025年2月1日 | 初回公開 |

| 2026年5月12日 | 弱点ごとの背景と確認フローを補い、実務利用時の判断点を追記 |