量子化で機械学習を最適化

AIの初心者

先生、「量子化」って、アナログをデジタルにすることと同じなんですか?

AI専門家

ふむ、いい質問だね。似ているところもあるけど、機械学習でいう「量子化」は少し違う意味で使われているんだ。アナログをデジタルにするのは、連続的な量を段階的な数字で表すことだね。機械学習の量子化は、既に数字で表されている情報を、もっと少ない桁数の数字で表すことを指すんだよ。

AIの初心者

つまり、32桁の数字を8桁とかで表すってことですか?でも、情報が減ってしまって、おかしくならないんですか?

AI専門家

その通り。桁数を減らすと、どうしても多少の情報は失われてしまう。だから、精度が下がることもあるんだ。しかし、計算が速くなったり、メモリの使用量が減ったりするメリットもあるから、うまく調整して使う必要があるんだよ。

量子化とは。

人工知能の用語で「量子化」というものがあります。これは、本来滑らかに変化する量を、飛び飛びの値で近似して表すことです。自然界の信号などを計算機で扱えるようにデジタルデータに変換するときなどによく使われます。しかし、機械学習で使われる量子化は少し意味合いが異なり、既に十分な精度(例えば32ビットや16ビット)で表されている数値を、もっと少ないビット数で表現することを指します。量子化には、計算速度の向上やメモリの節約といった利点があります。量子化の方法の一つとして、学習済みの模型の重みに、単純に量子化の処理を適用する方法があります。また、推論の際に、計算途中の値にも同じ処理を適用できますが、この方法だと模型の精度は落ちてしまいます。学習済みの模型を使って学習データで推論を行うと、計算途中の値の分布状況(平均やばらつき)が分かります。この情報に基づいて、適切な量子化のパラメータを設定することができます。

量子化とは

連続した量を、飛び飛びの値に変換する操作を、量子化といいます。私たちの身の回りにある自然界の現象、例えば音の大きさや光の強さ、温度などは、本来滑らかに変化しています。しかし、これらの情報をコンピュータで扱うには、連続的な値を不連続なデジタルデータに変換する必要があります。この変換こそが量子化です。

音楽をコンピュータに取り込む場合を考えてみましょう。マイクが受け取った空気の振動は、本来連続的に変化するアナログ信号です。このアナログ信号を、コンピュータが理解できるデジタルデータに変換するために量子化を行います。デジタルデータは飛び飛びの値で表現されるため、元のアナログ信号と完全に一致するわけではありません。しかし、量子化を細かく行うことで、元の信号に非常に近い形でデジタルデータとして記録することができます。こうしてデジタル化された音楽は、コンピュータで編集したり、保存したり、再生したりすることができるようになります。

機械学習の分野でも、量子化は重要な役割を果たしています。機械学習モデルは、大量のデータから学習したパターンを表現する複雑な計算式のようなものです。通常、これらのモデルは32ビットや16ビットといった高い精度で表現されます。しかし、高い精度で表現するためには多くの計算資源が必要となります。そこで、量子化を用いてモデルをより少ないビット数、例えば8ビットや4ビットで表現することで、計算資源の消費を抑えることができます。 量子化によって、計算速度が向上し、必要な記憶容量も削減できます。これは、処理能力や記憶容量が限られているスマートフォンや家電製品などに機械学習モデルを搭載する際に非常に有効です。このように、量子化は、様々な分野でデジタル化を支えるとともに、限られた資源を有効活用するための重要な技術となっています。

| 分野 | 量子化の目的 | 量子化の効果 |

|---|---|---|

| 音楽のデジタル化 | コンピュータが処理できるよう、連続的なアナログ信号を不連続なデジタルデータに変換するため | 音楽の編集、保存、再生が可能になる |

| 機械学習 | モデルの表現に必要な計算資源を削減するため | 計算速度の向上、必要な記憶容量の削減 |

量子化の利点

計算を速くし、記憶する情報量を減らすことは、量子化の大きな強みです。 量子化は、数値を少ない桁数で表す手法です。例えるなら、細かい目盛りのついた定規から、大まかな目盛りの定規に変えるようなものです。目盛りが減っても、だいたいの長さは測れますよね。同様に、量子化によって数値の精度を少し落とすことで、大きなメリットが生まれます。

まず、計算に使う情報量が減るため、計算速度が格段に上がります。 多くの計算を必要とする機械学習の分野では、この高速化は非常に重要です。膨大なデータを扱う際に、処理時間を短縮できれば、より迅速な分析や予測が可能になります。

次に、記憶装置に必要な容量も減らせます。 これは、限られた記憶容量しかない携帯端末や小型機器にとって大きな利点です。例えば、高性能な画像認識の機能を、小さな機器に搭載できるようになります。

量子化による省電力化も大きなメリットです。 消費電力が減るため、電池の持ちが長くなります。これは、携帯端末だけでなく、電気自動車やドローンなど、電池で動く機器にとって非常に重要です。

近年、機械学習はますます複雑になり、必要な計算量も増えています。 このため、計算に時間がかかり、多くの電力を消費する点が課題となっています。量子化は、これらの問題を解決する有力な方法の一つです。少ない桁数で表すという、一見単純な工夫が、機械学習の進化を支える重要な役割を果たしているのです。

| 量子化のメリット | 詳細 |

|---|---|

| 計算速度の向上 | 情報量が減るため、計算が速くなる。機械学習の高速化に貢献。 |

| 記憶容量の削減 | 少ない容量でデータを保存できる。携帯端末や小型機器に最適。 |

| 省電力化 | 消費電力が減り、電池持ちが向上。携帯端末、電気自動車、ドローンなどに有効。 |

量子化の種類

様々な種類がある量子化について、代表的な手法をいくつか紹介します。

まず、学習を終えた模型の重みに対して、量子化という操作を直接行う方法があります。模型を作る学習は、沢山の計算を経て完了します。この学習を終えた模型には、重みと呼ばれる数値が多数含まれています。これらの重みは、通常、多くの桁数を持つ数値で表現されています。量子化では、これらの重みをより少ない桁数で表現できるように変換します。例えば、元の重みが3.14159265…のような細かい数値であった場合、これを3.14のような簡略な数値に変換します。このように、重みを簡略化することで、模型の保存に必要な記憶容量を減らし、計算速度を向上させることができます。

次に、推論を行う際に、活性化関数というものを量子化する手法があります。推論とは、学習済みの模型を使って、未知のデータに対して予測を行うことです。この推論の過程では、活性化関数と呼ばれる関数が重要な役割を果たします。活性化関数は、入力された情報をもとに、次の段階への出力の大きさを決める働きをします。この活性化関数の計算結果を量子化することで、計算の負担を軽くすることができます。

量子化は、計算の効率化に大きく貢献する一方、模型の精度に影響を与える可能性があるという側面も持っています。桁数を減らすということは、情報の細部を削るということでもあります。そのため、量子化によって、模型が本来持っていた精度が低下する可能性があります。どの程度精度が低下するかは、量子化の方法や、対象となる模型の特性によって異なります。

量子化には様々な手法があり、それぞれに利点と欠点があります。目的に合わせて適切な手法を選ぶことが重要です。より精度の高い量子化手法や、特定の種類の模型に特化した手法など、様々な研究が進められています。これらの手法を理解し、適切に活用することで、効率的で精度の高い模型を構築することができます。

| 量子化の種類 | 説明 | メリット | デメリット |

|---|---|---|---|

| 学習済み模型の重みに対する量子化 | 学習を終えたモデルの重みパラメータを、より少ない桁数で表現するように変換する。 | モデルの保存に必要な記憶容量を削減、計算速度の向上 | モデルの精度低下 |

| 推論時の活性化関数の量子化 | 推論時に活性化関数の計算結果を量子化する。 | 計算の負担軽減 | モデルの精度低下 |

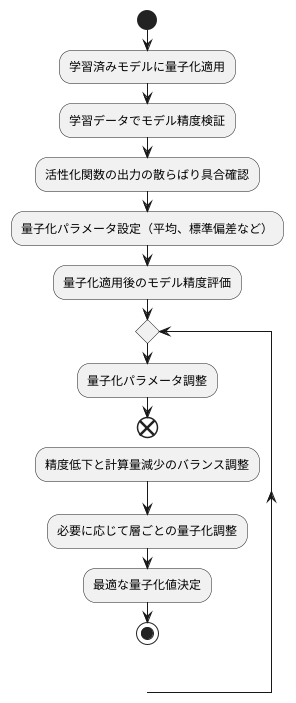

量子化の適用

学習を終えた模型に量子化を適用する場合、学習に用いたデータを使って模型の正確さを確かめる作業が欠かせません。学習データを使って実際に計算をしてみると、模型の各層が持つ活性化関数の出力の散らばり具合が分かります。この散らばり具合の情報は、量子化の際に重要な役割を果たします。適切な量子化の値を設定することで、正確さの低下を抑えられるからです。

例えば、出力値の平均や、平均からのずれ具合を使って量子化の範囲を決めることで、情報の欠落を最小限に抑えることができます。散らばり具合の中心と広がり方を把握することで、量子化による情報の圧縮を効率的に行うことができるのです。

量子化を適用した後の模型の正確さを評価することも大切です。評価結果を見て、必要に応じて量子化のパラメータを調整します。この調整は一度で終わることは少なく、何度も試行錯誤を繰り返す必要があるでしょう。

試行錯誤を繰り返す中で、量子化による正確さの低下と計算量の減少のバランスを見極めることが重要になります。場合によっては、量子化の適用範囲を層ごとに調整するなど、より細かい設定が必要になることもあります。様々な設定を試すことで、最終的に最適な量子化の値を見つけることができます。目指すのは、計算の手間を減らしつつ、模型の正確さをできるだけ維持することです。地道な作業が必要ですが、最適な量子化パラメータを見つけることで、限られた計算資源でも高い性能を発揮する模型を実現できるでしょう。

量子化の課題と展望

機械学習の模型を小さく軽くする技術である量子化は、様々な利点を持つと同時に、いくつかの難点も抱えています。まず、量子化によって模型の精度が下がる場合があります。これは、本来滑らかに変化するはずの数値を、粗い段階に落とし込むことで、情報の欠落が生じるためです。例えば、色の濃淡を表現する際に、使える色の数が減ると、微妙な色の違いが表現できなくなるのと似ています。

また、量子化の手法によっては、計算の手間が増えてしまうこともあります。量子化は数値を単純化するものの、その単純化のための処理自体に計算が必要となる場合があるためです。さらに、量子化を行うための適切な計算機の部品を選ぶことも重要です。部品によっては、量子化された模型をうまく処理できない場合があり、かえって効率が悪くなる可能性があります。

これらの難点を克服するために、様々な研究開発が進められています。例えば、情報の欠落を最小限に抑え、精度の低下を防ぐ新しい量子化の方法が開発されています。これは、色の濃淡の例で言えば、限られた色の数で、なるべく元の色のグラデーションに近づけるような工夫をすることに似ています。また、量子化に適した模型の構造についても研究が進められています。模型の構造を工夫することで、量子化による影響を少なくし、効率を上げることが期待できます。

量子化は、今後ますます発展していくと見られています。特に、小型で電力消費の少ない機器への応用において、量子化は欠かせない技術です。このような機器では、大きな模型を動かすことが難しいため、量子化によって模型を小さく軽くすることが重要になります。今後の研究開発によって、より精度が高く効率的な量子化技術が実現され、様々な機器で機械学習が活用されるようになることが期待されます。

| 利点 | 難点 | 対策 |

|---|---|---|

| 模型を小さく軽くできる 小型機器への応用が可能 |

精度の低下 計算の手間増加 適切な計算機の部品選択が必要 |

精度の低下を防ぐ新しい量子化方法の開発 量子化に適した模型の構造の研究 |