積層オートエンコーダ:過去の手法

AIの初心者

先生、「積み重ね自動符号化器」って、どんなものですか?難しそうでよくわからないです。

AI専門家

簡単に言うと、データを圧縮して、また元の形に戻す仕組みを何層にも重ねたものだよ。それぞれの層で、データの特徴を少しずつ学習していくんだ。

AIの初心者

何層にも重ねることで、どんな良いことがあるんですか?

AI専門家

より複雑な特徴を捉えることができるようになるんだ。昔は一層ずつ学習させていたけど、今はもっと良い方法があるので、あまり使われていないけどね。

積層オートエンコーダとは。

複数の自己符号化器を積み重ねて使うことで、神経回路網のそれぞれの層で、より高度で抽象的な特徴を学習させる方法があります。この方法は、それぞれの層を一つずつ学習させて、最後に全ての層を繋げて微調整を行います。しかし、今ではより高性能な深層学習が登場し、全ての層を同時に学習させることができるようになったので、この方法はほとんど使われなくなりました。

自己符号化器の積み重ね

自己符号化器を積み重ねた構造を持つ、積み重ね自己符号化器について解説します。

積み重ね自己符号化器は、複数の自己符号化器を繋げた神経回路網です。

では、自己符号化器とは一体どのようなものでしょうか。

自己符号化器とは、入力された情報を一度圧縮し、その後再び元の情報に復元するよう学習する神経回路網です。

入力と出力が同じになるように学習させることで、データに潜む本質的な特徴を抽出することができます。

この自己符号化器を複数層重ねたものが積み重ね自己符号化器です。

積み重ね自己符号化器は、1層目の自己符号化器が入力データを受け取り、圧縮された特徴表現を出力します。

この出力は、次の2層目の自己符号化器の入力となります。

2層目の自己符号化器は、1層目が出力した特徴をさらに圧縮し、より抽象的な特徴表現を出力します。

このように、層を重ねるごとに、より高度で複雑な特徴を抽出していくことができます。

最終層まで処理が進むと、積み重ね自己符号化器は最後に得られた特徴から元の入力データを復元しようとします。

積み重ね自己符号化器の学習は、各層の自己符号化器を順番に学習させる事前学習と、全体を微調整する学習の2段階で行います。

事前学習では、各層が入力データの特徴をうまく捉えられるように学習します。

その後の全体調整で、層全体が協調してより良い特徴表現を獲得できるようにします。

積み重ね自己符号化器は、画像認識や音声認識といった分野で、データの次元削減や特徴抽出に利用され、複雑なデータから重要な情報を効率的に引き出すことができます。

段階的な学習

積み重ねて作られた自動符号化機の学習は、各階層を一段ずつ登るように進められます。まず初めに、一番下の階層にある自動符号化機が、与えられた情報から特徴を学び取ります。この学び取った特徴は、いわば情報の要約のようなものです。次に、二番目の階層にある自動符号化機が、一つ下の階層でまとめられた要約を受け取り、それを新たな情報としてさらに学びを深めます。

この学習の過程は、まるでバケツリレーのように、下の階層から上の階層へと順々に繰り返されます。各階層の自動符号化機は、直前の階層で得られた要約に基づいて、より高度で複雑な特徴を捉えることができるようになります。これは、生の情報から始まり、徐々に抽象的な概念へと理解を深めていく過程に似ています。

全ての階層で学習が完了した後、最後の仕上げとして「微調整」と呼ばれる工程を行います。これは、これまでバラバラに学習を進めてきた各階層を繋ぎ合わせ、全体を一つにまとめて調整する作業です。全体を繋げることで、各階層が得た知識が統合され、より精度の高い情報処理が可能になります。

このように、各階層を段階的に学習していく方法は、初期の深層学習において、学習の効率化や精度の向上に大きく貢献しました。特に、大量の情報を扱う際に、この段階的な学習方法は有効であり、複雑な情報の処理を可能にする上で重要な役割を果たしました。まるで、複雑な問題を一つ一つ分解して解決していくように、深層学習は段階的な学習によって、高度な情報処理を実現しています。

抽象的な特徴表現

多くの情報を取り扱うとき、細かな違いに注目するよりも、全体の特徴を捉えることが重要となる場合があります。これを抽象的な特徴表現と呼びます。積み重ねた自動符号化機は、まさにこの抽象的な特徴表現を学習するために用いられます。

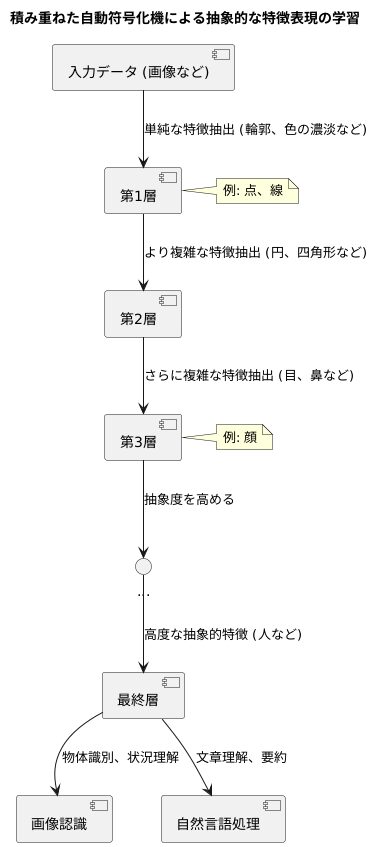

自動符号化機は、入力された情報を一度圧縮し、その後元の形に戻すように学習を行います。この圧縮と復元の過程で、重要な特徴だけが抽出され、細かなノイズなどは除去されます。積み重ねた自動符号化機では、この圧縮と復元を何層にも渡って繰り返します。最初の層では、入力データから単純な特徴、例えば画像であれば輪郭や色の濃淡などが抽出されます。次の層では、前の層で抽出された特徴を組み合わせ、より複雑な特徴、例えば円や四角形などが抽出されます。このように層を重ねるごとに、より複雑で抽象的な特徴が段階的に抽出されていきます。

層を深く重ねることで、最終的には非常に抽象度の高い特徴表現を得ることができます。例えば、画像認識の場合、初期の層では点や線といった単純な特徴が抽出されますが、層が深くなるにつれて、目や鼻、顔といったより高レベルな特徴が抽出されるようになります。最終的には、それが「人」であるといった、非常に抽象的な概念を捉えることができるようになります。

これらの抽象的な特徴表現は、様々な場面で力を発揮します。例えば、画像認識では、物体の種類を識別するだけでなく、画像に写っている状況を理解するなど、高度な処理が可能になります。また、自然言語処理では、文章の意味を理解したり、文章を要約したりといった処理に応用できます。このように、抽象的な特徴表現は、高度な人工知能を実現するための重要な鍵となります。

過去の技術

過去の技術である積層自動符号化器について解説します。これは、複数の層が積み重なった構造を持つ、情報を効率的に表現するための技術でした。特に、計算機の性能が限られていた時代においては、深い層を持つ神経回路網を学習する上で重要な役割を果たしました。

この技術の核心は、段階的な学習方法にあります。まず、入力データから特徴を抽出し、その特徴を再び元のデータに復元するよう学習する符号化器と復号化器のペアを、入力層に近い部分で訓練します。次に、この学習済みの符号化器の出力を新たな入力データとして扱い、さらに深い層で同様の学習を繰り返します。このようにして、少しずつ深い層へと学習を進めていくことで、全体を一度に学習するよりも効率的に深い神経回路網を学習することが可能でした。

しかし、近年、計算機の性能が飛躍的に向上し、学習方法にも様々な改良が加えられました。その結果、神経回路網の全ての層を同時に学習する方が、より効率的で高い精度を実現できることが明らかになりました。同時に学習することで、各層が他の層との関係性をより深く理解し、全体としてより最適な表現を獲得できるためと考えられます。

そのため、現在では積層自動符号化器は主流ではなくなり、より新しい技術に取って代わられています。かつては画期的な技術として注目を集めましたが、技術の進歩とともにその役割を終えたと言えるでしょう。これは技術の進化の過程を示す一つの例であり、常に新しい技術が開発され、古い技術が更新されていくことの重要性を示唆しています。

| 項目 | 内容 |

|---|---|

| 技術名 | 積層自動符号化器 |

| 目的 | 情報を効率的に表現する |

| 手法 | 段階的な学習。入力に近い層から順に、符号化器と復号化器のペアを学習。学習済みの符号化器の出力を次の層の入力として使用。 |

| 利点(過去) | 計算機の性能が限られていた時代に、深い層を持つ神経回路網を効率的に学習できた。 |

| 欠点(現在) | 計算機の性能向上と学習方法の改良により、全ての層を同時に学習する方が効率的かつ高精度なため、現在では主流ではない。 |

| 結論 | 技術の進歩により役割を終えた技術の一例。 |

現代の手法との比較

近年の深層学習では、積み重ねた自己符号化器のように段階的に学習を進めるのではなく、誤差逆伝播法と呼ばれる計算方法を使って、全ての層を同時に学習させるのが主流となっています。なぜこのような変化が起こったのでしょうか。まず、高性能な画像処理装置などの計算資源が手軽に使えるようになったことが挙げられます。膨大な計算を必要とする深層学習にとって、これは大きな進歩です。また、計算方法にも工夫が凝らされました。「ランプ関数」のような活性化関数の導入や、まとまったデータを一度に処理する「一括正規化」といった技術により、勾配消失問題といった計算上の難題が克服されました。勾配消失問題は、層が深くなるにつれて学習が進まなくなる現象で、以前は積み重ねた自己符号化器の層数を増やす際の大きな壁となっていました。これらの技術革新により、現在の深層学習モデルは、積み重ねた自己符号化器よりもはるかに多くの層を効率的に学習できるようになりました。層を増やすことでモデルの表現力が向上し、結果として従来の手法よりも高い性能を達成できるようになったのです。例えば、画像認識や自然言語処理といった分野では、深層学習モデルが人間に匹敵する、あるいは人間を超える精度を達成する事例も出てきており、様々な応用が期待されています。

| 変化 | 理由 |

|---|---|

| 自己符号化器の段階的学習から、誤差逆伝播法による同時学習へ |

|

| 層数の増加 | 勾配消失問題の克服 |

| モデルの表現力向上、従来手法よりも高い性能 | 層数の増加 |

歴史的意義

積み重ね自動符号化器は、近年の深層学習の目覚ましい発展を支えた重要な技術です。その革新的な学習方法は、多くの層を持つ複雑な神経回路網の学習を現実のものとしました。これは、それまで困難とされていた深い構造を持つ神経回路網の学習における大きな壁を乗り越える、画期的な出来事でした。

積み重ね自動符号化器は、段階的な学習という方法を採用しています。これは、複雑な全体を一度に理解するのではなく、簡単な部分から順に学習を進めていくという考え方です。まず、入力データから重要な特徴を抽出し、それをより抽象的な表現に変換する符号化器を学習します。次に、その抽象的な表現から元のデータに復元する復号化器を学習します。この符号化と復号の過程を繰り返すことで、データの本質的な特徴を捉える能力を高めていきます。

積み重ね自動符号化器の重要な貢献の一つは、データから抽象的な特徴表現を学習する能力を実証したことです。これは、データの中に隠された本質的な構造やパターンを自動的に発見できることを意味します。この考え方は、現在の様々な深層学習モデルにも受け継がれており、画像認識、音声認識、自然言語処理など、幅広い分野で応用されています。

今日では、積み重ね自動符号化器自体が最先端技術として用いられることは少なくなりました。しかし、その影響は深層学習の発展に深く刻まれており、多くの新しい技術の土台となっています。積み重ね自動符号化器は、深層学習の歴史における重要な一歩として、これからも記憶されるでしょう。その先駆的な役割は、人工知能研究の進歩に大きく貢献したと言えるでしょう。

| 積み重ね自動符号化器 |

|---|

| 近年の深層学習の発展を支えた重要な技術 |

| 複雑な神経回路網の学習を可能にした |

| 段階的な学習を採用(簡単な部分から順に学習) |

| 符号化器:入力データから重要な特徴を抽出し、抽象的な表現に変換 |

| 復号化器:抽象的な表現から元のデータを復元 |

| データから抽象的な特徴表現を学習する能力を実証 |

| データの中に隠された本質的な構造やパターンを自動的に発見 |

| 画像認識、音声認識、自然言語処理など、幅広い分野で応用 |

| 現在では最先端技術としてはあまり用いられない |

| 深層学習の歴史における重要な一歩 |

| 人工知能研究の進歩に大きく貢献 |