報酬成形:賢い学習の鍵

AIの初心者

先生、「報酬成形」って、報酬をうまく与える方法を見つけることですよね?でも、具体的に何をどうすればいいかがよく分かりません。

AI専門家

そうだね、うまく言い換えたね。報酬成形とは、AIが学習する際に、より良い行動を促すために、報酬の与え方、つまり報酬関数を調整していくことだよ。例えば、犬に「お手」を教えたいとする。最初は、手に少しでも近づいたら褒めて、徐々に完全に「お手」の形になった時にだけ褒めるようにする、といった感じだね。

AIの初心者

なるほど。じゃあ、AIにゲームの攻略方法を学習させたい場合は、最初は敵を少し倒しただけで報酬を与えて、徐々にクリアに近づいたら報酬を増やす、みたいな感じですか?

AI専門家

その通り!まさにそういうこと。適切な報酬を設定することで、AIは効率的に学習し、目標を達成できるようになるんだ。報酬の与え方を工夫することが、AIの学習を成功させる鍵と言えるだろうね。

報酬成形とは。

人工知能の学習方法の一つである強化学習では、「報酬」を使って学習を促します。この「報酬」を与える基準を「報酬関数」と言いますが、目的に合った適切な「報酬関数」を作る作業を「報酬成形」と呼びます。「報酬関数」と学習方法の確認を繰り返し行いながら、「報酬関数」を調整していく作業です。どのように「報酬」を設定するかによって、人工知能が学ぶ方法は大きく変わってきます。

報酬成形とは

試行錯誤を通して学習する機械学習の手法の一つである強化学習では、まるで動物の調教のように、望ましい行動には褒美を与え、望ましくない行動には罰を与えることで、学習を行う主体であるエージェントに最適な行動を覚えさせていきます。この学習の過程で、褒美を与える基準となるのが報酬関数です。報酬関数は、エージェントの行動に対する褒美の与え方を定めた規則であり、強化学習の肝となる重要な要素です。報酬成形とは、この報酬関数を適切に作り上げる工程のことを指します。

適切な報酬関数を作り上げることで、エージェントは効率的に学習を進め、目標とする行動を習得できます。例えば、迷路を解く課題を学習させる場合、ゴールに到達した時に大きな褒美を与え、壁にぶつかった時には罰を与えることで、エージェントは迷路を解くための適切な経路を見つけることができます。また、ゴールまでの距離に応じて段階的に褒美を与えることで、より早くゴールに到達するようにエージェントを導くことも可能です。

逆に、報酬関数の設計が不適切だと、エージェントは望ましくない行動を学習してしまったり、学習が全く進まなかったりする可能性があります。例えば、迷路の途中で特定の場所に留まることで小さな褒美が得られるように設定してしまうと、エージェントはその場所に留まり続け、ゴールを目指さなくなってしまうかもしれません。また、褒美と罰のバランスも重要です。罰が大きすぎると、エージェントは行動を起こすことを恐れ、学習が進まなくなる可能性があります。

このように、報酬関数の設計は強化学習の成否を大きく左右します。そのため、報酬成形は強化学習において非常に重要な役割を担っていると言えるでしょう。試行錯誤を通して最適な報酬関数を見つけることが、強化学習を成功させる鍵となります。

| 強化学習の要素 | 説明 | 例(迷路) |

|---|---|---|

| エージェント | 学習を行う主体 | 迷路を解くAI |

| 報酬関数 | エージェントの行動に対する褒美の与え方を定めた規則。強化学習の肝となる重要な要素。 | ゴール到達で大きな褒美、壁にぶつかると罰 |

| 報酬成形 | 報酬関数を適切に作り上げる工程 | ゴールまでの距離に応じて段階的に褒美、褒美と罰のバランス調整 |

| 適切な報酬設定 | エージェントは効率的に学習を進め、目標とする行動を習得 | ゴールに到達するように学習 |

| 不適切な報酬設定 | エージェントは望ましくない行動を学習、学習が全く進まない | 特定の場所に留まり続ける、罰が大きすぎて行動を起こさない |

報酬成形の重要性

学習する機械にとって、何を基準に良し悪しを判断するかは非常に大切です。この良し悪しを決める基準を報酬関数と言いますが、ただ単に最終的な目標達成のみに報酬を与えるのではなく、目標達成に至るまでの過程にも報酬を与えることで、学習効率を飛躍的に高めることができます。これを報酬成形と言います。

たとえば、将棋を学習する機械を想像してみてください。最終的な目標である勝利のみに報酬を与える場合、勝利という結果に至るまでの道のりが長いため、学習がなかなか進みません。まるで、深い霧の中を手探りで進むようなものです。勝利という目的地にたどり着くまで、機械は何が良い行動で何が悪い行動なのかを理解しづらいため、学習の速度は非常に遅くなってしまいます。

一方、報酬成形を適用し、駒を取ったり、王手をかけたりといった過程にも報酬を与えることで、機械はより明確な指針を持って学習を進めることができます。小さな成功体験を積み重ねることで、機械はどの行動が良い方向に向かっているのかを理解しやすくなり、まるで霧が晴れたように学習の道筋が見えてきます。駒を取る行動に報酬が与えられれば、機械は駒を取る行動の重要性を理解し、積極的に駒を取るようになります。そして、駒を取る行動を通して、最終的な勝利にも繋がりやすくなることを学習していくのです。

このように、報酬成形は複雑な課題を学習する機械にとって、学習効率を向上させるための重要な鍵となります。適切な報酬を与えることで、機械は目標達成までの道筋を段階的に学習し、最終的には優れた成果を上げることができるようになります。まさに、目的地までの道しるべとなる重要な技術と言えるでしょう。

| 手法 | 説明 | 学習効率 | 例 |

|---|---|---|---|

| 報酬関数(単純) | 最終的な目標達成のみに報酬を与える。 | 低い | 将棋で勝利した場合のみ報酬 |

| 報酬成形 | 目標達成に至るまでの過程にも報酬を与える。 | 高い | 将棋で駒を取ったり、王手をかけたりする行動にも報酬 |

報酬成形の実際

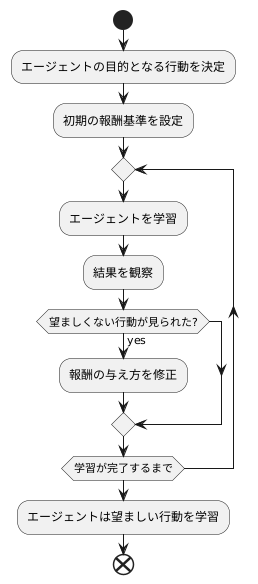

報酬成形は、目的とする行動を学習させるための試行錯誤の繰り返しによって行われます。ちょうど粘土をこねて理想の形に近づけていくように、はじめは簡単な報酬の与え方から始め、徐々に洗練させていきます。

まず、エージェント(学習主体)にどのような行動をさせたいのかを考え、初期の報酬の基準を定めます。例えば、ロボットに歩行を学習させたい場合、前に進んだ距離に応じて報酬を与える、といった簡単な基準から始めます。

次に、設定した報酬基準に基づいてエージェントを学習させ、その結果を観察します。もし、ロボットが転倒してしまうなど、望ましくない行動が見られた場合は、報酬の与え方を修正します。転倒した場合は報酬を減らす、あるいは転倒しないようにバランスを保った行動には報酬を追加する、といった具合です。

この、学習と観察、そして報酬基準の修正という一連の流れを何度も繰り返すことで、エージェントは徐々に望ましい行動を学習していきます。最初のうちは、前に進むだけで報酬が得られたロボットが、繰り返し学習を行うことで、転倒せずに安定して歩行できるようになるのです。

このように、報酬成形は、試行錯誤によって最適な報酬の与え方を模索する、地道な作業です。場合によっては、複雑な問題を扱う際に、多くの時間と手間を要することもあります。しかし、この試行錯誤こそが、強化学習を成功させるための重要な鍵となるのです。

適切な報酬関数の設計

望ましい働きを促す仕組みを作るには、まず何を実現したいのかを具体的に決めることが大切です。目的がぼんやりしていると、作った仕組みは思いもよらない動きをしてしまうかもしれません。

たとえば、お掃除ロボットに「部屋をきれいにする」仕事をさせたいとします。単純にゴミを拾った数で褒美を与えると、ロボットはゴミを拾っては落とし、拾っては落とすという行動を繰り返すかもしれません。なぜなら、ロボットにとってはゴミを拾うという行為自体が褒美を得るための方法になっているからです。本当に目指している「部屋をきれいにする」という目的を達成させるには、部屋全体のきれいさを測る方法を考えて、それに基づいて褒美を与える必要があります。

このように、何を実現したいのかをしっかりと理解し、その目的を達成するためにふさわしい仕組みを作ることが重要です。また、褒美の大きさも大切です。褒美が大きすぎると、特定の行動ばかり繰り返すようになり、小さすぎると学習が進まなくなる可能性があります。ちょうど良い褒美の大きさを見つけるには、仕事の性質やロボットの学習状況などを考える必要があります。

さらに、短期的な成果だけでなく、長期的な成果も考える必要があります。たとえば、チェスをするプログラムを作る場合、すぐに駒を取ることだけを褒美にすると、最終的な勝利につながらない可能性があります。したがって、最終的な勝利を最大の目標として、その過程での適切な行動にも褒美を与える必要があります。このように、短期的な目標と長期的な目標のバランスを考慮しながら、適切な褒美の仕組みを作ることが、望ましい結果を得るために不可欠です。

| 目的 | 問題点 | 解決策 | 補足 |

|---|---|---|---|

| 部屋をきれいにする | ゴミを拾った数で褒美を与えると、ゴミを拾っては落とすという行動を繰り返す可能性がある。 | 部屋全体のきれいさを測る方法を考えて、それに基づいて褒美を与える。 | 仕事の性質やロボットの学習状況などを考えて、ちょうど良い褒美の大きさを見つける必要がある。 |

| チェスで勝利する | すぐに駒を取ることだけを褒美にすると、最終的な勝利につながらない可能性がある。 | 最終的な勝利を最大の目標として、その過程での適切な行動にも褒美を与える。 | 短期的な目標と長期的な目標のバランスを考慮しながら、適切な褒美の仕組みを作る必要がある。 |

今後の展望

報酬の与え方を工夫する技術、報酬成形は、機械学習の中でも特に注目されている強化学習という分野において、なくてはならない重要な研究テーマです。そして、この技術は今後ますます研究開発が進むと期待されています。

特に、人の手を借りずに、機械が自ら報酬の与え方を調整する技術の開発が期待を集めています。もし、そのような技術が確立されれば、より複雑で難しい課題にも強化学習を役立てることができるようになり、様々な分野での活用が進むと考えられます。

例えば、自動運転技術やロボットの制御、医療診断など、すでに様々な分野で強化学習は使われ始めています。これらの分野では、複雑な状況の中で、最適な行動を機械に学習させる必要があります。そのため、報酬成形は今後ますます重要性を増していくでしょう。

また、人と同じような学習能力を持つ人工知能を作る上でも、報酬成形は重要な役割を果たすと考えられています。人は、様々な経験を通して、何が良くて何が悪いかを学び、成長していきます。この、人の学習の仕組みを真似することで、より高度な学習能力を持つ人工知能を作ることができるかもしれません。

これからの研究開発によって、報酬成形の技術はさらに進化し、人工知能の発展に大きく貢献していくと期待されています。より良い報酬の与え方を模索することで、人工知能はますます賢くなり、私たちの生活をより豊かにしてくれる可能性を秘めているのです。

| テーマ | 内容 |

|---|---|

| 報酬成形 | 強化学習において重要な研究テーマであり、機械が自ら報酬の与え方を調整する技術の開発が期待されている。 |

| 応用分野 | 自動運転、ロボット制御、医療診断など、複雑な状況下での最適な行動学習に必要とされ、重要性を増していく。 |

| 人工知能への貢献 | 人の学習メカニズムを模倣することで、高度な学習能力を持つ人工知能の開発に貢献し、生活を豊かにする可能性がある。 |