活性化関数ELU:滑らかさと速さを両立

AIの初心者

先生、「ELU」ってなんですか?なんだか難しそうです。

AI専門家

ELUは、人工知能の脳みそであるニューラルネットワークの中で使われる関数の一つだよ。 ReLUという関数の仲間で、値が0より小さいときと、0以上のときで計算の仕方が変わるんだ。

AIの初心者

値が0より小さいときと、0以上のときで計算の仕方が変わるんですか?具体的にはどんな風に変わるんですか?

AI専門家

0以上の値の場合は、入力された値と同じ値が出力される。例えば、入力値が2なら出力値も2になる。0より小さい値の場合は少し複雑な計算で出力値が決まり、必ず0より小さい値になる。このReLUとの違いがELUの特徴なんだよ。

ELUとは。

人工知能の機械学習で使われるニューラルネットワークという仕組みで、「イーエルユー」という用語があります。このイーエルユーは、入力された値が0より小さいときには、特別な計算で値が決まります。一方で、入力された値が0以上のときには、出力される値は入力された値と同じになります。

活性化関数とは

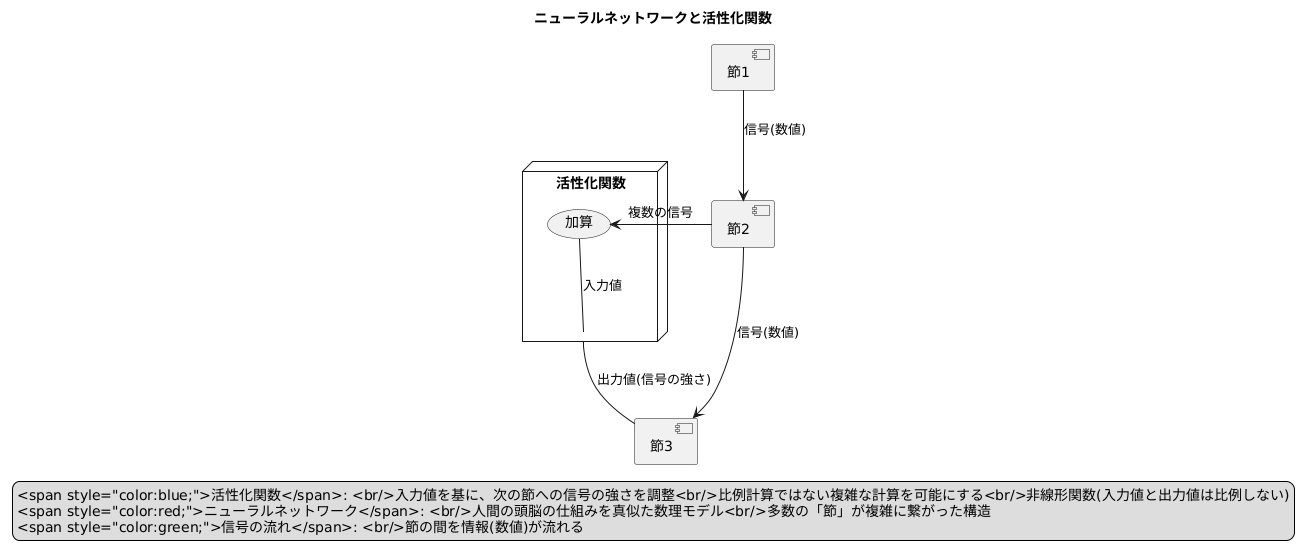

人間の頭脳の仕組みを真似た数理模型であるニューラルネットワークは、人工知能の中核を担っています。このネットワークは、神経細胞に似たたくさんの「節」が複雑に繋がった構造をしています。情報はこれらの節の間を流れながら処理されます。この情報の流れを制御する重要な役割を担うのが活性化関数です。

それぞれの節は、他の節から送られてきた複数の信号を受け取ります。これらの信号は数値で表され、足し合わされて一つの値になります。この値をそのまま次の節に送るのではなく、活性化関数という特別な計算を施します。活性化関数は、受け取った値を基に、次の節へ送る信号の強さを調整する役割を果たします。

もし活性化関数がなければ、ネットワーク全体は単純な比例計算の組み合わせでしかなく、複雑な事柄を学ぶことはできません。例えば、直線は比例計算で表せますが、曲線は比例計算だけでは表せません。活性化関数は、比例計算ではない、複雑な計算を可能にする重要な要素です。これにより、ネットワークは複雑な模様や規則性を学ぶことができ、高度な作業をこなせるようになります。

活性化関数には様々な種類があり、それぞれに特徴があります。よく使われるものとして、しきい値関数を滑らかにしたシグモイド関数や、より計算が簡単なReLU関数などがあります。これらの関数は、入力値に応じて出力値が変化する非線形関数です。つまり、入力値が2倍になったからといって、出力値も2倍になるとは限りません。この非線形性が、ニューラルネットワークの表現力を高める鍵となっています。

例えば、写真を見て何が写っているかを判断する画像認識や、人間の言葉を理解する自然言語処理など、現代の人工知能技術の多くは、活性化関数の非線形性によって支えられています。

代表的な活性化関数

様々な役割を持つ活性化関数について、代表的なものをいくつか紹介します。活性化関数は、人工知能の学習において重要な役割を担っています。人工知能は、人間の脳の仕組みを模倣したしくみで学習を進めます。人間の脳には無数の神経細胞があり、それらが複雑に繋がり連動することで情報を処理しています。活性化関数は、この神経細胞の働きを模倣するものです。

古くからよく知られている活性化関数の一つに、シグモイド関数があります。この関数は、入力された値を0から1の範囲の値に変換する働きをします。滑らかな曲線を描くように変化するため、確率を表す時などに適しています。例えば、画像に写っているものが「猫である確率」などを計算する際に用いられます。

近年では、計算の手間が少ないことから、ランプ関数(ReLU関数)が広く使われています。この関数は、入力された値が正の数の時はそのままの値を出力し、負の数の時は0を出力します。とても単純なしくみですが、多くの場合で効果を発揮することが分かっています。

ランプ関数をさらに改良したものがリーキーランプ関数(Leaky ReLU関数)です。負の数の入力に対しても、わずかながら値を出力するように改良されています。その他にも、今回紹介した指数線形ユニット(ELU関数)など、様々な活性化関数が開発されています。

どの活性化関数を選ぶかによって、人工知能の学習の速度や正確さが大きく変わってきます。そのため、目的に合わせて適切な活性化関数を選ぶことが、人工知能の開発において重要な要素となります。

| 活性化関数 | 特徴 | 用途 |

|---|---|---|

| シグモイド関数 | 入力を0から1の範囲に変換、滑らかな曲線 | 確率を表す(例:画像認識) |

| ランプ関数(ReLU関数) | 正の入力はそのまま出力、負の入力は0出力、計算が容易 | 多くの場合で効果的 |

| リーキーランプ関数(Leaky ReLU関数) | ランプ関数の改良版、負の入力にもわずかな値を出力 | – |

| 指数線形ユニット(ELU関数) | – | – |

ELU関数の特徴

活性化関数であるELU関数は、良いところ取りをした関数と言えます。よく使われる活性化関数のReLU関数の長所を受け継ぎつつ、ReLU関数の弱点であった部分を補うように作られています。

ReLU関数の良いところは、計算の手間が少ないところです。また、関数の出力が0か正の値なので、学習をうまく進めることができます。しかし、入力が負の値の場合は、常に0を出力してしまうため、学習が進まなくなる「dying ReLU」と呼ばれる問題が起こることがあります。

この問題を解決するために、ELU関数は負の入力に対して特別な工夫をしています。ReLU関数は、入力が負の値だと0を出力しますが、ELU関数は負の値でも0ではない値を出力するように設計されています。具体的には、なめらかに変化する曲線を描く指数関数を用いて値を計算します。負の入力でも値が変化することで、ReLU関数で起こっていた学習の停滞を避けることができます。

ELU関数は、学習の安定性と速度を向上させることができます。学習が安定するとは、学習の過程で結果が大きく変化しないことを意味します。学習が速いとは、少ない回数で目的の結果にたどり着けることを意味します。ELU関数は、これらの点でReLU関数よりも優れているため、より高い精度で学習を進めることが期待できます。さらに、計算の手間が少ないというReLU関数の利点も受け継いでいます。そのため、多くの層を持つ大きな規模のネットワークの学習にも適しています。

| 活性化関数 | 長所 | 短所 |

|---|---|---|

| ReLU | 計算の手間が少ない、関数の出力が0か正の値なので学習をうまく進めることができる。 | 入力が負の値の場合、常に0を出力してしまうため、学習が進まなくなる「dying ReLU」と呼ばれる問題が起こることがある。 |

| ELU | ReLU関数の長所を受け継ぎつつ、dying ReLU問題を解決。負の入力に対して0ではない値を出力することで、学習の安定性と速度を向上させる。計算の手間が少ないため、多くの層を持つ大きな規模のネットワークの学習にも適している。 | なし |

ELU関数の定義

ELU関数は、活性化関数の一種で、人工知能の分野、特に深層学習において、神経細胞の挙動を模倣するために用いられます。この関数は、入力値に応じて出力が変化する様子が特徴的で、数式で表現するとより明確になります。入力値を仮に「入力」と呼び、出力値を「出力」と呼ぶことにしましょう。

入力の値が0以上の場合、出力は入力の値と同じになります。つまり、入力値がそのまま出力されるということです。例えば、入力が2であれば、出力も2になります。入力が5であれば、出力も5になります。このように、正の入力に対しては、まるで鏡のように入力値をそのまま出力します。これが、ELU関数の線形性と呼ばれる性質です。

一方、入力の値が0より小さい、つまり負の場合、出力の計算方法は少し複雑になります。まず、入力の値を「自然対数の底」(ネイピア数とも呼ばれ、約2.718の値を持つ定数)の「入力」乗した値を計算します。それから、その値から1を引きます。最後に、その結果に正の定数「α」(アルファ)を掛け算します。この「α」は、通常1に設定されますが、必要に応じて他の値に調整することも可能です。この計算により、入力値が負の場合、出力値は0に近づくにつれて緩やかに減少していきます。

ELU関数の利点の一つは、出力の平均値が0に近づくことです。これは、学習の安定化に大きく貢献します。また、ELU関数は、負の領域でも滑らかに変化するため、勾配消失問題と呼ばれる、深い層を持つ神経回路網の学習における問題を軽減する効果があります。勾配消失問題は、層が深くなるにつれて、学習に必要な情報が薄れてしまう現象ですが、ELU関数を用いることで、この問題の影響を小さくすることができます。

まとめると、ELU関数は、正の入力に対しては線形性を保ち、負の入力に対しては滑らかに減少し、出力の平均値を0に近づけることで、学習の安定化と勾配消失問題の軽減に役立つ、優れた活性化関数です。

ELU関数の活用例

ELU関数は、様々な分野で応用されている、ニューラルネットワークにおける重要な活性化関数です。その滑らかな性質により、学習の安定化や精度の向上に寄与します。

画像認識の分野では、ELU関数は特に威力を発揮します。例えば、写真に写っている物体を識別するタスクでは、画像の明るさや影などの影響を受けやすい場合があります。ELU関数を用いることで、これらのノイズの影響を軽減し、より正確な認識を可能にします。また、画像データには、特定の特徴を持つ画像が多く含まれるなど、データに偏りがある場合も少なくありません。このような場合でも、ELU関数は学習のバランスを取り、偏りの影響を抑制する効果が期待できます。

自然言語処理の分野でも、ELU関数は重要な役割を果たします。文章の感情分析や機械翻訳など、複雑な言語構造を理解する必要があるタスクにおいて、ELU関数はその能力を発揮します。例えば、ある単語が持つ複数の意味を文脈に応じて適切に解釈する必要がある場合、ELU関数は複雑な関係性を捉え、より高度な理解を可能にします。これは、従来の活性化関数では難しかった点であり、ELU関数の大きな利点と言えるでしょう。

音声認識においても、ELU関数は有効です。音声データには、周囲の雑音やノイズが含まれることが多く、これらが認識精度を低下させる要因となります。ELU関数を用いることで、これらのノイズの影響を軽減し、クリアな音声を抽出することが可能になります。これにより、騒がしい環境下でも高い認識精度を維持することが期待できます。このように、ELU関数は様々な分野で活用され、人工知能技術の発展に大きく貢献しています。

| 分野 | 効果 | 詳細 |

|---|---|---|

| 画像認識 | 学習の安定化、精度の向上 | ノイズの影響軽減、より正確な認識、学習のバランス、偏りの影響抑制 |

| 自然言語処理 | 複雑な関係性の把握、より高度な理解 | 文脈に応じた適切な解釈、複数の意味の理解 |

| 音声認識 | ノイズの影響軽減、クリアな音声抽出、高い認識精度 | 騒がしい環境下での認識精度向上 |

まとめ

この文章では、活性化関数の一つであるELU関数についてまとめます。ELU関数は、従来よく使われていた活性化関数であるReLU関数を改良したもので、学習の安定性と速度の向上に役立ちます。

ReLU関数は、入力が0以下の場合は出力も0、入力が0より大きい場合は入力と同じ値を出力する関数です。しかし、学習の過程で一部のニューロンの出力が常に0になってしまう「死んだニューロン問題」が発生することがありました。ELU関数は、入力が負の領域でも滑らかな曲線を描くことで、この問題を回避します。具体的には、入力が0より大きい場合は入力と同じ値を出力し、0以下の場合は指数関数に基づいた値を出力します。

ELU関数は、負の領域でも値を持つことで、勾配が消失する問題も軽減します。勾配消失とは、ニューラルネットワークの学習において、勾配が小さくなりすぎて学習が進まなくなる現象です。ELU関数は、負の領域でも勾配が存在するため、この問題を緩和し、学習をより効率的に進めることができます。

また、ELU関数は計算コストが低いという利点も持ちます。指数関数が使われているため複雑に見えるかもしれませんが、実際には計算は比較的簡単です。そのため、大規模で複雑なデータセットを扱う場合でも、計算時間をそれほど増やすことなく利用できます。

他の活性化関数と比較検討し、最適な活性化関数を選択することが、高性能なニューラルネットワークを構築する上で重要です。ただし、様々な場面でELU関数は優れた性能を発揮するため、特に大規模で複雑なデータセットを扱う際には、ELU関数を積極的に検討することで、モデルの性能向上が期待できます。

| 項目 | 説明 |

|---|---|

| 定義 | ReLU関数を改良した活性化関数。入力 > 0 の場合、出力は入力と同じ。入力 <= 0 の場合、指数関数に基づいた値を出力。 |

| メリット |

|

| その他 | 様々な場面で優れた性能を発揮。特に大規模で複雑なデータセットを扱う際に有効。他の活性化関数と比較検討し、最適なものを選択することが重要。 |